量子認知とLLM埋め込み空間をつなぐ意義

人工知能と認知科学は、長らく異なる言語で発展してきた。しかし近年、大規模言語モデル(LLM)の内部表現が持つ幾何学的構造への関心が高まる中で、量子確率の抽象形式を用いた認知モデル——いわゆる「量子認知」——との接点が浮かび上がりつつある。

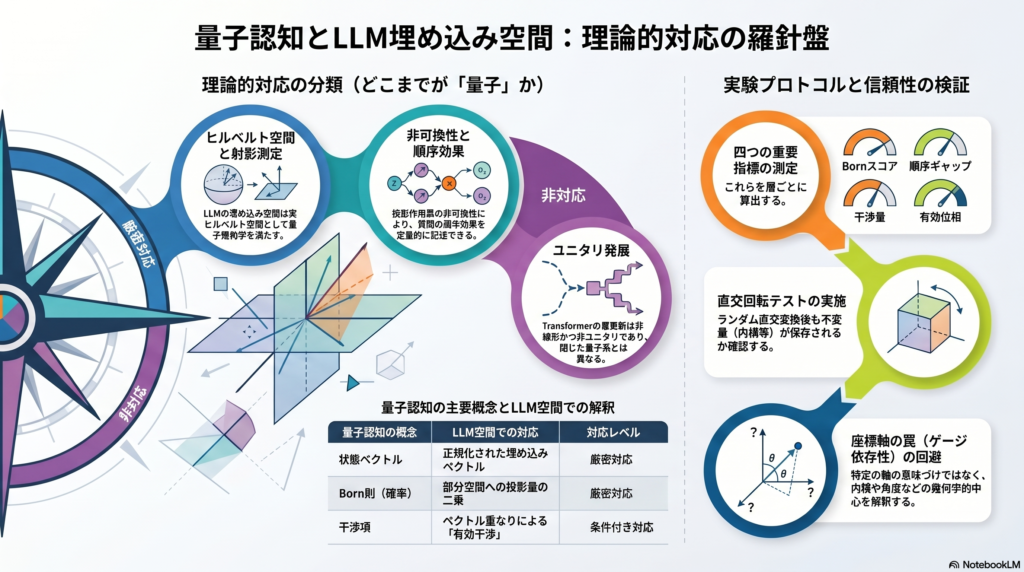

本記事では、量子認知の中核概念(ヒルベルト空間・射影測定・干渉・非可換性)と、BERT・RoBERTa・GPT-2といったモデルの埋め込み空間がどこまで対応し、どこから先は単なるアナロジーにとどまるのかを、数式レベルで丁寧に切り分ける。対応関係を「厳密対応」「条件付き対応」「構成的類推」「非対応」に分類しながら論じることで、両分野を横断する研究者や実務家が理論的に安全に扱える範囲を明確にすることが本記事の目的である。

量子認知の基本フレームワーク:なぜ「量子」が認知に使われるのか

量子認知は「脳が量子コンピュータ」という主張ではない

Jerome R. Busemeyer、Emmanuel M. Pothos、Zheng Wangらによって発展してきた量子認知は、量子物理の物理的実在論とは切り離された研究プログラムである。その核心は、量子確率の「抽象的な数学的形式」を人間の判断・意思決定へ適用することにある。

古典確率やベイズ更新では説明が難しい認知現象——結合錯誤、選好反転、質問順序効果、類似性の非対称、文脈依存的な信念更新——を、ヒルベルト空間・射影測定・非可換性・干渉という言語で記述するのが量子認知の強みである。

量子認知の標準数式

量子認知の標準形では、認知状態は正規化された状態ベクトル ∣ψ⟩ あるいは密度作用素 ρ として表現される。質問・属性・カテゴリは部分空間ないし投影作用素 PA で表され、単一測定の確率はBorn則: p(A)=⟨ψ∣PA∣ψ⟩

で与えられる。逐次測定では:p(B←A)=∣PBPA∣ψ⟩∣2

が用いられ、順序効果は PAPB=PBPA という非可換性から自然に導かれる。この枠組みにより、結合錯誤・推論順序効果・質問順序効果・類似性非対称などを一つの数学言語で統一的に扱うことが可能になる。

LLM埋め込み空間の構造:BERTからGPT-2まで

表現水準の多様性

LLMの埋め込み空間を量子認知と対比する際、少なくとも以下の四つの表現水準を区別する必要がある。

第一に静的語彙埋め込み et∈Rd。Word2VecやGloVeに代表される文脈非依存の表現である。

第二に入力埋め込み。BERT系では:xi(0)=etok(ti)+eseg(si)+epos(i)

というトークン・セグメント・位置埋め込みの和として構成される。

第三に文脈トークン表現 hi(ℓ)。各Transformer層の出力であり、同一の語でも文脈に応じて異なる表現を持つのが特徴である。

第四に文埋め込み sx(ℓ)。[CLS] トークン、平均プーリング、あるいはSBERTのような対照学習モデルにより得られる文全体の表現である。

Transformerの核心:注意機構の数式

Transformerの中心的な計算は:Attn(Q,K,V)=softmax(dkQK⊤)V

である。重要な点は、Hugging Faceの公式実装でhidden statesが torch.FloatTensor——すなわち実数値テンソル——として返されることである。これは後述する「複素位相の不在」という制約と直結する。

対応関係の体系的整理:厳密対応から非対応まで

ヒルベルト空間構造:厳密対応

命題A:任意の標準LLM埋め込み空間 Rd は、実ヒルベルト空間として量子認知の幾何学的基盤を満たす。

複素化写像 J:Rd→Cd, J(v)=v+i0 は等長埋め込みであり、⟨J(u),J(v)⟩C=u⊤v が成立する。

内積・ノルム・角度・直交性という水準に限れば、LLM埋め込みを「量子風ヒルベルト空間」とみなすことに数学的な障害は存在しない。量子認知とLLM表現の最初の厳密な接点は、複素性ではなく内積幾何にある。これは本対応関係において最も基礎的かつ堅固な結論である。

射影測定としてのプローブ:厳密対応(条件付き)

命題B:概念 A に対する部分空間 SA⊂Rd とその直交射影 PA を定めると: pA(s^x(ℓ))=∣PAs^x(ℓ)∣2=s^x(ℓ)⊤PAs^x(ℓ)

は、実ヒルベルト空間上のBorn型確率として正確に解釈できる。

つまり、概念を部分空間として学習し、埋め込みを正規化状態として扱う限り、埋め込み上のsubspace probeは量子測定とまったく同じ式を持つ。この対応が成立するためには、プローブが直交射影子(projective probe)に限定されることが条件となる。通常のsoftmax分類器をそのまま量子測定と同一視することは難しいが、低ランク射影や直交プローブへと落とし直せば、測定概念はかなり鮮明になる。

順序効果と非可換性:厳密対応

命題C:二つの概念 A, B の射影 PA, PB に対し、順序ギャップを: ΔAB(s^)=∣PBPAs^∣2−∣PAPBs^∣2

と定義する。PA と PB が可換ならば任意の s^ でこの量はゼロになるが、非可換ならば一般にゼロでない。

これは量子認知の「質問順序効果」が、そのまま埋め込み空間上の非可換射影の問題として移植される最も生産的な接点である。「感情ラベル」と「推論ラベル」、「話題ラベル」と「含意ラベル」の概念部分空間を別々に学習し、逐次射影の順序を変えることで、埋め込み上にorder effectを定量的に定義できる。

干渉項:条件付き対応

実ヒルベルト空間においても、二値分割 I=PA+PAˉ に対して: ∣PBs^∣2=∣PBPAs^∣2+∣PBPAˉs^∣2+2Re⟨PBPAs^,PBPAˉs^⟩

が成立する。干渉項 IA→B(s^)=∣PBs^∣2−∣PBPAs^∣2−∣PBPAˉs^∣2 は実ベクトル空間でもゼロでないことがある。

重要な含意は、「干渉」という概念を使うために複素数は必須ではないという点である。複素位相が必要になるのは、各経路に独立した振幅位相 reiθ を持たせたいときだけである。標準LLMのhidden statesは実数であるため、ここで得られるのは「位相を持つ振幅」ではなく、幾何学的重なりから導出された「有効干渉」にとどまる。

ユニタリ発展:非対応

命題E:標準的なTransformerブロックの層更新は一般に非線形かつ非ユニタリである。したがって、U†U=I を満たすユニタリ作用素への同一視はできない。

Self-attentionはsoftmaxを通るため、そもそも線形作用素ではない。さらにresiudal connection・FFN・LayerNormが合成されることでノルム保存性も期待できない。LLMの内部発展は「閉じた量子系の時間発展」ではなく、開放系チャネルや量子インストゥルメント風の状態更新として読むほうが理論的に自然である。

座標軸の罠:ゲージ非一意性という本質的制約

命題F:埋め込み行列 E に対し、任意の直交行列 U について E と EU はpairwise inner productを保存する。

この命題は非常に重要な制約を示している。埋め込み空間の「軸」は学習中の回転に対して識別できず、「この軸が感情位相」「この軸が推論の基底」と意味づけしても、それは一般に観測不可能なゲージ依存的な解釈にすぎない。

解釈すべきなのは座標そのものではなく、内積・部分空間・投影量・回転後も保たれる距離や角度といった不変量である。量子認知とLLMの対応を論じる際に、生の座標値の意味論へ踏み込みすぎることは理論的に危険である。

実験プロトコルと測定すべき四つの指標

モデルとデータの選定

再現性を優先するなら、モデルは bert-base-uncased・roberta-base・gpt2 を基本セットとし、各層のhidden statesと文埋め込みをすべて保存する構成が推奨される。コーパスは幾何抽出用にWikipedia、概念ラベル学習用にGLUEを使い、日本語検証にはBertJapaneseとJGLUEを追加するのが望ましい。

最低限測るべき四つの指標

実験で測定すべき指標は以下の四つに集約される。

第一に概念測定スコア(Born score):BA(h^)=∣PAh^∣2

第二に順序ギャップ:ΔAB(h^)=∣PBPAh^∣2−∣PAPBh^∣2

第三に干渉量:IA→B(h^)=∣PBh^∣2−∣PBPAh^∣2−∣PBPAˉh^∣2

**第四に有効位相:** θ^A→B(h^)=arccos(2∣PBPAh^∣∣PBPAˉh^∣+εIA→B(h^))

ここで θ^ は内在的位相ではなく干渉量から逆算された「有効位相」であることを明示しておく必要がある。

解釈の頑健性を保証する直交回転テスト

実験の信頼性を担保するうえで欠かせないのが、直交回転テストである。埋め込み全体にランダム直交変換 U をかけた後で同じ学習・測定をやり直し、不変量ベースの主張(部分空間・内積・干渉量)が保存されるかを確認する。軸依存の主張は回転で壊れ、不変量ベースの主張だけが安定に残るはずである。これにより、量子風解釈が単なる実装のアーティファクトでないかを実証的に検証できる。

理論的限界と注意すべき落とし穴

Softmaxの問題

量子認知での確率はBorn則——振幅の二乗——から導かれるが、標準LLMの出力確率は線形logitにsoftmaxをかけたGibbs型である。hidden stateは実数のFloatTensorとして実装されているため、確率振幅や位相をネイティブには持たない。「確率振幅」という語を使う場合は、それが構成的定義であることを明記しなければならない。

状態更新の意味の違い

量子認知の測定後状態更新(Lüders更新・量子インストゥルメント)は、測定そのものが状態を変えるという役割を持つ。これに対してLLMの層更新は決定論的な特徴変換であり、心理学的な質問呈示や観測とは意味論的に異なる。この差を曖昧にすると理論が過剰拡張される危険がある。

量子認知自体も万能ではない

量子確率が結合錯誤を必ずしも説明しないという批判や、応答再現性と質問順序効果の両立問題が標準ヒルベルト形式の限界を示しているという指摘も存在する。本対応関係を論じる際は、量子認知側を過度に一般化せず、LLM側を過度に擬量子化しないという二重の慎重さが求められる。

まとめ:どこまでが厳密で、どこから先は構成的か

本記事の議論を最も防御可能な形で一文に集約するなら、次のようになる。

LLM埋め込み空間は、量子認知の形式概念を後付けで実装できるだけの豊かなヒルベルト幾何を持つが、標準モデルの内部表現それ自体が複素振幅・Born測度・ユニタリ発展をネイティブに備えているわけではない。

厳密に対応するのは「実ヒルベルト幾何」と「射影測定としてのプローブ」までである。複素位相・ユニタリ発展は、標準LLMに対しては追加構成を要する。この差を曖昧にしないことが、理論整理としての最重要点である。

量子認知の「測定」「干渉」「重ね合わせ」のうち、少なくとも幾何学的・作用素論的部分は、LLM埋め込み上でかなり厳密に再構成できる可能性がある。一方で、Transformerの層更新を量子力学のユニタリ発展とみなすのは一般に不適切であり、開放系チャネルや量子インストゥルメント風の理解のほうが理論的には自然である。

今後の研究では、事後的な複素化ではなく複素埋め込みや複素TransformerによるネイティブPOVM・quantum instrumentの明示的学習、さらにBertJapanese+JGLUEを用いた多言語での検証が特に有望な方向性として挙げられる。

コメント