なぜ「説明粒度の動的調整」がAI時代のUI設計に必要なのか

AIシステムが医療・金融・交通などの高リスク領域へ浸透するにつれ、「AIがどのように判断したか」を利用者に正確に伝える説明可能AI(XAI: Explainable AI)の重要性は急速に高まっている。しかし従来のXAI設計の多くは、専門家にとっては自明すぎる説明を非専門家に押しつけたり、逆に一般ユーザには難解な技術的詳細を一律に表示したりと、利用者の多様性への配慮が不十分だった。

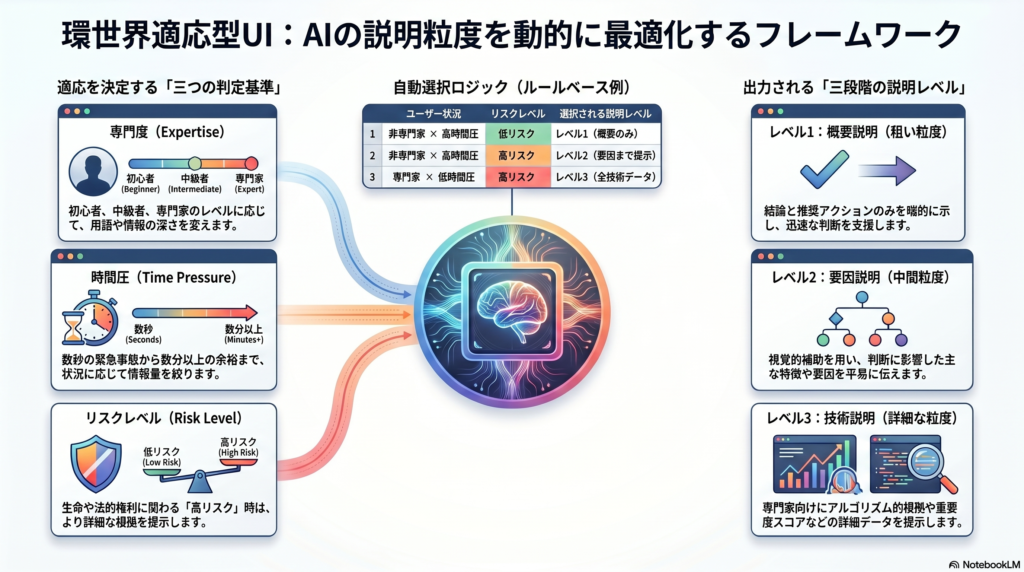

EU人工知能規制法(AI Act)が2026年に全面適用される流れの中で、高リスク分野のAIシステムには説明責任が法的にも求められるようになっている。このような背景から注目されているのが、利用者の専門度・時間的制約・リスクレベルという三つの軸に応じて説明の粒度(詳細度)をリアルタイムに変化させる「環世界適応型UIフレームワーク」だ。本記事では、このフレームワークの理論的根拠から実装設計、評価方法まで体系的に解説する。

環世界適応型UIの理論的背景:先行研究が示す三つの知見

専門度に応じた説明調整が理解度と信頼を高める

Afrizal Zein(2025)が提案した適応型XAIフレームワークは、説明の複雑さと深度をユーザの専門度(初心者・熟練者)に応じて動的に変化させることで、静的な一律説明よりも理解度・満足度が有意に向上することを実験で示している。専門家には根拠となる数値やアルゴリズム的詳細を提示し、非専門家には平易な言葉と視覚的補助で概要を伝えるというアプローチは、認知負荷の最適化という観点でも合理的だ。

説明量と認知負荷の関係:情報は多ければよいわけではない

Herm et al.(2023)は医学生271名を対象に、異なる説明タイプがCOVID-19診断タスクの認知負荷・パフォーマンス・処理時間に与える影響を実証的に検討した。その結果、説明量が多いほど認知負荷が増大し、タスクパフォーマンスが低下するケースがあることが明らかになった。この知見は、XAIの設計において「詳しければ詳しいほどよい」という思い込みが誤りである可能性を示唆している。説明は利用者の処理容量に合わせて最適化される必要がある。

時間圧下では簡潔さが判断精度を守る

Hermanns & Teubner(2025)はオンライン実験(n=228)を通じて、時間的制約がある状況下では人間の認知処理がヒューリスティック(直観)モードに移行しやすく、AIの判断の正誤を識別する能力が低下することを示した。つまり、急速な意思決定が求められる場面では、詳細な説明を提示しても処理されにくく、むしろシンプルな情報提示が判断品質を守ることになる。

これら三つの研究から、利用者属性・状況依存型の説明設計こそがXAIの有効性を最大化するという共通の結論が導かれる。

分類基準の設計:三軸でユーザ状況を特定する

専門家 / 非専門家の定義

環世界適応型UIフレームワークでは、対象ドメインにおける専門教育・資格・業務経験を持つユーザを「専門家」と定義する。医療AIであれば医師・看護師、航空支援AIであれば訓練済みパイロットなどが該当する。具体的な判定基準としては、専門知識テストのスコア、業務経験年数(例:10年以上)、あるいは職種・資格の自己申告などが活用できる。一方「非専門家」は該当基準を満たさない一般ユーザであり、専門知識が限定的または皆無と想定する。

なお、「専門家か否か」の二値判定よりも、初心者・中級者・専門家の三段階スケールで評価する方が、説明粒度の細かいチューニングに適している場合がある。

時間圧の三段階設定

時間的余裕に応じて「低・中・高」の三段階を設定する。

- 高時間圧:数秒以内の即時判断が求められる緊急状況(例:自動運転の警告、医療トリアージ)

- 中時間圧:1分前後の制約下で判断が必要な状況(例:金融取引の承認)

- 低時間圧:5分以上のゆとりがある状況(例:診療計画の立案、保険商品の選択)

時間圧の判定はタスク残り時間の計測、作業キューの込み具合、あるいはユーザの操作速度パターンから推定することが考えられる。アプリケーション固有のタスク時間要件に応じて閾値は調整が必要だ。

リスクレベルの三段階定義

AIシステムの出力誤りが生じた場合の影響度をもとに「低・中・高」に分類する。

- 高リスク:生命・安全・法的権利に直結する分野(医療診断・航空制御・自動運転など)。誤りが許容されにくく、AI判断の完全な説明と根拠の提示が必要

- 中リスク:経済的損失やプライバシー侵害が起こり得るが生命には直結しない分野(金融融資判断・個人データ分析など)。適切な説明粒度のバランスが求められる

- 低リスク:ユーザ体験や効率改善が主目的で誤りの影響が小さい分野(情報推薦・UI案内など)。過度な説明は却って体験を損なう可能性がある

説明粒度の階層モデル:三レベルで情報密度を制御する

フレームワークの核心は、説明内容を以下の三レベルに階層化することだ。

レベル1:概要説明(粗い粒度)

AI判断の結論・推奨のみを端的に示す。専門用語を極力排除し、最小限の情報でユーザの意思決定を支援する。非専門家や高時間圧の状況に適している。

例:「このデータはXパターンに分類されました。推奨アクションはYです。」

レベル2:要因説明(中間粒度)

結論に至った主要な根拠や要因を平易に説明する。アイコン・簡易グラフなどの視覚要素を組み合わせることで、直感的な理解を促す。中程度の専門性と時間余裕がある状況向け。

例:「この判断は、AとBという特徴が大きく影響しています。特にAはYより高い値を示しています。」

レベル3:技術説明(詳細な粒度)

アルゴリズム的根拠、重要度スコア、モデルパラメータ、予測確率などを専門的に提示する。高リスク領域の専門家が判断の妥当性を検証するために必要な情報を網羅する。

例:「モデルはA=0.85、B=0.42の特徴量重みで予測を行い、予測確率は95%です。SHAP値の上位3特徴量は…」

動的調整アルゴリズム:ルールベースとMLベースの二方式

ルールベース方式:シンプルで説明責任を果たしやすい

事前に定義したルールに従って説明レベルを選択する。条件分岐の組み合わせで実装でき、判断根拠が明示的なため監査や説明責任の面で扱いやすい。基本ロジックは以下の通りだ。

- まず専門度で基本レベルを決定する(専門家→L3、非専門家→L1)

- 時間圧が高い場合は粒度を一段下げる(L3→L2、L2→L1)

- リスクレベルが高い場合は粒度を一段上げる(L1→L2、L2→L3)

この三軸の組み合わせにより、例えば「非専門家・高時間圧・高リスク」という状況では、安全確保を優先してL2(要因説明)を選択するといった判断が可能になる。

機械学習方式:履歴から最適化する適応的アプローチ

ユーザの反応履歴や作業成果データから、最適な説明粒度を学習するアプローチだ。強化学習を用いてユーザ満足度や意思決定精度を報酬とし、状況変化に応じたポリシーを獲得する方法や、ユーザ実験データを教師データとした分類モデルを構築する方法などが考えられる。ルールベースに比べて初期設計コストは低い反面、学習データの収集と継続的なモデル管理が必要になる。

実用的には、ルールベースを基盤として安全側に倒した初期動作を保証しつつ、MLで個人最適化を重ねるハイブリッド設計が有力な選択肢となる。

評価プロトコル:何をどう測るか

フレームワークの有効性を検証するには、専門家群・非専門家群それぞれ30〜50名程度を対象に、時間圧・リスク条件を操作した対照実験が想定される。

主要な評価指標

- 理解度:説明内容に関する質問正答率・要約スコア

- 意思決定の質:タスクの正解率・誤り率

- 認知負荷:NASA-TLXなど標準化された主観評価尺度

- 信頼度:AIシステムへの信頼を測る質問紙

- 時間効率:タスク完了までの所要時間

動的適応説明群(提案フレームワーク適用)と静的説明群(一律中間粒度)の2条件を比較し、適応群で理解度・信頼・意思決定精度が向上し、認知負荷が低減するかを検証する設計が基本となる。

実装時の重要チェックポイント

フレームワークを実際のシステムに組み込む際には、以下の要素への対応が不可欠だ。

ユーザプロファイルの収集と管理では、初回利用時のアンケートや行動ログ解析によって専門度・経験年数などの属性データを安全に蓄積する仕組みが必要になる。個人情報保護法やGDPRに準拠したデータ管理設計が前提だ。

リアルタイム性能については、自動運転や医療診断支援など即時性が求められる用途では数百ミリ秒以内の応答が求められる。GPU/CPUバランスの最適化やモデル圧縮、キャッシュ活用など、インフラ設計との連携が重要となる。

多言語対応では、日本語優先の実装であっても専門用語の多言語辞書や翻訳チューニング機能を設計段階から組み込むことで、グローバル展開時の対応コストを抑えられる。

フィードバックループとして、説明の有用性に関するユーザ評価を継続的に収集してアルゴリズムを更新する仕組みを設けることで、システムの精度は運用を通じて向上していく可能性がある。

まとめ:環世界適応型UIが切り拓く説明可能AI設計の新地平

環世界適応型UIフレームワークは、専門家/非専門家・時間圧・リスクレベルという三軸でユーザ状況を捉え、説明の粒度を「概要・要因・技術」の三階層でリアルタイムに制御するという体系的なアプローチを提供する。先行研究の知見と整合し、認知負荷を最適化しながら理解度・信頼・意思決定品質の向上が期待できる設計思想だ。

法規制の強化と高リスク領域へのAI普及が進む中で、「説明する」から「適切に説明する」へという発想の転換は、UIエンジニアやAIシステム設計者にとって今後ますます重要な課題となるだろう

コメント