なぜ今、ヘーゲル弁証法でAI進化を読み解くのか

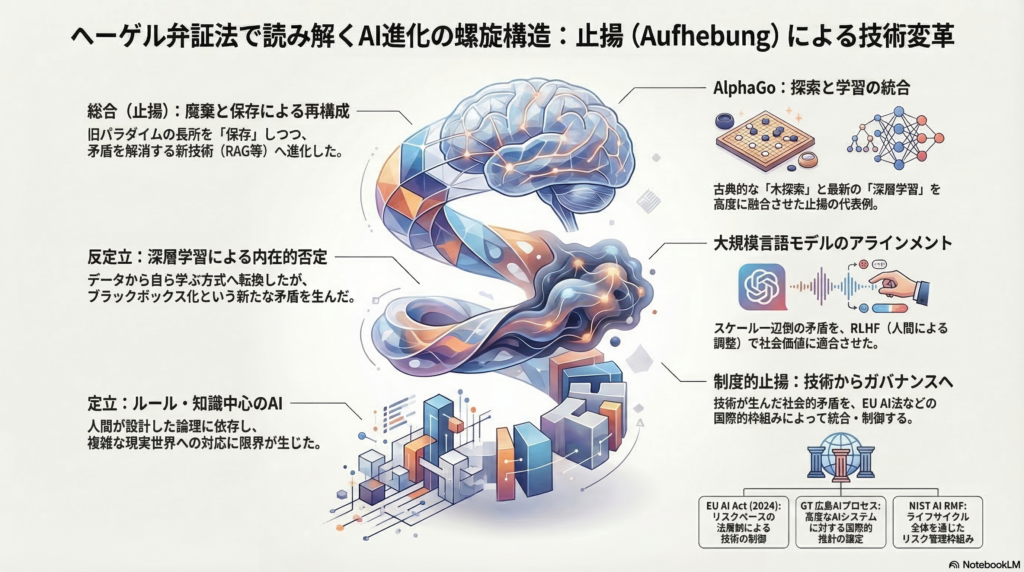

AIの進化は「より賢くなった」という単純な直線ではない。深層学習の台頭、大規模言語モデルの普及、そして倫理・規制・アラインメントへの社会的要請。これらは互いに無関係な出来事ではなく、技術の内在的矛盾が次の段階を呼び込む反復構造として理解できる。

その分析枠組みとして注目されるのが、ゲオルク・ヴィルヘルム・フリードリヒ・ヘーゲル(1770–1831)の弁証法だ。特に**止揚(Aufhebung)**という概念は、「廃棄と保存を同時に行う再構成」を意味し、技術パラダイムが限界を迎えながらも次世代へ引き継がれる構造と深く共鳴する。

本記事では、この対応関係を哲学的に正確に捉えながら、2000年以降のAI史を「定立→反定立→総合(止揚)」の機能的三局面で整理する。実証事例として画像認識・囲碁AI・大規模言語モデルを取り上げ、最後に実務的示唆とガバナンスへの接続も論じる。

ヘーゲル弁証法の正確な理解:「三段階図式」への警戒

「定立・反定立・総合」はヘーゲル自身の言葉ではない

ヘーゲル弁証法を語る際、「定立(Thesis)・反定立(Antithesis)・総合(Synthesis)」という三段階図式が引用されることが多い。しかしこれは**後世に流布した”伝説”**であり、ヘーゲルの原典にこの三語が方法原理として明記されているわけではない。思想史研究者のMueller(1958)はヘーゲルの文書を精査し、この三語図式が誤読を生んできたことを指摘している。

さらに決定的なのは、ヘーゲル自身が『精神現象学』の序文において、三分法を外在的に当てはめる姿勢を**「生命のない図式(lifeless schema)」**と批判し、「科学的展開は内容の内的生命と自己運動から生じるべきだ」と述べている点だ。

本記事でAI史に弁証法を対応させる際も、この警告を踏まえる。三段階は「外から貼り付ける分類ラベル」ではなく、内在的矛盾→否定→止揚という機能的な運動の型として扱う。

止揚(Aufhebung)の二重意味こそが核心

弁証法を理解する上で最も重要な概念が**止揚(aufheben)**だ。ヘーゲルの『論理学(エンサイクロペディー論理学)』において、aufhebenという語は:

- 廃する・無効にする(annul)

- 保存する(preserve)

という二重の意味を持つことが明示されている。これは単なる言葉遊びではなく、弁証法の本質を担う概念装置だ。矛盾は「消えてなくなる」のではなく、「否定されつつも形を変えて保存される」。この構造こそが、AI技術において旧来のパラダイムが次世代に引き継がれるメカニズムと深く一致する。

AI進化を弁証法的に読む:機能的三局面の整理

定立:ルール・知識中心AIの「固定化」

定立の局面とは、あるパラダイムが安定し、強みを発揮しながらも、内部に一面性を孕む段階だ。

2000年代初頭までのAIは、人間が設計したルール・論理・知識グラフ・探索アルゴリズムを中心に構成されていた。特定の領域では高い精度を発揮し、意思決定の根拠を明示できるという説明可能性の高さが強みだった。

しかし現実世界の複雑性・多様性に対しては脆弱で、領域外への移植が困難という限界が顕在化した。ルールを手動で更新・保守するコストも大きく、スケールアップの壁が立ちはだかった。この一面性こそが、次の「反定立」を内側から呼び込む矛盾の種となる。

反定立:深層学習という「内在的否定」

ルール・知識ベースの限界が露わになる中で、「データから学ばせる」という方向への転換が起きた。これが反定立の局面だ。

2006年頃の深層信念ネットワークの再興、2012年のGPU×大規模データによる画像認識の革命、2017年のTransformerによる系列処理の再定義、2020年以降のスケーリング則の確立——これらは単なる「技術改良」ではなく、前段階の一面性に対する内在的な否定として機能した。

特に2012年のImageNet競技における深層畳み込みネットの登場は象徴的だ。トップ5誤り率で15.3%を達成し、次点(26.2%)との大差を示したこの結果は、「人間が特徴を設計する」方式の限界を数値として突きつけた転換点だった。

ただし、反定立は新たな矛盾も生んだ。深層学習はブラックボックスであり、説明可能性が乏しい。大量のデータと計算資源を必要とし、環境負荷が増大する。幻覚(ハルシネーション)や偏り(バイアス)の問題も表面化した。これらは次の「総合(止揚)」を要請する矛盾として蓄積されていく。

総合(止揚):廃棄しつつ保存する再構成

総合の局面では、反定立が生んだ矛盾に対し、旧パラダイムの価値を「保存しながら否定する」形での再構成が起きる。これが止揚の実践だ。

2020年代以降に前景化した動きとして以下が挙げられる:

- 検索拡張生成(RAG):パラメトリック記憶(モデル内部の知識)の限界を外部インデックス参照で補完し、更新可能性・根拠提示を改善

- 人間フィードバックによる調整(RLHF):スケールだけでは解決しないアラインメント問題に対し、人間の価値判断を学習プロセスに内在化

- 神経記号統合(ニューロ・シンボリックAI):深層学習の表現力と記号的推論の構造性を組み合わせるハイブリッドアーキテクチャ

- 社会制度の整備:EU AI Act(2024)、G7広島AIプロセス(2023)、NIST AIリスク管理枠組みなど、技術的矛盾を制度的に止揚する動き

これらは互いに独立した技術トレンドではなく、矛盾を内在化しながら次の定立を準備する螺旋運動の一環として理解できる。

具体事例で見る止揚の構造

画像認識:「特徴設計の限界」が大規模学習を生んだ

画像認識の歴史は弁証法的構造を明確に示す。エッジ検出・HOG・SIFTなどの人手設計特徴量は、限られた条件下では有効だったが、照明・角度・遮蔽の変化に弱いという一面性を持っていた。

2012年のAlexNetによる革命は、この矛盾への内在的応答だ。「データから階層表現を学ぶ」という方針は、特徴設計の手法を廃棄しつつ、「視覚情報の階層的処理」という本質的な知見を保存した。止揚の構造が技術史に刻まれている。

ただし新たな矛盾として、データの偏り・計算コスト・説明可能性の不足が蓄積した。これに応えるXAI(説明可能AI)研究や、効率的スケーリングを探る研究は、次の止揚への萌芽と見なせる。

AlphaGo:探索と学習の止揚が一つのアーキテクチャに

DeepMindのAlphaGoは、止揚の構造がシステム設計レベルで可視化された稀有な事例だ。

- 定立:古典的モンテカルロ木探索(MCTS)による探索・評価

- 反定立:深層ニューラルネットによる局面評価と方策学習

- 総合(止揚):MCTSを保存しながら、ニューラルネットで探索の質を向上させる統合アーキテクチャ

さらにAlphaGo Zeroは「人間の棋譜データに依存せず、ルールのみから自己対局で学習する」ことを示し、「人間知識への依存」という反定立をさらに否定した。しかし同時に、「報酬設計が倫理・社会価値と衝突する」という新たな矛盾を提示する。止揚は終点ではなく、次の定立への移行点だ。

大規模言語モデル:スケール一辺倒の矛盾とアラインメントへの止揚

GPT-3級モデル(2020)は、1750億パラメータによる少数例提示での多タスク性能向上を示した一方で、「モデルを大きくするだけではユーザー意図に沿うとは限らず、不正確・有害・有用でない出力が生じうる」というアラインメント問題を中心課題として明確化した。

この矛盾への止揚として、InstructGPTが示したのは示唆的だ。1.3Bのアラインメント調整済みモデルが、175BのGPT-3より人間評価で好まれるという結果は、「スケール一辺倒」という定立の一面性を内在的に修正した。

また推論と行動を交互に生成し外部環境と相互作用するReActのようなアーキテクチャは、「モデル単体の閉鎖性」を否定しつつ、「外部世界との結合による開放系」として保存・再構成する。これは止揚の典型的形態だ。

制度的止揚:技術の矛盾がガバナンスを生む

技術的な止揚と並行して、制度レベルでの止揚も進んでいる。

基盤モデル・生成AIの普及が生んだ社会的矛盾(雇用影響・偽情報・説明責任・規制の空白)は、以下のような制度的応答を引き出した:

| 制度・枠組み | 主体 | 内容 |

|---|---|---|

| OECD AI原則 | OECD | 信頼できるAIの倫理原則(2019) |

| UNESCO倫理勧告 | UNESCO | AI倫理の国際的枠組み(2021採択) |

| EU AI Act | 欧州連合 | リスクベース規制の法制化(2024) |

| G7広島AIプロセス | G7 | 高度AIシステムへの国際指針(2023) |

| NIST AI RMF | 米国 | AIライフサイクル全体のリスク管理 |

| AI事業者ガイドライン | 日本 | 開発者・提供者・利用者の役割分界 |

これらは技術的能力という「定立」が生んだ社会的矛盾(「反定立」)を、ガバナンス要件として取り込み直す(「総合」)局面に相当する。日本のAI事業者ガイドラインが強調する「理念(why)—指針(what)—実践(how)の反復」はまさに制度版の螺旋運動だ。

この分析枠組みの限界と留意点

弁証法的フレームをAI進化に適用する際、以下の限界は正直に認める必要がある。

① 対象領域の相違:ヘーゲル弁証法は概念と意識・歴史の運動を扱う体系であり、AI進化は研究共同体・資本・計算資源・制度の複合系だ。対応付けは本質的に「比喩的」であり、機械的な対応とは異なる。

② 説明過剰のリスク:「何でも三段階で説明できてしまう」という過剰一般化は常に警戒が必要だ。本記事が三段階を「機能」として再定義したのもその理由による。

③ 多矛盾の並列性:AI進化では「性能 vs 説明可能性」「性能 vs 安全性」「中央集権的開発 vs 透明性」など、複数の矛盾が同時進行する。単一の反定立を特定しにくい多矛盾系として捉える視点も必要だ。

④ 回顧的整合のバイアス:弁証法的説明はあとから筋が通って見える「回顧的整合」を作りやすい。実証的補強には、論文数・計算量・コスト・事故件数などの計量データとの接続が求められる。

まとめ:弁証法的プロダクト・ガバナンスという実務的示唆

ヘーゲル弁証法とAI進化の対応関係は、止揚(廃棄と保存)という概念装置を通じて、技術と社会の矛盾が次世代を生む反復構造として理解することができる。

重要なのは、この枠組みを「AIのロードマップを直線的に引く」ための道具としてではなく、**矛盾(トレードオフ)を設計入力として管理する「弁証法的プロダクト・ガバナンス」**として活用することだ。

具体的には以下のアプローチが示唆される:

- 矛盾台帳(Contradiction Ledger)の策定:性能・汎化・説明可能性・安全性・計算コスト・規制適合を「矛盾指標」として明示し、どの矛盾をどの技術・制度で止揚するかを計画に組み込む

- ライフサイクル全体でのリスク統合:開発者・提供者・利用者の役割分界を前提に、設計段階から運用・監視を一体の社会技術システムとして扱う

- 制度的制約を「内在的条件」として再解釈:EU AI ActやNIST AI RMFを「外部から課される制約」ではなく、次の総合を生む条件として戦略に統合する

AIの進化は終わりのない螺旋だ。矛盾を恐れず、それを次の段階への契機として内在化する姿勢こそが、技術開発においてもガバナンスにおいても求められている。

コメント