拡張マインド理論とは何か——「心が外に出る」とはどういうことか

人間の認知は、頭蓋骨の内側に閉じているのではない——この発想の転換から、拡張マインド理論は始まる。1998年、哲学者のAndy ClarkとDavid Chalmersが提唱した「パリティ原理」は、外部媒体が脳内過程と同等の機能的役割を担うならば、それは単なる道具ではなく認知システムの構成要素そのものだと論じた。

この議論の核心を示す例が、記憶障害者「オットーのノート」である。オットーは生物学的記憶の代わりに常にノートを参照し、その内容を自明の前提として行動する。この使い方が十分に継続的・即時的・自動的であるなら、ノートはオットーの認知の一部とみなせる——というのが原論文の主張だ。

重要なのは、「外部に情報があればよい」わけではないという点である。百科事典やクラウド上の古いファイルのように、必要なときだけ検索する情報は「拡張認知」とは言い難い。拡張マインド理論が問うのは、結合の質と強度である。継続的な利用、容易なアクセス、実質的な自動信頼、そして行為とのリアルタイムな結合——これらが揃って初めて、外部媒体は認知の構成要素となる。

その後、Edwin Hutchinsの分散認知やRichard Menaryの認知統合論が理論を拡張し、今日のAI統合事例を評価するための多軸的な分析枠組みへと発展してきた。そして現代、この理論の問いはAIという新たな外部媒体によって、かつてなく現実的な射程を持ち始めている。

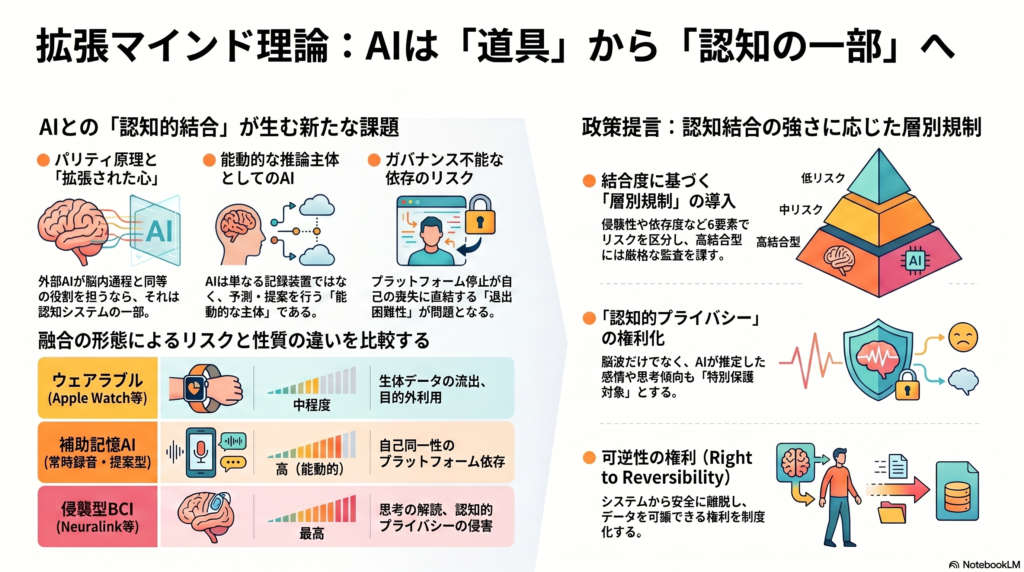

AIとの融合が「拡張認知」になる条件——単なる便利ツールとの違い

AIが「便利なアシスタント」なのか、それとも認知システムの構成要素になっているのか——この問いを厳密に立てるには、いくつかの判断軸が必要になる。

まず注目すべきは、知覚‐記憶‐判断‐行為のループへの入り込み方である。AIが候補生成、優先順位づけ、異常検知、記憶検索、行為提案を担うとき、そのAIは単に命令を実行する受動的手段ではなく、推論過程そのものに参加している。この状態において、「誰が決めたのか」という責任の所在は、単純な人間中心モデルから大きくずれる可能性がある。

次に重要なのは、停止時の機能低下の程度と退出困難性である。日常的に補助記憶AIに依存していた人物が突然そのサービスを失った場合、業務や生活にどれほどの影響が及ぶか。あるいは、体内に植え込まれたBCIを取り外すコストはどれほどか。この「依存の深さ」と「可逆性の低さ」こそが、拡張認知の問題を深刻にする。

また、理論への主要批判として、AdamsとAizawaによる「結合≠構成」論がある。外部装置が認知に因果的影響を与えることと、それが認知の構成要素であることは別問題だ、という指摘である。さらに、企業や国家が統治する外部装置への依存は、自由の拡張ではなく依存の拡張になりうるという批判も重要だ。

AI統合を実践的に論じるうえでは、原典の機能主義的洞察を保ちながら、これらの批判が指摘する依存・不透明性・統治性を理論に取り込むことが求められる。

事例比較——ウェアラブルからBCI・補助記憶AIまでの「融合の程度」

拡張マインド理論の視点から現代のAI統合技術を評価すると、融合の程度は「身体侵襲性」だけでは決まらないことが見えてくる。

ウェアラブル:中程度の融合と高い可逆性

JINS MEMEのような視線・まばたき計測デバイスや、Apple WatchのAFib検出機能は、認知ループへの入り込み度合いとして「中程度」に位置づけられる。日常的なモニタリングによって健康状態の認知が変容する可能性はあるが、装着を止めれば基本的な機能は失われない。可逆性が高い点で、倫理的・法的リスクは相対的に低い。

ただし、これらのデバイスが収集するデータ——まばたき頻度、心拍変動、AFib履歴——はすでに高感度の健康・生体情報であり、第三者への流出や目的外利用が生じた場合の影響は軽視できない。

BCI(ブレイン・コンピュータ・インタフェース):最高度の融合と低い可逆性

Synchron社のStentrodeは、血管内に留置する侵襲型BCIであり、思考によってデジタル端末を操作することを可能にする重度麻痺患者向け技術だ。認知結合の強さとしては現在最上位に位置し、装置は常時神経信号を取得し、日常作業に直結する。

一方、LIFESCAPEが開発を進める医療用BMI(手指タイプ)は非侵襲だが、神経リハビリの現場で脳波‐電気刺激‐装具を統合した閉ループ型システムを構成し、臨床的依存度は高い。いずれも医療機関と製造販売業者にデータ制御が強く集中する構造にある。

また、NeuralinkのPRIME試験が米国で進み、英国でも参加者報告が出るなど、侵襲的BCIは「思考によるポインタ操作」から将来的な視覚・言語・記憶補綴へと拡張しつつある。これは記憶の外在化をはるかに超えた、神経信号のリアルタイム解読という新次元の問題を提起している。

補助記憶AI・意思決定AI:「外部記憶の常在化」という新しい形

PLAUD NotePinのような常時録音・文字起こしデバイスや、Ubieのような症状管理・継続対話型AIは、身体内には入らないが、会話履歴や症状履歴を継続的に蓄積し、それを後続判断の前提とすることで「外部記憶の常在化」を実現する。

これらはオットーのノートの現代版に最も近い事例といえる。違いは、ノートが受動的な記録装置だったのに対し、補助記憶AIは予測・提案・選別・学習・再配置を行う能動的な推論主体である点だ。この能動性が、自己の連続性をプラットフォームの持続性に依存させる新たなリスクをもたらす。

AR/MR:タスク限局的な高強度融合

HoloeyesやMicrosoft HoloLensを用いた手術支援システムは、術者の視野に情報をオーバーレイし、視覚‐判断‐運動のループに直接入り込む。装置は取り外し可能でも、使用中の融合度はきわめて高い。術中における意思決定責任の配分は、このタスク限局的な高強度融合を念頭に置いた制度設計を要する。

哲学的含意——自己同一性・責任・プライバシーの変容

自己同一性はどこまで伸びるか

補助記憶AIや継続対話型AIが、直前の会話、過去の受診歴、作業履歴、注意状態を学習し、次の判断候補を先回りで整形し始めるとき、自己の連続性は生物学的記憶だけでなく、プラットフォームに保持された外部記憶の持続性にも依存するようになる。

これは自己同一性を「内面的核」としてではなく、外部化された記憶と予測の連鎖として捉え直すことを迫る。プラットフォームが停止したとき、あるいはデータが改ざんされたとき、「私」の何が失われるのか——この問いは哲学的思考実験を超え、法的に問われるべき問題へと変わりつつある。

責任の多層的分解

AIが意図形成・推論生成・提示・承認・実行・事後ログ管理の各層に関与する状況では、損害発生時に「誰が責任を負うのか」を単純化できない。利用者の意図形成、製造業者の設計、医療機関の運用判断、プラットフォームのデータ管理——これらはすべて責任の分有者となりうる。

「human-in-the-loop」という言葉だけでは不十分だ。誰がどの時点で認知権限を持っていたかを具体的に可視化する設計こそが必要とされている。

認知的プライバシーという新しい権利概念

European Data Protection Supervisorは、神経データが個人を一意に識別しうること、AIとの組み合わせによって精神状態・好み・ストレス・疲労・認知負荷などの推定が可能になることを強調している。

ここでのプライバシーはもはや「記録された情報を隠す権利」ではない。思考・感情・注意・記憶の可読化と操作可能性から自己を守る権利、すなわちメンタル・プライバシー、メンタル・インテグリティ、認知的自由へと変質している。

法的含意——現行制度の限界と各法域の対応

現在、日本・米国・英国・EUのいずれも「人間‐AI複合体」を独立の法主体として承認していない。既存の制度が断片的に適用される構造になっており、その分断こそが問題の核心だ。

日本では、個人情報保護法、民法709条、製造物責任法、薬機法が基本的な対応枠組みを構成する。医療機器・BCIについてはPMDAの専門部会が整備を進めているが、消費者向け神経データや「認知的依存」に特化した規律は未成熟な状況にある。

米国は包括的な連邦プライバシー法を持たず、HIPAAは対象主体が限定される。FTCの健康侵害通知規則がPHR事業者等を規律し、カリフォルニア・コロラドが州法で神経データ保護を明文化した。医療機器については、FDA承認の態様によって連邦法が州法請求を排除する構造が複雑さを生んでいる。

EU/UKはGDPR・EU基本権憲章・AI法・医療機器規則の重層構造で対応し、最も体系的な保護を提供している。2024年改正製造物責任指令がAI損害にも適用可能な枠組みを提供する一方、AI Liability Directive案は正式に撤回された。

注目すべき先例として、米最高裁のRiley判決(携帯電話のデジタル情報を逮捕随伴捜索の通常対象と同列視できないとした判断)やCarpenter判決(継続的位置情報の包括的記録性を保護した判断)がある。BCIや補助記憶AIを直接扱ったものではないが、拡張された記憶・行動ログが「身体外にあっても自己に密着した法的利益」として理解され始めていることを示す重要な先例となっている。

政策提言——「認知結合の強さ」に応じた層別規制へ

拡張マインド的なAI統合に対する政策の焦点は、AI一般を一括規制することではなく、認知結合の強さに応じた層別規制へ移るべきである。

第一に、神経データと認知バイオメトリクスの高感度データ化が必要だ。保護対象は脳波などの生信号にとどまらず、そこから推定される注意・疲労・感情・好み・記憶傾向までを含める必要がある。EDPS・OECD・UNESCOはいずれも、この層のデータに特別保護が必要であることを示している。

第二に、「認知結合型AI」への再設計である。侵襲性・常時計測性・受動収集性・推論の自動性・行為ループへの直接接続・退出困難性の六要素でリスクを区分し、高結合型には強化同意・第三者監査・デフォルトのローカル処理・強制的ログ保存・性能更新時の再承認を要求することが望ましい。

第三に、可逆性の権利としての制度化が求められる。高結合型システムにはデータエクスポート、モデル履歴の可搬性、安全停止、代替手段への移行を義務づけるべきだ。可逆性は倫理的望ましさではなく、自由と自己同一性を守る実務的条件である。

第四に、責任の階層的分解と記録が不可欠だ。「利用者が最終承認したから本人責任」という単純化は高結合型には通用しない。モデル設計・UI/UX・学習データ・更新履歴・監督体制が認知判断を実質的に形成するため、各層の責任を記録可能にする設計が必要となる。

第五に、医療用・消費者用の二分法を超えた機能的アプローチへの移行だ。用途表示ではなく、収集データの性質と介入強度で規律を決めることが、テクノロジーの実態に即した規制設計につながる。

まとめ——ガバナンス不能な依存こそが問題の核心

拡張マインド理論は、AI統合を考えるうえで今なお最強の出発点である。しかし1998年当時の「外部ノート」という問題設定では、現代のAI統合を十分に捉えられない。現代の問題は、外部媒体が受動的記録装置ではなく、予測・提案・選別・学習・再配置を行う能動的な推論主体である点にある。

問うべきは「心はどこまで伸びるか」だけでなく、「その伸びた部分を誰が設計し、誰が監督し、誰が止められるのか」だ。不可分性の核心は、外在化それ自体ではなく、ガバナンス不能な依存にある。

法制度は現時点で断片的対応にとどまっているが、神経データの高感度化、認知結合の層別規制、可逆性の権利化、責任の階層的分解という方向性は、今後の研究と政策立案が共有すべき実践的な課題として浮かび上がっている。

コメント