科学教育にAIを導入する前に知っておくべき本質的な問い

「AIを理科の授業に使いたい」——こうした声は今や珍しくない。しかし、ツールの選定や使い方を誤ると、提出物の見栄えだけが向上し、肝心の「理科の見方・考え方」が育たないという逆効果を招く恐れがある。

科学教育におけるAI活用は、単なるテクノロジー導入ではなく、**「学習活動の設計問題」**として捉える必要がある。観察・実験・考察・議論・振り返りという探究のプロセスそのものが学習成果であり、AIはそのプロセスを「短絡」させるのではなく「拡張」する形で組み込まなければならない。

本記事では、目的・学年・科目・AI技術の4軸を横断した設計指針と、実際の導入ロードマップを体系的に解説する。教員・教育管理職・カリキュラム設計者のいずれの立場からも参照できる実践的なガイドとして活用してほしい。

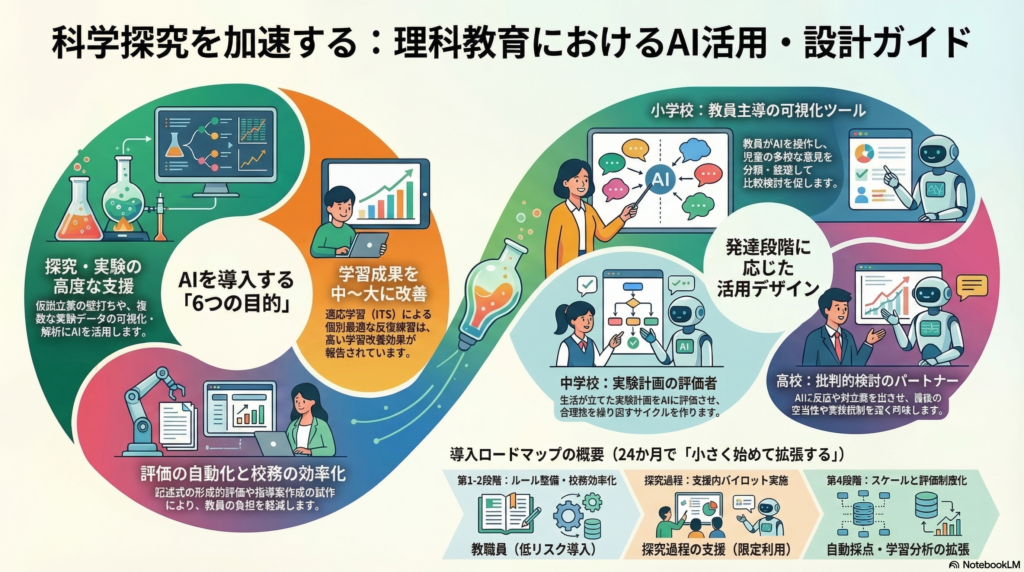

科学教育でAIを活用する6つの目的類型

AIを導入する前に、**「何のためにAIを使うのか」**を明確にすることが最優先事項だ。目的が曖昧なまま導入すると、AIが「作業の外注先」になりやすく、学習効果が出にくいばかりか、思考力の低下を招くリスクもある。

科学教育におけるAI活用の目的は、大きく以下の6類型に整理できる。

① 学習成果向上(概念理解・技能定着) 適応学習システム(ITS)やAIドリルによる弱点診断と個別最適な反復練習が主な用途。物理の計算問題や化学の基礎知識の定着に効果的とされており、複数のメタ分析で中〜大の学習改善効果が報告されている。

② 個別化学習(適応教材・学習計画支援) 学習者の理解度や進度に応じてコンテンツや難度を自動調整し、一人ひとりに最適化された学習体験を提供する。問題の難度・フィードバックのタイミング・学習計画のいずれを個別化するかを事前に明確化することが設計の要点となる。

③ 探究・実験支援(仮説・計画・データ解析・考察支援) 実験前の仮説立案、実験計画の吟味、実験データの可視化・解析、考察の妥当性検討など、探究の各フェーズでAIを活用する。特に「AIに実験計画を評価させ、計画を練り直す」という中学校での実践事例は注目に値する。

④ 科学的説明・議論支援(論証・反証・根拠の可視化) 生成AIを「批判的検討の相手」として使い、仮説の対立案生成・反証可能性チェック・変数統制の助言・既存知識との矛盾検出などに活用する。高校の理数探究では特に有効な活用シーンだ。

⑤ 評価の自動化・高度化(形成的評価・フィードバック) 記述式の形成的評価、科学的説明文の改善支援、議論の質評価などにNLPや生成AIを活用する。ただし自動採点の妥当性・公平性の監視は不可欠であり、AI採点の単独使用は避けるべきだ。

⑥ 教員の授業設計・校務効率化 指導案・問い・ルーブリックの試作、連絡文・集計など校務の効率化。低リスクで始めやすいため、最初の導入ステップとして推奨される。

AI技術別の教育効果と限界——比較的視点で見る

生成AI(LLM):最も期待され、最もリスクも高い

生成AIは対話的な学習支援・探究の仮説生成・科学的説明の比較検討など幅広い場面で活用できる。メタ分析では学習パフォーマンスや高次思考への正の効果が報告されているが、教育目的のない利用は学習効果が出にくく、むしろ学習を損なう可能性がある。

特に注目すべきは、GPT-4ベースのチュータリングを使った実験研究の結果だ。標準UIで無制限に利用した場合、練習課題の成績は向上しても試験成績が悪化するケースが報告されている。一方、段階的ヒント・根拠要求・解答抑制といった「ガードレール付き設計」では、こうした負の効果が緩和されることも示されている。

つまり**「生成AI=万能チューター」ではなく、「教育用に設計されたAI」**という条件が、学習効果を左右する最大の要因となる。

| 観点 | 詳細 |

|---|---|

| 主な用途 | 説明・質問生成、仮説立案、反証提示、科学リテラシー育成 |

| 適用しやすい学年 | 中学・高校・大学(小学校は教員主導が基本) |

| 期待効果 | 探究プロセスの深化、批判的思考の促進 |

| 主なリスク | ハルシネーション、学習の外注化(クラッチ化)、個人情報リスク |

| 設計の要点 | 解答生成より、段階的ヒント・誤り検出・振り返り誘導でガードレールを設ける |

適応学習システム(ITS):エビデンスが厚い定番ツール

ITSは複数のメタ分析で中〜大の学習改善効果が報告されており、通常授業と比較して有意な成績向上が多数の評価で示されている。基礎的な概念理解と技能定着に特に有効だ。

ただし、効果の大きさはテスト内容と指導目標の整合性・実装の質・対照条件によって変動し得ることに注意が必要だ。また、倫理・公平性の観点からの検証が研究上不十分な場合もある。

仮想実験・シミュレーション:安全とコスト制約を超える

VRやデジタルラボなどの仮想実験は、安全上の制約がある化学実験や、費用・機材の問題でなかなか実施できない実験を代替できる。没入型・ゲーム化されたシミュレーションでは学習成果と動機づけの向上が報告されている。

重要なのは**「仮想→現物、現物→仮想」の往還設計**だ。仮想実験だけで終わらせず、実際の操作技能との接続を必ず設計に組み込む必要がある。

画像認識・NLP:科目特性に応じた活用を

生物種の同定・岩石分類・顕微鏡画像の分析など、「分類を通じた概念形成」に画像認識AIは相性が良い。特に市民科学由来のデータセット(iNaturalist等)は、AIの限界(データ偏り・希少種での精度低下)を体験的に学ぶ教材にもなる。

NLPを用いた自動採点は形成的評価の迅速化に貢献できるが、性別・言語背景による群間バイアスの監視が不可欠であり、人手採点との二重評価が推奨される。

学年別・科目別の学習活動デザインパターン

小学校:教員主導での集約・比較活用

小学校段階では発達段階と生成AIの年齢制限(規約の確認が必須)を踏まえ、原則として教員がAIを操作し、学習者の思考を可視化・整理するために使う。

たとえば「てこのはたらき」の授業では、児童の仮説をフォームで収集し、教師がAIで分類・整理して全体に提示することで、多様な意見の比較検討が促進された事例がある。一方、AIが未習の高度知識を混入させる可能性があるため、教師の補足説明が必ずセットになる点に留意が必要だ。

中学校:実験計画の吟味と考察の妥当性検討

中学校は「観察・実験→分析→解釈→議論」の探究過程を学ぶ段階であり、AIを**「実験計画の評価者」**として位置づけると効果的だ。

「水溶液の見分け方(酸・アルカリとイオン)」の実践では、生徒が実験方法を立案し、その合理性を生成AIに評価させて計画を練り直すというサイクルが報告されている。ただし、AIの評価をそのまま受け入れる生徒が出やすいため、**「AIの特性理解(誤り・偏り・根拠不在)をメタ学習目標として明示する」**ことが設計上の必須条件となる。

高等学校:批判的検討の相手としての生成AI

高校では、探究過程(課題設定・方法選択・結果表現)を重視し、成果より過程を評価する設計が求められる。生成AIは科学的説明を「代替生成」する道具ではなく、以下の用途に絞るのが効果的だ。

- 仮説の対立案の生成

- 反証可能性のチェック

- 変数統制に関する助言

- 既存知識との矛盾の検出

高校での注目事例として、LLMの原理とハルシネーションを題材に、既知情報でAIに意図的に「ウソ」を起こさせ、それを検証するという授業が報告されている。これは科学リテラシー(情報の信頼性を評価する能力)を理科で扱う方法論として非常に示唆に富む。

大学・高専:学術的誠実性と評価設計の再構築

大学では生成AIの利用可能性を前提に、評価設計そのものを再構築する必要がある。口頭発表・実演・プロセス提出(探究ノートとAI利用ログの二重提出)など、AI利用では代替できない形での評価に転換することが国際的にも推奨されている。

一律禁止ではなく「授業ごとの方針を明示し、思考過程の訓練を重視する」というアプローチが、日本の大学でも示されている。

評価設計とガバナンス:見落としがちな4つの観点

評価は「4つの軸」で設計する

AIを活用した科学教育の成果測定は、知識・技能のテストだけでは不十分だ。以下の4軸で評価を設計することが推奨される。

A:概念理解・技能(学習成果) 単元テスト・概念マップ・誤概念診断・実験技能チェックリスト。

B:探究能力(プロセス) 課題設定の適切さ・変数統制・証拠に基づく結論・反証や限界の記述。PISA 2025の科学的リテラシー枠組みとも整合する。

C:科学的説明・議論の質(論証品質) Claim–Evidence–Reasoning(CER)枠組みに基づき、根拠の適合性・因果の妥当性・反例の検討・引用の適切さを評価。

D:ガバナンス指標(安全・公平・運用) 個人情報入力の遵守率・ログ監査の実施率・AI使用の申告率・自動採点の群別公平性(性別・言語背景等による差異の監視)。

必須のガバナンス設計

個人情報保護 個人情報保護委員会は、個人データを含むプロンプトが、同意なく機械学習に利用される可能性を指摘している。教育現場では「入力してよい情報」「入力してはいけない情報」を学年段階に応じて明文化し、契約・規約に落とし込む必要がある。

情報セキュリティ ゼロトラスト的なアクセス制御の強化と、教育情報セキュリティポリシーの見直しが前提となる。

著作権 教科書画像・論文PDF・写真などの入力素材の権利関係、生成物の二次利用条件を授業設計時に明確化する。文化審議会のガイドラインを参照することが推奨される。

年齢適合性 UNESCOは生成AIとの独立した対話に年齢制限を設けることを含む、人間中心・年齢適合のアプローチを提起している。

段階的実装ロードマップ:24か月で「小さく始めて拡張する」

科学教育へのAI導入は、以下の4段階で段階的に進めることが合理的だ。

第1段階(導入前提整備) 情報セキュリティと個人情報のルールを先に固める。入力禁止情報・学習利用の有無・ログ監査体制・保護者への説明を明文化する。

第2段階(低リスク導入) 校務の効率化(要約・集計・連絡文)と教師の授業設計支援(問い・ルーブリック試作)から開始。失敗リスクが低く、教員のAIリテラシー向上にも貢献する。

第3段階(授業内パイロット) 理科では「仮説・計画の比較」「実験計画の合理性評価」など探究過程を深める用途に限定し、AIの誤り検証を学習目標に明示的に含める。

第4段階(スケールと評価制度化) 自動評価・学習分析を拡張する場合は、妥当性・信頼性・公平性(群別指標)を制度化し、AI採点の単独使用を避ける設計を維持する。

教員研修の4モジュール構成

| モジュール | 内容 | 目安時間 |

|---|---|---|

| M1:AIリテラシー | LLMの仕組み・ハルシネーション体験(理科題材で) | 2〜3時間 |

| M2:授業デザイン | 探究過程×AI活用のテンプレ化、ガードレール設計 | 半日×2回 |

| M3:評価設計 | 形成的評価と総括評価の分離、ルーブリック設計 | 半日 |

| M4:法務・倫理・セキュリティ | 入力禁止情報・著作権・教育情報セキュリティ | 2時間 |

研修は「操作研修」のみでは効果が出にくい。科学教育の探究過程に接続し、ガードレール設計まで含めることが重要だ。

まとめ:「禁止か自由か」ではなく「設計された活用」へ

科学教育におけるAI活用の成否は、技術の選択よりも**「学習活動の設計」**にかかっている。生成AIをはじめとするAIは、教育目的を明確にしないまま導入すると、学習の代替(クラッチ化)という最も避けたい結果を招く可能性がある。

一方、段階的ヒント・根拠要求・誤り検出・振り返り誘導といったガードレールを備えた設計のもとでは、探究学習を深める有力な道具になり得る。

政策・実践の双方に求められるのは「禁止か自由か」の二択ではなく、目的別に許容される利用+必須のガードレール+評価の再設計をセットで提示することだ。

コメント