なぜ今、AIガバナンスに「生態学」の視点が必要なのか

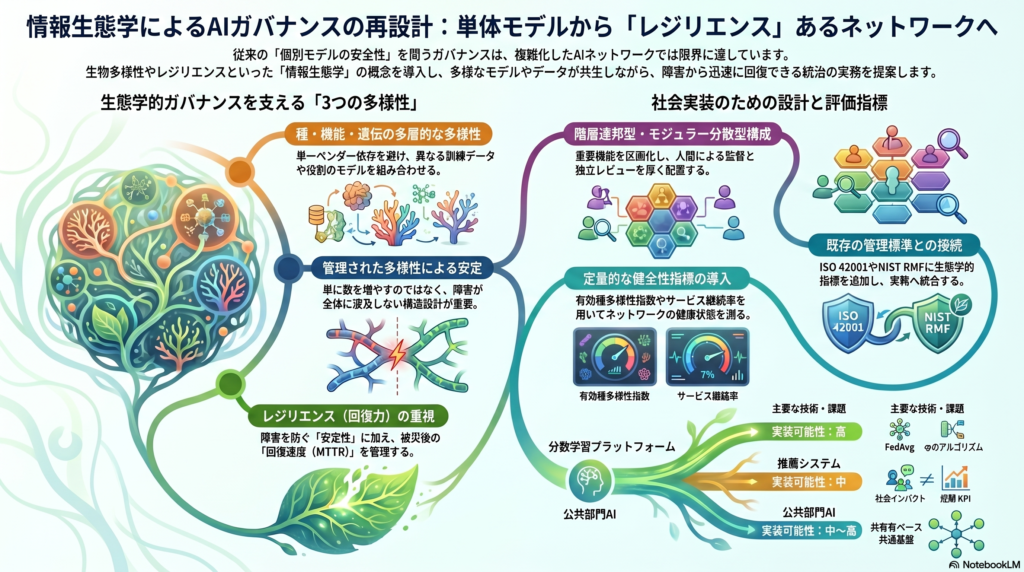

AIが単体のツールから相互接続したネットワークへと進化するにつれ、従来の「個別モデルの安全性・適法性」を問うだけのガバナンスには限界が見えてきた。複数のモデル、データソース、運用者、調達制度が絡み合う環境では、一つのノードの障害が連鎖的にシステム全体へ波及する可能性がある。また、特定ベンダーへの過度な集中や、学習データの同質化が進むと、ネットワーク全体の脆弱性が静かに高まっていく。

こうした課題に対して有効な設計思想として注目されているのが「情報生態学」のアプローチだ。Bonnie NardiとVicki O’Dayが提唱したこの概念は、AIを人・実践・技術・価値が局所環境で相互作用する複合システムとして捉える。多様性、局所性、共進化、キーストーン種という生態学の概念をAIネットワークに応用することで、「崩れにくく、戻りやすい」ガバナンス設計が見えてくる。

本記事では、情報生態学の理論的枠組み、日本の制度環境との接点、そして分散学習・推薦システム・公共部門AIへの具体的な実装可能性を順に整理する。

情報生態学とAIガバナンス:基本概念の対応関係

情報生態学が描く「AIネットワーク」の姿

情報生態学は技術を単体ツールとしてではなく、「ローカルな環境における人、実践、技術、価値のシステム」として理解する立場だ。この視点からAIネットワークを見ると、単なるモデルの集合体ではなく、モデル・データ源・監督者・運用者・利用者・調達制度・標準・監査機関が有機的につながった複合体として捉えられる。

この枠組みで特に重要な概念が「多様性」「キーストーン種」「局所性」「共進化」の四つだ。生物多様性条約が種内・種間・生態系の三層で多様性を定義するように、AIネットワークの多様性も複数の次元に分解して考える必要がある。

- 種多様性:モデル族・ベンダー・ノード・データ提供主体の複線化。単一ベンダーへの依存や単一障害点を抑える役割を担う。

- 機能多様性:生成、分類、検索、監査、安全制御、人間審査といった役割の分化。障害の局所化と説明責任の分担を可能にする。

- 遺伝的多様性:訓練データの来歴、モデル重みの系譜、目的関数、評価ベンチマークの多様性。モデル崩壊や分布の裾の消失を防ぐ。

「多様性は自動的に善ではない」という重要な留保

ここで一つの重要な注意点を押さえておく必要がある。生態学の安定性研究が示すように、複雑であれば安定するわけではない。ランダムな複雑化はむしろ不安定性を高める可能性があり、ネットワーク構造が適切な場合に限って安定性は向上する。

AIの世界でも同様だ。推薦システムではアルゴリズムのフィードバックループが利用者行動を均質化し、生成AIでは合成データの反復学習が「モデル崩壊」を招きうる。分類器アンサンブル研究では、多様性は重要でも、その測定も効果も単純ではないことが示されている。

したがって、AIガバナンスにおける生態学的アプローチの核心は「モデル数を増やすこと」ではなく、管理された多様性を維持しつつ、局所障害を全体障害に転化させない構造を作ることにある。

レジリエンスと安定性の使い分け

生態学からAIガバナンスへの翻訳でもう一つ重要なのが、「レジリエンス」と「安定性」の区別だ。Hollingのレジリエンス論は、撹乱前の定常性能(安定性)だけでなく、撹乱後の吸収・再編・回復能力(レジリエンス)を別々に測る必要性を示している。

さらにThébaultとFontaineは、ネットワークの結び方によって安定性が異なることを論じた。相互利益型ネットワークでは高接続・ネステッド構造が安定化しやすいが、捕食型ネットワークでは区画化と弱結合が安定性を高める。これをAIネットワークに引き直すと、知識共有・支援・検索のような相互利益層は連携性を高めてよいが、意思決定・執行・高インパクト判断のような高リスク層は区画化・弱結合・フェイルセーフを優先すべき、という設計指針が導かれる。

日本の制度環境:生態学的ガバナンスを受け入れる「下地」

AI法・人工知能基本計画・事業者ガイドラインの三点セット

日本では2025年以降、AIガバナンスの制度的足場が急速に整いつつある。AI法は2025年6月に公布・一部施行され、同年9月に全面施行された。続く2025年12月には初の人工知能基本計画が閣議決定され、「イノベーション促進とリスク対応の両立」「アジャイルな対応」「内外一体での政策推進」という三原則が示された。

AI事業者ガイドラインは2024年のVer1.0以降更新が続き、2026年3月末時点でVer1.2が最新版となっている。更新可能なソフトロー・国家基本計画・安全評価機関(AISI)という三点セットは、生態学的指標を「上乗せ」する条件として機能しうる。特に総務省系の「AIネットワーク社会推進会議」が2020年代初頭から「AIを結節したネットワークをどう統治するか」という発想を積み重ねてきた点も注目に値する。

AISIのAI-IRSが生態学的ガバナンスの実務接点になる

日本AISIは安全性評価・標準化推進・評価ツールの整備に加え、2026年にはAI-IRS(AIインシデントレスポンス枠組)を提示している。障害後の復旧速度(MTTR)、継続率、代替モデルへの移行可能性を管理対象にするというAI-IRSの考え方は、生態学的ガバナンスが求める「回復力の制度化」と直結する。

既存の管理システム標準との接続も容易だ。ISO/IEC 42001(AIマネジメントシステム)やNIST AI RMF(Govern/Map/Measure/Manageの四機能)は、いずれも継続的観測・管理・改善のサイクルを持つ。ここに多様性・系譜・MTTRという生態学的指標を追加することは、「新しい法体系を作る」のではなく、「既存の管理システムに視点を補う」という形で実現できる。

実装可能性の領域別評価:どこで機能し、どこで摩擦が起きるか

分散学習プラットフォーム:実装可能性が最も高い領域

病院・自治体・企業グループのように、データの局所保持が必要でかつ共同学習の便益が大きい領域では、生態学モデルとの相性が最もよい。

工学的な部品はすでに揃っている。FedAvgは局所データを持つ多数ノードから共有モデルを学習する基本形を提供し、FedProxはシステム・統計ヘテロ性への対処を可能にする。Agnostic FLは単一分布への過適合を避け、q-FFLはノード間の性能不公平を緩和する。攻撃耐性にはKrumやSignGuardが対応する。

これらの分散学習アルゴリズムにAI事業者ガイドラインの主体別責任、NIST AI RMFの測定・管理、AISIのインシデントレスポンスを重ねれば、「学習アルゴリズム」と「統治アルゴリズム」を接続した設計が実現する。実装の難所はモデル性能よりも、共通スキーマ・ログ・参加インセンティブ・離脱時のポータビリティの整備にある。

推薦システム:影響が大きいが摩擦も大きい領域

推薦システムでは、生態学的アプローチは「利用者体験の多様性」と「サプライ側の生態系維持」を同時に扱える点で有望だ。候補生成モデル・ランキングモデル・安全フィルタ・少数カテゴリ保護ルール・人間審査を機能分離し、探索配分と因果補正(CAFL)を導入することで、自己強化ループの緩和が可能になる。

しかし現実には、クリック率や滞在時間が即時KPIとして強く働くため、多様性維持はしばしば後景化する。Chaneyらが示したように、推薦データが過去の推薦の影響を受けることで行動の均質化が進む。ガバナンス論点は、短期最適化と生態系の長期健全性を同じKPI体系に統合できるかどうかに集約される。実装可能性は中程度だが、社会的影響の大きさから優先度は高い。

公共部門AI:共通基盤と局所性の両立が鍵

公共部門では、デジタル庁のガバメントAI「源内」が近縁事例として示唆的だ。政府職員向け生成AI利用環境として、政府共通データセット・行政実務用AIアプリ・可視化ダッシュボード・段階的展開・他府省庁支援を組み合わせたこのシステムには、情報生態学でいう「局所性」「機能多様性」「キーストーン種」の構図がすでに存在する。

自治体横断での展開を考える場合、重要なのは地域差を均一化することではなく、共通基盤を保ちつつ局所的な業務ルールを保持することだ。中央集約型より階層連邦型の方が、生態学的にも行政実務的にも適合しやすい。課題は、調達・機密区分・監査・住民への説明責任・自治体間の技術格差の管理にある。

評価指標の設計:「測れること」が実務化の条件

生態学的ガバナンスが実務で機能するには、「多様性は重要」という抽象論を超え、定量的な指標体系が必要だ。評価指標は少なくとも次の四群に整理できる。

多様性指標としては、有効種多様性指数(モデル族・ベンダー集中の把握)、機能被覆率(必要機能数に対するカバー率)、系譜多様性(独立来歴ブランチの比率)が挙げられる。機能多様性研究が示すように、「何種類あるか」だけでなく、「どの程度均衡し、どの程度異なる機能を担うか」を分けて測ることが重要だ。

レジリエンス指標では、MTTR(平均復旧時間)、サービス継続率、最大連結成分比(障害時のネットワーク連結性)が中核になる。撹乱前の定常性能だけでなく、撹乱後の回復速度と回復品質を管理対象にすることが求められる。

公平性指標では、最悪群の性能差(最も不利なノード群の性能を平均と比較)を継続監視する。q-FFL系の手法と組み合わせることで、ノード間格差の拡大を早期検知できる。

ガバナンス運用指標としては、ログ完全性・審査再現率・インシデント報告時間が重要だ。技術そのものより、運用証跡を残せるかがボトルネックになりやすい。

実装における三つのアーキテクチャ選択肢

単一集中管理型:低コスト・高リスク

中央基盤に単一の主モデルを置き、監視と制御も中央集約する構成。導入が速く監査線が短いが、単一障害点・同質化・ベンダーロックインのリスクを抱える。低リスク業務や小規模組織では合理的な選択肢となる。

階層連邦型:医療・行政・大企業グループに最有望

局所ノード→地域集約→中央統合の三層構造。局所性と全体学習の両立が可能で、監査も分担しやすい。ただし調達コストが増え、集約層がキーストーン種として重点管理対象になる。

モジュラー分散型:高インパクト業務・公共AIで有力

機能別サブモデルをルータで連携し、重要機能は区画化する設計。高いレジリエンスと障害局所化が実現できるが、観測・責任分界が複雑になり、運用成熟度が必要だ。

推奨は二層構成だ。検索・要約・支援のような相互利益層は連結性を高め、意思決定・執行・権利制約に関わる層は弱結合・人間監督・独立レビューを厚くする。この分離は、生態学の安定化原理をAIアーキテクチャへ翻訳したものだ。

まとめ:漸進的アプローチで始める生態学的ガバナンス

情報生態学的視点からのAIガバナンスは、既存の制度を置き換える新しい法体系ではない。リスクベース規制・ソフトロー・管理システム標準の上に、多様性・局所性・回復力・来歴管理という観点を追加していく漸進的なアプローチとして理解するのが最も実装しやすい。

短期的な優先事項は明確だ。AI事業者ガイドラインのチェックリストに「多様性」「来歴」「MTTR」を追加し、高リスク用途では最低限のモデルレジストリとログ台帳を整備することから始められる。中期的にはJIS/ISO・NIST・AISIを横断した評価票の整備と、階層連邦型パイロットの実施が課題になる。長期的には、ネットワーク健全性指標を国家・国際レベルで共通化し、単一AI製品監査からAIエコシステム監査へのガバナンス対象の拡張が目標となる。

学術的実現可能性は高く、制度的実現可能性は中程度、技術的実装可能性は領域によって中〜高というのが現時点での総合評価だ。今後の研究課題は、どの多様性が実際にレジリエンスへ効くのか、どこで複雑性が逆効果になるのか、そしてそれをどの法制度・調達制度・運用指標に落とし込めるのかを、領域別に実証していくことにある。

コメント