はじめに:なぜ量子確率論が倫理判断AIに必要なのか

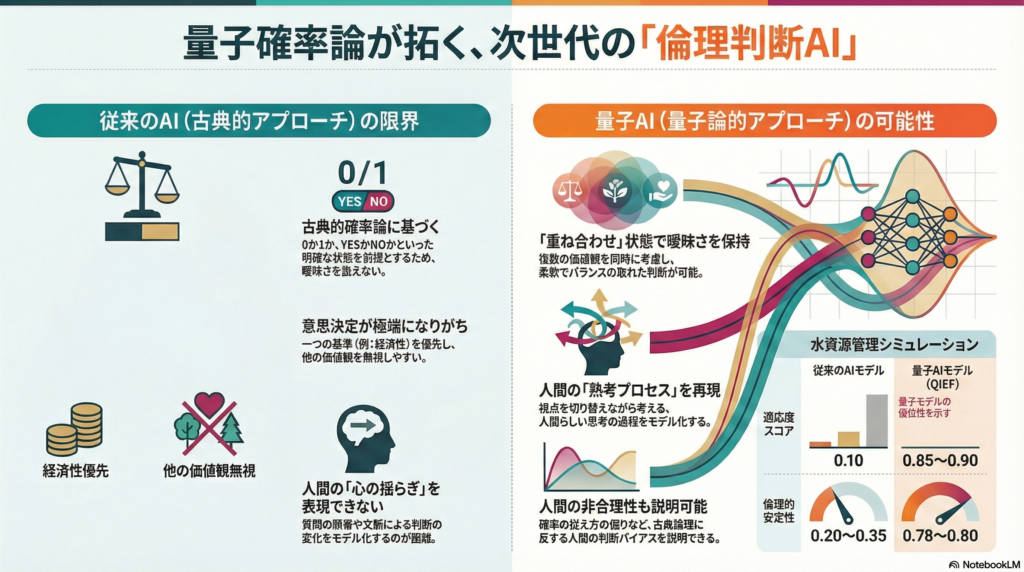

人工知能に倫理的な判断をさせるには、どのような数理的枠組みが必要なのでしょうか。従来の古典的確率論に基づくアプローチでは、人間の道徳判断に見られるあいまいさや文脈依存性を十分に表現できないという課題がありました。

実際、人間の倫理判断には質問の順番で答えが変わる「順序効果」や、選択肢の提示方法による判断の揺らぎなど、古典論理では説明困難な現象が存在します。こうした人間らしい判断の特性を捉えるために注目されているのが、**量子確率論(Quantum Probability Theory; QPT)**の応用です。

量子確率論は、ヒルベルト空間上で状態を扱う数学的形式により、重ね合わせや干渉効果、測定による状態崩壊といった概念を提供します。これらの概念を活用することで、認知過程の不確実性や文脈効果を自然に表現できる可能性があります。本記事では、量子確率論に基づく倫理的意思決定AIの最新研究動向を、設計原理、人間との一致性評価、プロスペクト理論との関係という3つの観点から解説します。

量子確率論による倫理判断AIの設計原理

ヒルベルト空間モデルで道徳的価値観を符号化する

量子確率論に基づく倫理判断AIの代表的なアプローチとして、ヒルベルト空間モデル上に道徳的価値観を符号化する手法があります。2024年に提案された量子インスパイアード倫理フレームワーク(QIEF)では、倫理原則をヒルベルト空間の直交基底状態として表現し、エージェントのモラルなスタンスを基底の重ね合わせ状態として保持します。

このモデルの特徴は、量子演算子の非可換性を利用して倫理判断のコンテキスト依存性を形式的に表現できる点にあります。問題の提示順序や文脈による影響を数理的に扱えるため、異なる価値基準間の相互依存関係をエンタングルメント(量子もつれ)によってモデル化できます。

量子状態は観測(意思決定)によって確率的に一つの結果に収束しますが、決定に至るまでエージェントは複数の倫理原則の間で「原理的な不確実性」を維持できます。これにより、危機的状況下でも特定の価値に短絡的に偏らず、複数の価値を考慮した柔軟な判断を下す能力が期待されています。

古典的手法との比較:水資源管理のケーススタディ

量子モデルの有効性を示すため、QIEFでは古典的な手法との比較シミュレーションが行われています。自治体の水資源管理を題材にしたケーススタディでは、従来型のAI(重み付けされた功利計算による意思決定)は一つの基準に極端に偏った判断を下しがちでした。

例えば、深刻な生態系危機のシナリオでは、古典的モデルは経済性を最優先するあまり生態系崩壊を招く結果となりました。一方、量子モデルを用いたQIEFエージェントはスーパーポジション状態で価値間のバランスを保ちながら状況に適応し、環境・経済・社会のバランスが取れた判断を示しています。

シミュレーション結果では、古典的モデルの適応度スコアが0.10程度であったのに対し、QIEFモデルは0.85~0.90という高い適応性を示しました。倫理的安定性指標においても、古典的モデルの0.20~0.35に対し、QIEFモデルは0.78~0.80と安定した判断を実現しています。

視点の切り替えによる熟考プロセスの再現

量子確率論的アプローチでは、重ね合わせ状態によって倫理的ジレンマ中の「葛藤」そのものをモデル内に保持しつつ、文脈に応じて状態(価値観の配分)をユニタリ変換で更新しながら最終的な判断に至ります。これは人間の熟考プロセスに類似した振る舞いと言えるでしょう。

Yilmazらの研究では、AIエージェントが一人の意思決定者として複数の視点(功利主義的な視点、規則重視の視点、関係者個人の視点など)を順番に採り入れるモデルが提案されています。このモデルでは、それぞれの視点はヒルベルト空間上の異なる基底として表現され、視点を切り替えるたびに状態ベクトルに回転(ユニタリ変換)が適用されます。

視点の適用順序によって最終判断が変わりうる(順序非可換)点が重要であり、これは量子モデルでは干渉効果として定式化されます。古典的モデルでは全視点を単一の確率空間に統合して同時評価することが前提ですが、倫理判断において視点間の前提が相互に矛盾する場合、整合的な計算ができません。量子モデルはこの問題に対し、視点ごとに固有の確率空間を用意し、それらを逐次適用することで現実の人間のような順序依存の判断プロセスを実現しています。

AIエージェントと人間の倫理判断はどこまで一致するのか

定性的な一致性:非古典的現象の再現

量子モデルは、人間の道徳判断で観察される様々な「非古典的」現象を再現できることが報告されています。例えば「リンダ問題」に代表される結合事象の誤謬では、「AかつB」の確率が「A」の確率より高く評価されるという古典確率に反する判断が知られています。古典的な論理では違背となるこの現象も、量子モデルでは文脈による確率干渉として説明可能です。

また、ディスジャンクション効果と呼ばれる現象では、不確実な状況下での意思決定が「どの結果になるか確定している場合よりも選好が逆転する」ことが知られています。これはサヴェージの確率加法則(Sure-Thing原理)の違反として問題視されましたが、量子モデルであれば不確定性下で意思決定者の内的状態が干渉項を生み出すことで説明できます。

囚人のジレンマ実験など不確実性を含む意思決定課題では、全確率の法則の体系的な違反が観察されており、古典的ベイズ推論では被験者の選択確率を再現できないケースがあります。これに対し量子確率モデルでは、二重スリット実験における干渉縞の理論になぞらえてこれらの乖離を表現でき、人間の意思決定をより正確にシミュレートできる可能性があります。

定量的な一致性:予測精度の検証

定量面では、量子モデルを用いて人間の判断データにフィットさせ、その予測精度を評価する研究が進んでいます。BusemeyerやWangらによる量子認知モデルの研究では、質問順序効果に関する精密な予測をあらかじめ立てた上で実験を行い、量子モデルの予測が実際の被験者データによって支持されることが示されています。

YukalovとSornetteらが提唱する量子的意思決定理論(QDT)では、人間がギャンブルの選択で示す一貫しないリスク選好を説明するため、客観的効用に加えて主観的な「アトラクション(魅力)」要因を確率に組み込むモデルが提案されています。このモデルから導出された「25%ルール(quarter law)」と呼ばれる予測について、27名の被験者が200通りの金銭的賭けを選択する実験で検証が行われました。

集団平均のレベルでは、QDTの予測するバイアス効果(25%程度の確率変動)が観測データとよく一致することが報告されています。個人レベルでは若干のばらつきがあるものの、QDTモデルはプロスペクト理論など既存の行動経済モデルに匹敵する説明力を示し、一部のパラドックス(選好の逆転現象など)では古典モデルを上回る適合を見せています。

倫理判断における検証の現状と課題

量子確率論に基づくAIエージェントは、人間の倫理判断の特徴(文脈依存の揺らぎや非線形的バイアス)を質的に再現できるだけでなく、適切にチューニングすれば人間の選択確率分布を定量的にも良好に予測しうることが示唆されています。

もっとも現時点では、人間の倫理的意思決定データ(例:トロッコ問題など道徳ジレンマでの選択傾向)そのものに量子モデルを当てはめて統計的妥当性を検証した研究は限られています。上述の研究は主に心理学実験や経済的意思決定における非合理性の説明に焦点が当てられており、倫理判断に特化した量子的モデルの精度検証は今後の課題と言えるでしょう。

一部にはQ方法論(主観的意見の類型化手法)と量子モデルを組み合わせ、人間の道徳判断の潜在的次元をヒルベルト空間上に定義し直そうという試みもあります。Marangoniの研究では、著名な倫理ジレンマについて専門家の反応を分析し、回答者の視点が「個人の自律」「人間の本性」「結果重視」「文脈重視」の4種類の直交するベクトル(判断基底)に分解できることを示しました。このような探索的研究は、量子モデルによる倫理判断の記述力を質的に示すものですが、モデルの予測と実際の人間行動を直接比較するには更なる大規模データによる検証が必要です。

プロスペクト理論と量子確率論の関係性

プロスペクト理論が説明する人間のバイアス

プロスペクト理論は、人間が不確実な選択肢の価値を評価する際の典型的なバイアス(例えば損失回避や確率の主観的重み付け)を説明するために提案された行動経済学の理論です。客観的な確率や金額に対し、人間は主観的な重み(非線形な確率重み関数)や価値関数(参照点に依存するS字型効用関数)を適用すると仮定します。

これにより、低確率の事象を実際以上に重視したり、中間的な確率を加法的に評価しなかったりといった古典的期待効用理論からの逸脱が記述できます。しかしプロスペクト理論を含む多くの非期待効用モデルは、あくまで経験的事実を説明するために経験則的な関数形を当てはめているに過ぎず、そのパラメータはデータから事後的にフィッティングされるものです。

量子モデルによる干渉項の理論的導入

一方、量子確率モデルは理論的に導入された干渉項によってこれらのバイアスを説明しようとします。量子モデルにおける確率の計算式では、従来の「確率 = 重み付き尤度の和」に相当する対角項に加え、異なる選択肢状態間のオフ対角項(位相付きの振幅積)が現れます。

このオフ対角項こそが文脈依存の干渉項であり、意思決定者の主観的バイアス(魅力・恐怖・曖昧さへの態度など)を符号付きで表現します。YukalovらのQDTではこれをアトラクション因子と呼び、意思決定者が選択に迷っている(選好状態が重ね合わせでエンタングルしている)ときにこの因子が0でない値をとるとしています。

明確な選好が定まっている場合(対応する射影演算子が直交する場合)は干渉項が0になり古典確率に一致しますが、複合的に迷っている場合(射影が非可換で状態が絡み合っている場合)には干渉項が0でなくなり確率加法性が破れます。この枠組みでは、人間の主観的バイアスは量子論的な「干渉項」そのものであり、その大きさや符号は判断文脈によって内在的に決まるものと解釈されます。

確率加法性の逸脱を統一的に記述する

重要なのは、これらの効果がコルモゴロフ則の形式的破れとして自然に導出される点です。例えばAllaisのパラドックス(同じ確率差であっても高確率域か低確率域かで選好が異なる)は、プロスペクト理論では確率重み関数の非線形性で説明されますが、量子モデルでは高確率選好状態と低確率選好状態の間の位相干渉の違いとして再現できます。

Yukalov & Sornetteはこの現象を「プロスペクト干渉」と呼び、エージェントが将来の結果に対し感じる漠然とした魅力・不安が干渉項を通じて意思決定に系統的偏りを与えることを示しました。さらに量子モデルでは、どのような状況で干渉項が非零となるかを原理的に条件づけることも可能です。

プロスペクト理論が経験的に導入したさまざまなバイアス(確率加重、後悔回避、楽観・悲観バイアスなど)を、量子確率論は統一的に「文脈による確率の非加法性(干渉)」という言葉で記述します。特に倫理判断の文脈では、結果の不確実性だけでなく道徳的価値観そのものの曖昧さが判断を揺らがせる要因となります。

倫理的意思決定における価値観の干渉

量子モデルは価値観の曖昧さを状態の重ね合わせとして扱い、価値観同士の競合によって生じる非線形なバイアスを内在的に計算に含めます。これは、倫理的意思決定において人間が示す確率的選好の逸脱(例えば「罪は憎いが罰するのも憚られる」といったジレンマ状況での不確定な選択傾向)を、同じ仕組みでモデル化できる可能性を意味します。

QIEFでは「経済 vs 環境 vs 公平」の価値トレードオフにおいて古典的期待効用では説明困難なバランスの取り方を示しましたが、これは量子モデルが価値基準間の干渉を通じて非線形な意思決定を行った結果と解釈できます。

プロスペクト理論と量子確率論モデルは、ともに人間の非合理的選好を説明する点で目的を共有しつつ、アプローチとしては前者が経験的フィッティングに基づくのに対し、後者はより基本的な原理(重ね合わせと干渉)からそれらを導こうとしていると言えるでしょう。量子モデルのこのアプローチは、倫理判断のように定量的データ収集が難しい領域でも原理的な示唆を与えることが期待されます。

まとめ:量子確率論が切り拓く倫理判断AIの未来

量子確率論に基づく倫理判断AIの研究は、道徳的判断の数理的理解と実用的AI設計の両面で新たな可能性を示しています。ヒルベルト空間モデルによるアプローチは、人間の倫理的意思決定に内在するあいまいさ・文脈依存性・非合理性を捉える上で有望であり、初期的な実装(QIEFなど)では古典的手法にない適応性や説明可能性を実証しつつあります。

意思決定プロセスを量子状態の変遷として追跡できる点は、AIの判断根拠を理解する上でも重要な特性です。もっとも、現段階では主に理論モデルとシミュレーションによる検証が中心であり、人間の実データとのさらなる比較検証や、大規模な実運用に耐えるアルゴリズム最適化(例:テンソルネットワークによる状態圧縮)など課題も残ります。

しかし、倫理的AIへの量子的アプローチは「曖昧さを抱えたまま判断する」ことを可能にする点で画期的であり、これはルールベースでも機械学習ベースでも実現が難しかった特性です。今後、プロスペクト理論や行動科学の知見とも連携しつつ、量子確率論モデルの高度化・検証が進めば、人間の道徳判断に整合し信頼性の高い倫理判断AIエージェントが構築される可能性があるでしょう。

コメント