AIを「現れ方」から問い直す:現象学的アプローチの意義

人工知能をめぐる議論は、性能評価・倫理規制・社会的影響の三方向で急速に展開している。しかし「AIとは何か」「人間はAIをどのように経験しているか」という根本的な問いは、技術仕様書にもガバナンス文書にも十分には書かれていない。そこで有力な視点として浮上するのが、現象学――意識経験の構造を記述する哲学的方法論――である。

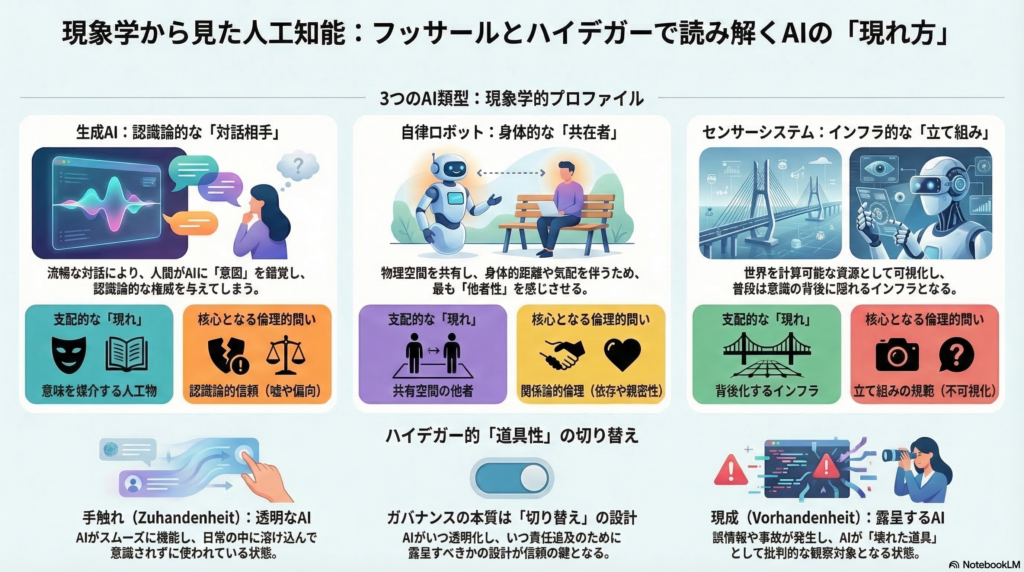

本記事では、エトムント・フッサールとマルティン・ハイデガーの現象学的枠組みを用いて、生成AI(LLMチャットボット)・移動型自律ロボット・センサーベース知覚システムという三つの代表的なAI類型を比較分析する。7つの比較軸(知覚・意識・意図性/存在論的位置づけ/道具性/自己理解・他者性/倫理的含意/技術と人間の共在/認識論的信頼性)に沿って整理することで、AIが人間の生活世界にどのように織り込まれ、どのような問いを生成するかを明らかにする。

フッサールとハイデガーの現象学:分析の理論的枠組み

フッサールの志向性・エポケー・生活世界

フッサール現象学の出発点は「志向性(Intentionalität)」である。意識は常に「〜についての意識」であり、対象へ向かう働き(ノエシス)と、対象が意味として与えられる相(ノエマ)の二重構造として精密化される。この枠組みで重要なのは、意識が対象を「受け取る」のではなく、能動的に「構成する」という点だ。

エポケー(判断停止)と現象学的還元は、世界の実在を否定する操作ではない。自然的態度において前提化されている「当たり前」(客観的実在、科学的説明の権威)を「括弧に入れ」、対象がいかに意味として成立するかという構成の過程そのものへと問いを転じる方法論である。

後期の**生活世界(Lebenswelt)**概念は、科学や技術的抽象化が成立する前提としての「生きられた世界」を指す。日常実践・身体性・共同性に根ざしたこの地盤を問い直すことで、科学的対象化の意味根拠――それが何に支えられているか――が可視化される。

ハイデガーの世界内存在・道具性・立て組み

ハイデガーは、西洋形而上学が見失ってきた「存在者(もの)」と「存在(あり方)」の区別=存在論的差異を回復しようとした。その核心的概念が「世界内存在(In-der-Welt-sein)」であり、人間(現存在)は主観として世界に向かうのではなく、始めから世界の中に実践的に投げ込まれた存在として理解される。

『存在と時間』における道具分析は特に重要である。日常の実践において道具は「手触れ(Zuhandenheit)」として、すなわち透明に機能するものとして経験される。ハンマーを打つとき、私たちはハンマーに気づかず、釘に向かっている。しかし道具が壊れたり機能しなくなったとき、それは初めて「現成(Vorhandenheit)」として、すなわち理論的観察の対象として露呈する。

後期の技術本質論では、近代技術の本質を「立て組み(Gestell/Enframing)」として定式化した。技術的な世界理解のもとで、存在者は「資源(standing-reserve)」として呼び出される様式が問題化される。AIのデータ駆動的世界把握は、この立て組みの現代的形態として読み解くことができる。

三つのAI類型の現象学的分析

生成AI(LLMチャットボット)の現象学

志向性と知覚の問題

生成AIにおける「知覚」は、テキスト入力に還元される。身体的・感覚運動的な地平はモデル内部に欠けているにもかかわらず、出力が対話の形をとるために、使用者は志向性をAI側に「帰属」しやすい。これは意味の構成がAI側にあるかのように見える「構成の短絡」であり、フッサール的なエポケーはこの錯覚を括弧に入れ、意味構成の実際の担い手(使用者)を問い直す。

LLMが基本的に「次トークン予測」に基づく統計的生成モデルであるという技術的事実は、「意味理解」ではなく「もっともらしさの生成」という認識論的位置づけに直結する。近年のLLM現象学・認識論研究は、LLMを「多機能な認知的人工物」として位置づけ、使用者が翻訳・要約・検索・発想などの認知課題を外部化する装置として分析する方向を示している。

道具性:手触れ化と現成化の切替

文章作成・要約・検索補助の場面でLLMは「手触れ」として機能する。下書き生成がスムーズなとき、AIは執筆環境に透明に溶け込む。しかし誤情報や根拠不明の出力が露見すると、一転して「現成」として対象化され、「信頼できるか」「誰が責任を負うか」という問いが噴出する。

この手触れ/現成の切替は、生成AIのリスク管理が「使用状況と評価」を重視する理由と正確に対応する。NISTのAIリスク管理枠組みが信頼性をライフサイクル全体で管理する構造は、現象学的に見れば「透明化→露呈」という切替点を制度化しようとする試みとして理解できる。

倫理的含意:認識論的権威の再編

生成AIが「流暢さで権威を帯びる」現象は、生活世界における信頼の配置――誰の言葉が権威を持つか――を再編する。説明責任・出典・偏り・誤情報という「認識論的倫理」が前面化しやすいのはこのためだ。フッサールの視点では、LLMの流暢な出力が「自然的態度」において権威として受け取られるメカニズムそのものが、現象学的反省の対象となる。

移動型自律ロボットの現象学

機能的志向性と世界内存在の問題

自律ロボットはセンサー(カメラ、LiDAR等)と身体(アクチュエータ)を介して環境内で移動・作業する。SLAM(同時地図生成・自己位置推定)や確率ロボティクスにより、環境との相互作用に「志向的らしさ」が生じる。しかしこれは確率推定と制御の連鎖として設計された「機能的志向性」であり、フッサール的な一人称経験としての志向性とは厳密に区別される。

ハイデガー的には、ロボットは「現存在(Dasein)」ではない。「自己の存在が問題となっている存在」という現存在の規定をロボットに適用するのは概念の誤用になりやすい。しかし現象学が問うのは「現れ」である。共有空間で移動・回避するロボットは、生活世界の秩序(通路、障害物、他者の振る舞い)に巻き込まれ、他者性が生じやすい。

擬人化と関係性の構成

ロボットの擬人的振る舞いは「代理的な相手」としての他者性を誘発し、関係性を構成する。人間‐ロボット関係論の現象学的アプローチは、ロボットが「他者であるか」を形而上学的に決着させるのではなく、介護・教育・公共空間という具体的状況における現れと規範期待の生成として記述する方向を示している。

共在の厚さ:身体的次元

自律ロボットとの共在は、身体的距離・危険・気配といった前反省的次元を含むため、生成AIとの共在より「厚い」。ここでは人間拡張や身体‐機械境界の再編(HCI)も論点化し、AIと人間の協働が単なる情報交換を超えた身体的・空間的次元を持つことが示される。

センサーベース知覚システムの現象学

「見えている」のではなく「見えるようにした」

自動運転知覚システムに代表されるセンサーベースAIは、画像・点群・レーダーデータから物体検出・占有推定・追跡を行い、それが意思決定に接続される。フッサール的エポケーの観点から重要なのは、このシステムが「世界を見ている」のではなく、「表現形式(点群・BEV等)と学習目標により構成された計算的可視化」を行っているという点である。「見えている」のではなく「見えるようにした」結果として扱うべきだ。

インフラ化と立て組み

センサーベース知覚システムは多くの場合、ユーザーの前面に現れずインフラとして「背後化」する。運用では手触れとして透明化し、設計・監査の場面で現成として対象化されるという二重性がある。

ハイデガーの立て組み概念との接続はここで最も鮮明になる。世界が「計算可能な資源」として露呈させられるとき、何が切り取られ、何が不可視化されるかという規範的問いが生じる。センサーが「見ない」もの、モデルが分類できないもの――そこに倫理的問題の核心がある可能性がある。

物理世界への直接介入と責任

この類型は、OECD定義の「環境に影響する出力」を最も直接的に持つAIである。誤検出が重大事故につながりうるため、信頼性は技術評価とガバナンス(責任分担・監査)の両方で構成される。事故・責任追及の場面では「証拠対象」として固定化され、世界が「測定可能な資源」として露呈しやすい構造になっている。

7つの比較軸から見えるAIの現象学的地形

以上の分析を7つの軸で横断的に整理すると、三つのAI類型の差異が明確になる。

知覚・意識・意図性については、生成AIが対話形式による志向性の帰属錯覚を生じやすい一方、自律ロボットは機能的志向性により環境との相互作用が強く、センサーシステムは計算的可視化に徹する。

存在論的位置づけでは、いずれも厳密な意味での「現存在」ではないが、自律ロボットが共有空間における他者性の構成という点で最も厚い現れを持つ。センサーシステムはインフラとして背後化しやすく、存在論的問いが浮上しにくい。

道具性の切替は三類型すべてに共通するが、切替点の質が異なる。生成AIでは認識論的不信(誤情報)が切替点となり、ロボットでは物理的失敗が、センサーシステムでは事故・監査が切替点となる。

倫理的含意も三層に分かれる。生成AIは認識論的倫理(権威・出典・責任)、ロボットは関係論的倫理(依存・親密性・道徳的行為者性)、センサーシステムは安全性・説明可能性・監査可能性が核心となる。

現象学がAI研究にもたらす認識論的貢献

「なぜ信じたくなるのか」という受容の現象学

AIの信頼性をめぐる問いは、技術評価とガバナンスの問題であると同時に、「なぜ私たちはそれを権威ある言明として受け取ってしまうのか」という受容の問いでもある。フッサールの生活世界概念は、信頼・慣習・制度の地盤として機能するこの受容構造を問題化するための枠組みを提供する。

LLMの出力は「もっともらしさ」と「真理性」が乖離しうる。現象学的慎重さ、すなわち「いま何が与えられているのか」を問い直す姿勢は、実務の検証行為と接続する認識論的態度として機能しうる。

手触れ/現成の切替点を設計する

ハイデガー的分析の実践的価値は、AIが手触れ化する条件(透明な統合)と現成化する条件(破綻・監査・事故)を記述できる点にある。この切替点の分析は、設計論・評価論・制度論として展開できる可能性がある。

透明に機能するAIが突然露呈するとき、その経験は単なる「バグ」ではなく、使用者にとって存在論的なズレとして現れる。この切替をより滑らかにするか、あるいはあえて可視化するかという設計判断は、現象学的分析によって精密化できる。

立て組みとしてのデータ駆動的世界理解

ハイデガーの立て組み概念を現代AIに接続するとき、問われるのは「効率化できるか否か」ではなく、「何が見えるようになり、何が見えなくなるか」という世界理解の様式の変容である。医療・教育・公共安全・労働という具体的領域ごとに、データ駆動的世界理解が何をstanding-reserve化し、何を不可視化するかを問う研究は、今後の重要課題となるだろう。

まとめ:現象学から見たAIの三つの主結論

本記事の分析から、以下の三点が主結論として導かれる。

第一に、フッサール的には、現行のAIは意味を自律的に生起させる主体ではなく、人間の生活世界において意味が構成される際の「媒介(認知的人工物/制度化された他者)」として分析するのが最も整合的である。AIに「理解」や「意図」を帰属する日常言語は、構成の短絡として現象学的に記述できる。

第二に、ハイデガー的には、AIは現存在ではなく道具連関の中で手触れ/現成として現れ、その切替が信頼・責任・倫理の焦点を形成する。この切替点の分析は、AIガバナンスの設計と直接接続できる。

第三に、センサーベース知覚システムのような類型は、立て組みの観点から、世界理解の様式そのものを再編しうる。何が見えるようになり、何が不可視化されるかという問いは、技術評価を超えた規範的問いである。

現象学的アプローチの強みは、AIを単純に肯定・否定せず、「AIがどのように与えられるか」という経験の構造を記述しながら、その前提条件(実践・制度・技術構造)を反省的に明確化できる点にある。技術的・制度的変化が続く中で、この視点の重要性は今後も増していく可能性がある。

コメント