HITLにおける責任分担アルゴリズムが注目される理由

AI技術の社会実装が加速する中、「人間が適切な場面でAIの判断に介入できるか」という問いは、安全性とガバナンスの両面で重要性を増している。HITL(Human-in-the-Loop)とは、AIシステムの意思決定プロセスに人間が関与する仕組みを指す。しかし単に「人が関与している」だけでは安全性の担保にはならない。誰が・いつ・どの情報をもとに・どの裁量で介入するかを設計し、監査可能にすることが実務上の核心となる。

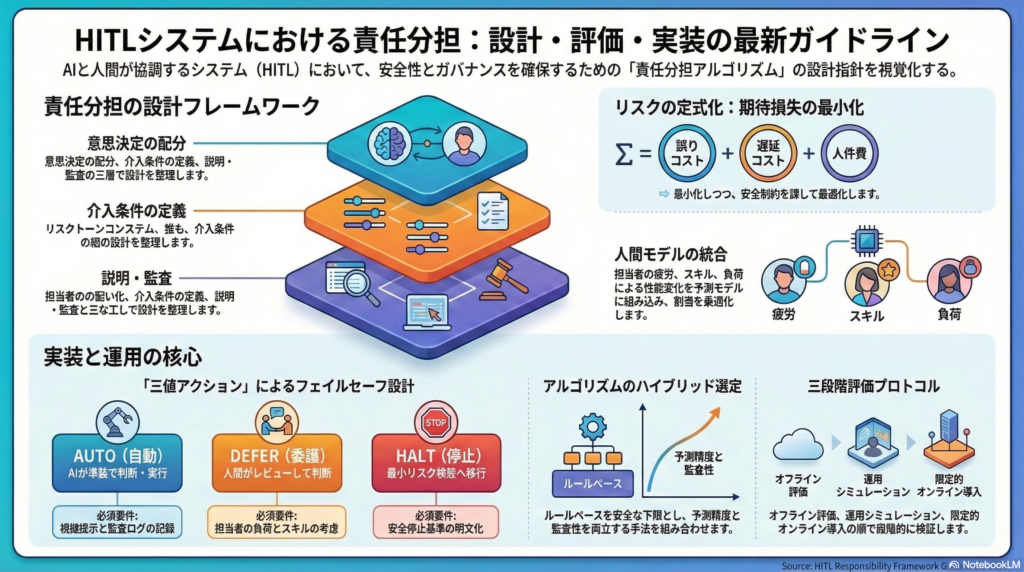

本記事では、HITLシステムにおける責任分担の最適化を、アルゴリズム設計・評価指標・ドメイン別実装の三軸で整理する。医療診断から自動運転、監視・セキュリティ、カスタマーサポート、製造ラインに至るまで横断的に通用する設計原則を示すとともに、ガバナンスと法的責任への接続についても触れる。

HITLの責任分担を「最適化問題」として捉える視点

責任分担は三層構造で整理できる

HITLにおける責任分担は、以下の三層に分解して設計するのが有効である。

第一層:意思決定の配分 AIが単独で判断するか、人間が判断するか、あるいは両者が協働して判断するかを決める層。タスクの種類・リスクレベル・可逆性などに応じて動的に割り当てる。

第二層:介入の条件設計 不確実性・リスク水準・規制要件・運用負荷などを参照し、自動処理から人への切り替えトリガーを定義する層。閾値設定・確率的リスク評価・Conformal Predictionなど複数の技術手法が選択肢になる。

第三層:説明・監査・責任帰属 介入の根拠・判断過程・最終結果をログに記録し、法的・契約的な責任分界を支える層。この層が不十分だと、アルゴリズムがどれだけ最適であっても組織ガバナンスに接続できない。

リスクは「発生確率×影響」で定式化する

責任分担の最適化における「リスク」は、単なる主観的な危険感ではなく、期待損失(誤りコスト+遅延コスト+人件費)の最小化という形で定式化できる。同時に制約として、重大危害の発生確率上限・遅延SLA・介入上限(人の稼働)・説明とログの完全性・プライバシー要件を課す構造が、ドメイン横断で実装しやすい。

この枠組みは、NIST AI RMF(GOVERN/MAP/MEASURE/MANAGE)を参照することで、リスクの文書化・管理プロセスと整合した形で運用に落とすことができる。

三値アクション設計:自動・委譲・停止を明示する

なぜ「二値」では不十分なのか

多くのHITLシステムが「AIが判断する/人が判断する」の二値でタスクを振り分ける設計を採っている。しかしこの設計には重大な盲点がある。それは**「人が今すぐ対応できない状況」**への対処が抜け落ちることだ。

たとえば製造ラインで異常を検知した際、担当者が対応中で即応できない場合、AIは自動実行か待機かの二択しかない。ここに「安全停止(HALT/SAFE)」という第三の選択肢を明示的に設計することで、リスクの高い曖昧地帯を減らすことができる。

三値アクションの定義

推奨アーキテクチャでは、各案件に対して以下の三値アクションを返す設計を採る。

AUTO(自動実行) AIが自動で判断・実行・応答する。根拠の提示と監査ログへの記録を必須とする。

DEFER(人間レビューへ委譲) 案件をレビュー担当者へ割り当てる。割当は担当者のスキル・現在の負荷・応答時間を考慮して最適化する。

HALT/SAFE(安全停止) 人の確認が来るまで実行しない、または最小リスク状態へ移行する。自動実行も委譲も安全制約を満たさない場合に発動する。

この三値化は、特に交通・製造・セキュリティ領域で重要となる。安全停止の発動基準を仕様として明文化し、フェイルセーフ経路を設計段階で確定しておくことが求められる。

アルゴリズム候補の比較と選定指針

ハイブリッドが主流になる理由

単一のアルゴリズムで責任分担最適化を完結させることは難しい。理由は、「分類精度」だけでなく、遅延と介入頻度・説明と監査可能性・法的責任の説明可能な意思決定過程を同時に満たす必要があるためだ。実務ではハイブリッド構成が主流となる。

主なアルゴリズム候補を整理すると以下のようになる。

ルールベース・閾値ベース 導入が最速で監査しやすい。「安全な下限」として最初に置ける利点がある。ただし例外や分布シフトへの対応が弱く、閾値調整が属人化するリスクがある。

確率的リスク評価(ベイズ推定等) 期待危害を直接扱える。負荷をコスト項に組み込める。事前分布の誤指定やデータ不足の場面では精度が落ちる可能性がある。

Selective Classification / Conformal Prediction 分布によらない被覆保証が強みで、予測集合が単集合なら自動・複数なら人へ委譲、という介入ポリシーを自然に構成できる。難例を人に回す設計と相性が良い。

Learning to Defer 人と機械の性能差を学習し、公平性・精度の同時改善が可能な枠組み。混雑・遅延損失を明示的にトレードオフする拡張が重要で、「人が常に即応できる」という仮定を排除できる。

強化学習(オフライン) 過去ログから方策を学習し、危険な探索を避けながら動的環境に対応できる。反実仮想推定・分布外の困難さがあり、高度な設計スキルが必要。

推奨するのは、ルール・閾値ベースを安全な下限として最初に置き、その上にベイズ的リスク推定やConformal Predictionを載せ、混雑(キュー)を含む運用コストを明示的に扱える設計である。必要に応じて安全制約付きRL/Banditへ段階的に高度化できる拡張性も重要な選定基準となる。

ドメイン別の責任分担設計ポイント

医療診断:重篤度を委譲基準に明示する

医療診断では、偽陰性(見落とし)とオートメーションバイアスによる誤判断が主要ハザードとなる。委譲基準に「重篤度」を明示的に組み込み、重篤・重大カテゴリでは独立レビューの重要性が高まる設計が必要だ。また、市販後の性能変化を含むガバナンス(市販後監視)が必須となる。

交通(自動運転):移行要求と最小リスク状態の設計

リアルタイム性が極めて厳しいドメインであり、移行要求(テイクオーバー)と最小リスク状態の設計、運転者状態監視、責任とタスクの周知(インタフェース・訓練)を制度・安全ケースと結びつける必要がある。HALT/SAFEの実行経路を最短・決定的に設計し、最悪時間を事前に仕様化することが前提となる。

監視・セキュリティ:アラート疲労への対策

アラート疲労と誤検知過多が本質的課題となる。全件人手確認は現実的でないため、低リスクの自動クローズと「監査用の標本抽出(クローズするはずだったアラートの一部を人へ送るサンプリング)」を組み合わせる設計が有効だ。これにより介入頻度を抑えながら品質監査を成立させられる。

カスタマーサポート:高危害クラスの初期固定

課金・契約変更・医療/法律/安全に関わる誘導を「高危害クラス」として扱い、これらを自動化しない設計を初期固定する。生成AIの不確実性・ばらつきに対する品質保証と監査ログの完全性を中心に組む。出典・根拠提示を必須化することも緩和策として実装しやすい。

製造ライン:安全モード遷移を外側制約として固定

ISO/TS 15066などに基づく人協働領域の安全要求を「外側制約」として固定し、その範囲内で責任分担を最適化する。作業状態に応じた安全モード遷移(速度・分離監視・停止)をアルゴリズムの外部条件として先に設計することが前提となる。

人間モデルの統合:疲労・スキル・負荷を最適化に組み込む

「平均的には正しい」では不十分な理由

人間レビュー担当者を「常に正確で即応できる存在」として設計するのは現実に反する。HITLが失敗する典型的なパターンは以下の四つだ。

- misuse(過信):AIの判断を無批判に受け入れ、重大な見逃しが発生する

- disuse(不信):正しいAI判断を人間が棄却し、精度が低下する

- automation bias(自動化バイアス):稀な失敗に対して脆弱になる

- 監視の形骸化:人が関与しているように見えて、実質的なレビューが機能しない

これらを「アルゴリズム外の注意喚起」として扱うのではなく、モデル化して最適化に組み込むことが実装上の重要な設計判断となる。

最小構成の人間モデル

実装の最小構成として、レビュー担当者ごとに「混同行列+応答時間分布」を推定し、直近の介入頻度や休憩状況で状態遷移する「作業負荷状態」を組み込む方法がある。負荷が高いときの性能劣化を前提に、休憩・交代ルールをキュー制御に統合することも重要だ。

評価指標と評価プロトコルの設計

精度中心の評価では不十分な理由

責任分担アルゴリズムの評価は、分類精度(ROC/F1)だけでは不十分だ。安全指標・遅延分布・介入頻度・費用便益・説明可能性・法令準拠を同時に扱う必要がある。特に遅延は平均値だけでなく分布(p95/p99)で管理しないと、緊急案件の破綻を見逃す可能性がある。

三段階評価プロトコル

第一段階:オフライン評価 ROC/F1・校正(ECE/被覆率)・期待危害(重み付き損失)を測定し、介入率を掃引して危害・介入・遅延のフロンティアを可視化する。

第二段階:運用シミュレーション Poissonなどの到着過程・複数レビュー者・優先度キューを用いてp95/p99遅延・SLA違反・介入集中度・疲労による品質劣化をシミュレーションする。

第三段階:限定的オンライン(段階導入) 低リスク領域でA/Bまたはシャドーモードによるオンラインテストを行い、「自動処理したはずの案件」の監査標本を常設して性能ドリフトを監視する。高リスク領域はオフライン評価中心とし、危険な探索を避ける。

ガバナンスと法的責任への接続

責任分担アルゴリズムは、技術的な最適化問題であると同時に、「誰が何を担うか」を組織ガバナンスに接続する制度設計でもある。

国内では、AI開発者・提供者・利用者の役割定義とガバナンス目標設定を求める枠組みが示されており、同一事業者が複数ロールを兼ねる場合も含めて整理されている。契約チェックリストによるリスク分配(ログ・個人情報・監査条項等)の具体化が求められる。

また、民事責任の観点では「人が関与していること=免責」とはならない。監査可能な意思決定過程の整備こそが実務上の核心であり、介入基準・停止基準・根拠提示・訓練・ログを含む「実効的な監督」の設計が問われる。

個人情報保護については、ログ保持期間・アクセス権限・目的外利用の禁止・第三者提供の整理を、契約チェックリストと整合させた形で先に決めておくことが合理的だ。

まとめ:HITLの責任分担アルゴリズム設計の要点

HITLにおける最適な責任分担アルゴリズムは、「不確実なら人へ」という単純な委譲ルールではなく、以下の四要素を同時に満たすハイブリッド設計として構築することが推奨される。

- 期待危害に基づく介入判断:確率×影響でリスクを定量化し、介入トリガーを設計する

- 人間側の処理能力を含む割当最適化:混雑・遅延・疲労を最適化の対象として組み込む

- 三値アクション(自動/委譲/停止)によるフェイルセーフ:安全停止を第三の選択肢として明示する

- 監査ログとガバナンスへの接続:誰が・いつ・どの根拠で判断したかを記録し、法的責任の分界を支える

コメント