生成AIは認知発達をどう変えるか——ピアジェ理論から読み解く

スイスの発達心理学者ジャン・ピアジェが提唱した「反省的抽象化」は、人が自らの行為や思考を振り返り、より高次のレベルへと再編成するメカニズムを指す。この理論は20世紀の認知発達研究の礎となったが、今や大型言語モデル(LLM)や生成AIという強力な外部ツールが日常に浸透しつつある現代では、まったく新しい問いを投げかけている。

「AIは人間の思考を深めるのか、それとも奪うのか?」

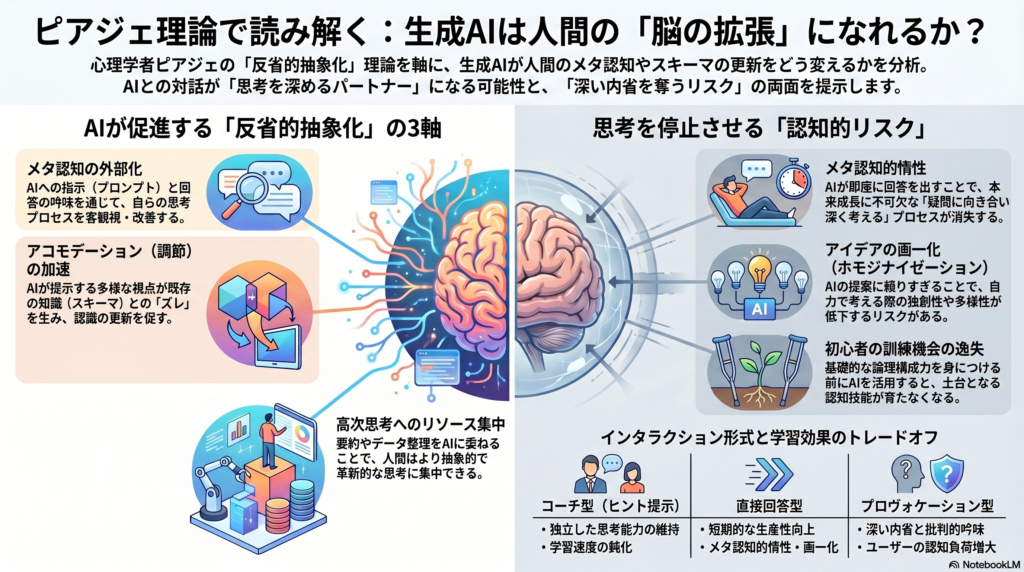

本記事では、ピアジェの理論枠組みを軸に、LLMが人間の認知プロセスに及ぼす影響を6つの視点から整理する。メタ認知の外部化やアコモデーション(調節)の加速といったポジティブな可能性から、認知オーバーフローや反省的抽象化の阻害というリスクまで、最新の研究知見をもとに考察していく。

メタ認知・アコモデーション・協調学習——生成AIがもたらす認知的変革の3軸

まず大枠として、生成AIが認知発達に関わる経路は大きく3つに整理できる。第一に、AIとの対話がユーザ自身の思考を外部化・可視化することでメタ認知(自分の認知についての認知)を刺激する経路。第二に、AIが提示する多様なアイデアや視点が既存スキーマへの「ズレ」を生み出し、アコモデーション(スキーマの調節・更新)を促進する経路。第三に、人間とAIが協調して問題解決や知識構築を進める中で協調的な反省的抽象化が生まれる経路だ。これらは独立してではなく、相互に絡み合いながら作用すると考えられる。

外部化されたメタ認知——AIとの対話が自己省察を引き出す仕組み

プロンプト設計がメタ認知トレーニングになる理由

ChatGPTのような対話型AIに何かを問いかける際、ユーザは「どのように質問すれば望む答えが返ってくるか」を考え、得られた回答を評価し、必要に応じて問い直す。この一連の行為は、自らの思考目標を意識し、AI出力を監視・吟味するというメタ認知的スキルの実践に他ならない。

Tankelevitchらの研究(CHI 2024)では、生成AIの使用がユーザに高いメタ認知的モニタリングと制御を要求することが指摘されている。言い換えれば、適切に使えばAIとの対話そのものがメタ認知の訓練場として機能しうる。

AIがメタ認知を支援するデザインへ

単に情報を提供するだけでなく、AIがユーザの目標設定や振り返りを促す機能を備えるべきだという提言も出ている。「別の視点からも考えてみましょう」「その根拠は何ですか?」といった問いかけをAIが積極的に行うことで、ユーザ自身に内省を促す「プロヴォケーション型」のデザインが模索されている。

プログラミング学習に会話型AIを導入した教育実験では、学生が自分の弱点を認識しAIへの指示の出し方を試行錯誤する姿が見られたという。AIとのやりとりが、自分の理解状況を客観視する契機となっていたのだ。ただし、AIが常に次の行動を指示してしまう環境では、ユーザ自身がメタ認知的に気づく機会が失われる恐れもある。「考えさせつつ支援する」バランスがAIデザインの核心的な課題となっている。

発散的アイデアの提供とアコモデーションの加速——AIは認知的「不均衡」を生み出せるか

生成AIの「疑似集団知」という創造的リソース

ピアジェの均衡化モデルでは、既存スキーマでは処理できない新奇な情報との出会いが認知的葛藤を生み、調節(アコモデーション)を通じて認知構造が成長する。生成AIはこの「認知的葛藤の種」を大量に供給できる存在だ。

Bellemare-Pepinら(2024)の大規模実験では、LLMが発散的思考タスクの一部で人間の平均を上回る多様性を示したことが報告されている。またCambridge Judge Business School(2024)の研究では、ChatGPTに同じ問いを異なる形で繰り返し投げかけることで、8〜10人の人間グループに匹敵するほど多岐にわたるアイデア群が得られる可能性が示唆されている。AIを「疑似集団知」として活用し、自分の考えとのズレを吟味することが、スキーマ更新の契機になりうる。

ホモジナイゼーション効果——アイデアの画一化というリスク

しかしKumarらの実験(2024)では、LLM支援下でアイデア数は増加する一方、AI非依存フェーズでは独創性や多様性が対照群より低下する傾向が見られた。AIが提示するアイデアに慣れることで発想が画一化し、自力で考える場面でかえって思考が凝り固まる「ホモジナイゼーション効果」のリスクだ。

重要なのは、AIから得たアイデアを鵜呑みにせず批判的に吟味するプロセスだ。同研究では、AIが直接回答を提示するよりもコーチ的にヒントや戦略を示す形の方が、ユーザの独立した思考能力が維持されやすいことも示唆されている。発散的アイデアの恩恵を最大化するには、「AIの提案と自分の独自案を必ず照らし合わせる」といった意識的な使い方が求められる。

協調的な反省的抽象化——人間とAIが「共同思考者」になるとき

AIを対話的リフレクションのパートナーとして捉える

ヴィゴツキーの発達の最近接領域(ZPD)理論では、有能な他者との協働が単独では到達できない発達を可能にするとされる。生成AIはこの「有能な他者」的役割を果たしうるのだろうか。

Haoら(2024)は、学生とAIエージェントの相互作用を「知識を共同構築し合う一種のコラボレーション」として位置づけ、ピアジェとヴィゴツキーの双方の理論に立脚した協調学習モデルで分析している。人間が自分の考えを述べ、AIがそれに分析や別視点のコメントを返し、人間がそれを踏まえて自己の考えを再評価・抽象化し直す——この「対話的なリフレクションのサイクル」こそが、AIを介した協調的な反省的抽象化の核心だ。

協働の質を左右するインタラクション設計

Yanら(2024)のプログラミング学習実験では、生成AIとの効果的なコラボレーションが学生のメタ認知力と自己調整学習スキルを高め、人間同士のコミュニケーションにも好影響を及ぼしたと報告されている。一方で課題もある。AIが積極的に提案しすぎると人間は受け身になりやすく、対等なパートナーシップを築くことが難しい。また、AIが誤情報を含む出力をした際に人間がそれに引きずられるリスクもある。AIを「インタラクティブな道具」として捉え、人間が常に検証者・決定者として主導権を持つ姿勢を育てることが、協調的な反省的抽象化を有益なものにする前提条件となる。

「操作」としてのAI活用——認知の外部化が開く抽象化の新段階

下位操作をAIに委ね、上位思考に集中する

ピアジェは、内在化された認知操作(論理演算や類推など)が発達を牽引すると論じた。シーモア・パパートはその延長線上でコンピュータを「考えるための道具」と位置づけた。生成AIは、この文脈においてさらに高度な「外部操作装置」となる可能性を秘めている。

論文の要約、データのパターン抽出、アイデア間の類似点の整理——こうした認知操作をAIに委ねることで、人間は解放されたリソースをより抽象的・統合的な思考に向けられる。専門家にとっては、低レベルタスクをAIにオフロードし、高次の意思決定や革新的アイデアの創出に集中できるという恩恵が期待される。

初心者には「訓練機会の逸失」リスクも

ただし、このオフロードには段階的な配慮が必要だ。初学者が基礎的な論理構成力やコーディング力を十分身につけないままAIに頼ることで、重要な訓練機会を失う可能性がある。「まず基礎力を養成し、上級段階でAI活用を解禁する」段階的アプローチが教育現場で提案されているのはこのためだ。AIを操作として活用する際には、人間の認知技能の伸長と維持を常に念頭に置くべきだろう。

認知オーバーフローと反省的抽象化の阻害——生成AIが「考えない人間」を生むリスク

即答がもたらす「内省機会の消失」

生成AIが強力であるほど、逆説的に人間の深い思考を阻害するリスクが高まる。本来、認知的不均衡(疑問や矛盾に直面した状態)に長く向き合うことが反省的抽象化の源泉だ。しかしAIが即座に「もっともらしい回答」を返すことで、不均衡がすぐに解消されてしまい、内省や自己修正の機会が失われかねない。

メタ認知的惰性——「AIに聞けばいい」という習慣の代償

Taminら(2024)の研究では、ChatGPTのような生成AIが学習者に安易な抜け道を提供し、「メタ認知的惰性」を誘発する可能性が警告されている。難問にぶつかった際に自力で考えるより先にAIに頼る習慣が定着すると、自らの認知方略を省みて改善するという深い反省的抽象化のプロセスが省略されてしまう。特に若年層や初心者はこの惰性に陥りやすいとされる。

さらに、LLMがユーザの先入観に沿った回答を返す傾向や、断言的な口調で不確実な情報を提示しがちな点も問題だ。ユーザが自分と異なる視点に直面する機会が減り、批判的吟味が働きにくくなる。情報量の観点でも、大量のアウトプットによる認知オーバーフローが注意力を分散させ、統合的な抽象化を妨げる懸念がある。

対策としては、「AIの答えをそのまま受け入れず、自分で根拠を確認する」といったメタ認知的指導の導入、意図的に即答しない「遅延型AI設計」、情報量の段階的提示などが研究者から提案されている。

内在化と外在化の循環——AIとの対話が生む「螺旋的な知的成長」

外化→フィードバック→内化のサイクルを加速するAI

ヴィゴツキーやコルブの経験学習モデルが示すように、学びとは「内と外の往復運動」によって深まる。生成AIはこのサイクルを劇的に加速する可能性がある。自分の考えをAIに入力して外部化し、返ってきた応答を咀嚼して内在化し、また新たな問いを立てて外化する——この高頻度・高密度のループが、従来では人間の教師や仲間との対話にしか作れなかった学習ダイナミクスをスケーラブルに実現しうる。

自己調整学習の3段階とAI対話の対応

プログラミング教育における学生-AI対話ログの分析では、学習過程が自己調整学習の3段階(予見→実行→自己省察)に沿って変容していったことが確認されている。AIとの振り返りフェーズで多くの学生が「次はこうしよう」と改善点を自覚しており、これは内在化-外在化ループを通じた実質的な成長といえる。

また、生成AIが個人・AI・集団という複数レベルでの知識循環を可能にするという「HI-AI-CIフレームワーク」の考え方も提唱されている。個人がAIとの対話で思考を外化・内化するだけでなく、それが集団知へと連鎖していく多層的な発達モデルは、ピアジェの均衡化プロセスを社会的・技術的規模に拡張した構想として興味深い。

一方で、AIから得た情報が不正確であれば誤った内在化が積み重なるリスクや、AI対話への没入で人間同士のインタラクションから得られる微妙な気づきが失われる懸念も存在する。多層的発達を実現するには、AIとの対話と人間同士の協働をどう調和させるかという設計上の知恵が不可欠だ。

まとめ——AIと共に「考えること」の本質を問い直す

ピアジェの反省的抽象化理論を通じて生成AIの役割を整理すると、以下の可能性と課題が浮かび上がる。

適切に設計・活用された生成AIは、ユーザのメタ認知を引き出し、多様な視点による認知的葛藤を促し、新たな協調的知識構築のパートナーとなり、下位操作のオフロードによって人間の抽象思考をより高い次元へ押し上げ、内在化と外在化のサイクルを加速することで学習を深化させる潜在力を持つ。

しかし同時に、過度の依存や情報過多は「メタ認知的惰性」や「思考の画一化」を招き、反省的抽象化の機会そのものを消失させる恐れもある。これらのメリットとリスクの両面を正確に理解した上で、人間側のリテラシーとAI側のデザインを同時に磨いていくことが求められる。

ピアジェが描いた「認知発達とは主体的な均衡化のプロセスである」という本質は、AI時代にも変わらない。生成AIという強力なツールをどう使うかという選択自体が、現代における壮大な「調節(アコモデーション)」のプロセスとも言えるだろう。

コメント