エナクティブ認知論とは何か——”表象”から”行為”への転換

人工知能の設計において、「知能とは何か」という根本的な問いに向き合うとき、エナクティブ認知論(enactive cognition)は一つの重要な視点を提供する。この理論は、認知を「世界の表象を内部に構築して推論する処理」として捉える従来の計算主義的アプローチを批判的に超え、身体と環境の相互作用を通じて意味ある世界を立ち上げる活動として認知を再定義する。

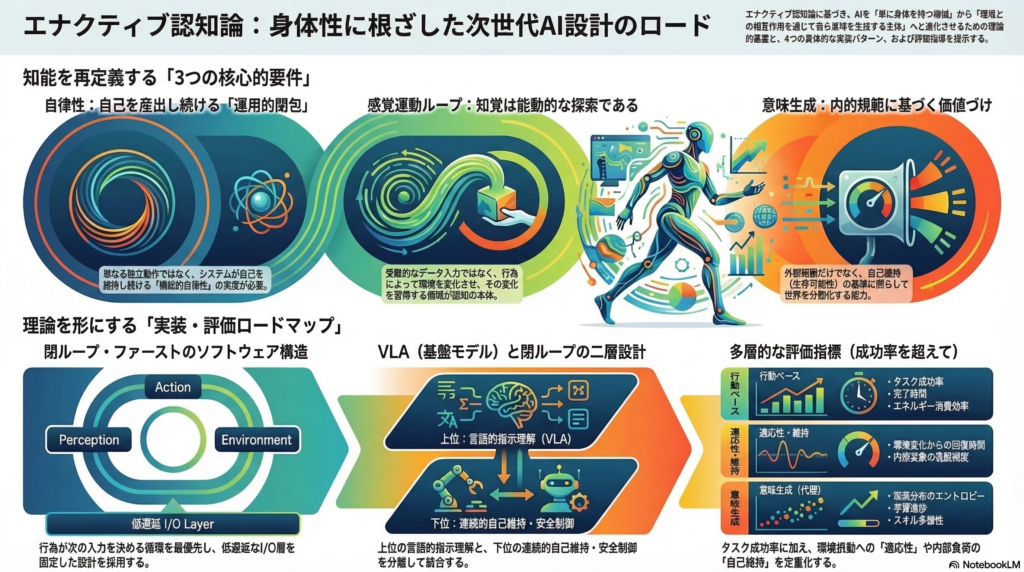

Francisco J. Varela、Evan Thompson、Eleanor RoschによるThe Embodied Mindは、その出発点として広く参照される。同書は現象学と認知科学の対話として、認知を「行為としての知(cognition as enaction)」へと移し替えた。単に身体を持つだけのAIではなく、**自律性(autonomy)・適応性(adaptivity)・意味生成(sense-making)**を備えた系として知的エージェントを設計する——これがエナクティブ派が突きつける設計要件であり、現代のエンボディメントAI研究においても解決が求められる核心的課題となっている。

本記事では、エナクティブ認知論の理論基盤を整理したうえで、形式化手法・実装事例・評価指標・研究ロードマップという4つの軸から、この理論をAI設計に落とし込む方法を掘り下げていく。

エナクティブ認知論の理論基盤——自律性・適応性・意味生成の連鎖

自律性とオートポイエーシス:自己を産出する系

エナクティブ派における「自律性」は、単に外部から独立して動作するという意味ではない。VarelaのPrinciples of Biological Autonomyは、自律性を**自己産出(オートポイエーシス)から導く。Maturana & VarelaのAutopoiesis and Cognitionが体系化したように、生命システムとは「自己産出するネットワーク」であり、その組織が構成要素を相互に条件づけ合う運用的閉包(operational closure)**を持つ。

AIの文脈で重要なのは、この運用的閉包が「外部との構造的カップリング」と矛盾しない点である。系は環境と連結されながらも、内部で自己を産出し続けることによって自律性を維持する。これを設計要件として捉えると、「タスクをこなせる(行動的自律性)」と「自己を維持できる(構成的自律性)」は明確に区別される必要があるという結論が導かれる。

感覚運動ループ:知覚は探索である

エナクティブ認知論においてとりわけ実装に直結するのが、感覚運動ループ(sensorimotor loop)の概念だ。O’Regan & Noëのsensorimotor contingency理論が示すように、知覚は受動的な入力処理ではなく、能動的な探索行為である。知覚するとは、「行為によって環境との関係を変化させ、その変化のパターンを習得すること」に他ならない。

この視点では、センサ→推定→行動→環境変化→再入力というリアルタイムの循環そのものが認知の本体となる。データセットで事前学習するだけでは、この循環を内部化できないという批判はここから来る。

意味生成:価値づけとしての認知

意味生成(sense-making)は、既成の内部表象に意味が付与されるのではなく、主体が自己維持(viability)に関わって世界を分節化し価値づける過程で立ち上がるとされる。Ezequiel Di Paoloはオートポイエーシスだけでは意味生成の説明に不十分であるとして、**適応性(adaptivity)**を導入した。適応性とは、系が自己の生存可能性(viability)に関わる条件を調節する能力であり、これによって規範性(何が”良い”状態かの内的基準)が明示化される。

この理論的区別は実装に直接影響する。タスク成功率という外部基準だけで評価される系は、意味生成の観点からは「価値づけ」を外部に依存していることになる。内部から生じる規範性をどう実装するか——これが設計の核心的課題となる。

身体性に基づく認知モデルの形式化手法

動的システムアプローチ:身体—環境カップリングを連続時間で記述する

Randall D. Beerが概観するように、身体化されたエージェントの行動は連続時間の力学系として解析できる。エナクティブ実装において動的システム論が有力な理由は、身体と環境のカップリングを自然に記述でき、習慣や反射といった安定した行動パターンをアトラクタとしてモデル化できる点にある。Thelen & SmithのA Dynamic Systems Approach to the Development of Cognition and Actionは、発達的知識形成が探索と選択の自己組織化から生じることを示し、行為—知覚の循環から認知が形成される見通しを与えた。

一方で、高次元化による解析困難とパラメータ同定の難しさが限界として挙げられる。実装においては、連続行動の安定生成(リズム、つかみ、反射)の核として動的システムを位置づけ、上位の制御・学習層と組み合わせる設計が現実的だ。

能動的推論(Active Inference):知覚と行為を同一原理で統合する

Karl Fristonが提唱する能動的推論は、自由エネルギー(surpriseの上界)最小化として知覚と行為を同一の原理で扱う枠組みである。4E認知論の「知覚—行為の不可分性」を数理仕様として記述できるため、エナクティブ原理との親和性が高い。ロボット制御へのケーススタディ(視覚・固有受容のノイズ条件下での制御精度検証)も存在し、工学的検証が進んでいる。

ただし生成モデルの設計と推論実装のコストは重く、設計者が事前モデルに規範を埋め込みやすいという落とし穴もある。エナクティブ実装においては、予測と行為の閉ループを明示しつつ、内部変数(精度、欲求)を組み込む役割として活用するのが適切だろう。

内発動機と形態計算:意味生成を駆動する補助機構

Oudeyer & Kaplanが整理するように、内発動機(intrinsic motivation)は新奇性だけでなく「学習進捗(learning progress)」に基づくことで、中程度の難易度へ探索が自己組織化する。これは「意味生成=価値づけ」の工学的代理変数として機能しうる。

Pfeifer & Bongardが提示する形態計算(morphological computation)は、身体形態が計算負荷を外部化するという主張であり、触覚・柔軟構造・受動コンプライアンス設計で「環境との協調」を物理的に実現する手段として参照できる。ただし「何を計算と呼ぶか」の概念整理が必要であり、過大評価には注意が必要だ。

実装事例の比較:エナクティブ原理の観点から

iCubとYARP:身体性研究のための設計哲学

研究用ヒューマノイドiCubは、身体性に基づく認知・発達研究のためのオープンプラットフォームとして設計されている。カメラ、IMU、マイク、力覚センサ、触覚スキンといった多様なモダリティを統合し、ミドルウェアYARP(Yet Another Robot Platform)がモジュール性・再利用性・センサ変動への耐性を担保する。「変動する身体とセンサを前提にしたモジュール設計」という発想は、閉ループを壊さずにコンポーネントを差し替えるというエナクティブ実装の実務要請と整合している。

仮想環境とスケール:Habitat・MuJoCo・Isaac Lab

HabitatはHabitat-SimとHabitat-Lab/APIからなるプラットフォームとして、センサ構成(RGB、Depthなど)とクロスデータセット一般化を実験的に扱える基盤を提供する。MuJoCoはGoogle DeepMindによるオープンソース化で研究基盤としての地位が強まり、Isaac LabはGPU並列・高忠実度シミュレーションで大規模ロボット学習ワークフローを支える。これらは仮想での大規模評価を可能にするが、エナクティブが重視する環境との相互生成の「厚み」(接触、摩耗、身体疲労)は簡略化されやすいという制約もある。

VLA(Vision-Language-Action)系の可能性と限界

RT-1/RT-2、PaLM-E、OpenVLAなどのVLAモデルは、Web規模の視覚・言語知識をロボット制御へ統合し、汎用操作における指示追従と一般化を大きく前進させた。しかし、エナクティブが要求する構成的自律性・意味生成を自動的に満たすわけではない。VLAは上位の意図・指示理解に活用しつつ、下位には閉ループ制御と自己維持機構を別途設ける二層設計が現実的な解として浮かび上がる。

エナクティブ設計の実装パターン

設計パターンとして特に重要なのが以下の4つだ。

①閉ループ・ファースト: センサ入力が行為によって変化し、その変化が次の入力になる循環をソフトウェア構造として固定する。低遅延のI/O層・状態推定層・方策層を分離しつつ、下位ループが常に自走するよう設計する。

②二重の自律性: 「外部タスクをこなせる(行動的自律性)」と「自己を維持できる(構成的自律性)」を分け、内部状態(エネルギー、関節負荷、探索ドライブ、信念精度)を可観測・可制御な変数として定義する。Di Paoloの適応性概念に基づき、viability境界(unsafe/不可逆損傷の領域)をモデル化する。

③予測+探索の二系統(意味生成の代理機構): 予測モデルでセンサモータ随伴を最小化しつつ、学習進捗で探索を駆動する。外的報酬と内部維持(ホームオスタシス)を同一枠で統合することで、意味生成の代理メカニズムとして機能させる。

④VLA+閉ループコア(上位と下位の分業): 上位の基盤モデルはサブゴール列や制約を生成し、下位のMPC/安全制御が連続制御を担う。両者の接続点にaffordanceと不確かさ(uncertainty)の推定を置く。

評価指標と実験プロトコル

多目的評価の必要性

エナクティブ実装をタスク成功率だけで評価することは理論的に不十分だ。評価軸は少なくとも以下の4層で構成される必要がある。

- 行動ベース指標: タスク成功率、完了時間、エネルギー消費、接触失敗率

- 適応性指標: 環境摂動(摩擦・照明・遅延変化)や身体摂動(関節制限・センサオフセット)への回復時間・性能劣化曲線

- 自己維持指標: 内部変数(エネルギー・負荷)の逸脱頻度、回復速度、外的タスクとのトレードオフ

- 意味生成の代理指標: 探索分布のエントロピー、学習進捗の時間推移、empowerment(因果的影響の情報理論的測定)、スキル多様性(獲得レパートリの広がり)

アブレーション実験の設計も重要で、「閉ループ有無」「viability変数有無」「内発動機有無」「基盤モデル有無」という条件を組み合わせることで、エナクティブ原理の各要素が与える影響を切り分けられる。

ダイナミクス解析:習慣をアトラクタとして測る

時系列データを状態空間に埋め込み、再帰性や遷移を解析する再帰定量解析(RQA)は、「習慣=ダイナミクス(アトラクタ)」というエナクティブ的命題を実験的に扱う手段として有効だ。複数モダリティ間の同期を測るクロスRQAへの拡張も可能であり、身体—環境の協調構造を定量化できる可能性がある。

まとめ:エナクティブ原理が問いかけるAI設計の未来

エナクティブ認知論がAI設計に突きつけるのは、「身体を持つだけでは十分ではない」という要求だ。閉ループの実装は必要条件だが、構成的自律性(自己を維持する組織)と適応性(viabilityへの調整)を内側から備えて初めて、エナクティブ派が言う「意味生成する系」が実現する。

現状の技術的景観では、VLA/基盤モデルが「言語的意味」を強化し、MuJoCo・Habitat・Isaac Labが評価の再現性を高めている。しかし、自律性・価値づけ・構成的閉包の実装は自動的には得られない。上位に基盤モデルを置き、下位に閉ループ制御と自己維持を持つ多層設計が、現実的かつ理論的に整合した方向性として浮かび上がる。

研究ロードマップは「閉ループ核の確立→自己維持変数の組み込み→習慣・探索の自己組織化→言語統合→社会的相互作用」という段階を踏むことが合理的であり、短期・中期・長期に分けた循環的な仮想—実機の往復設計が求められる。

コメント