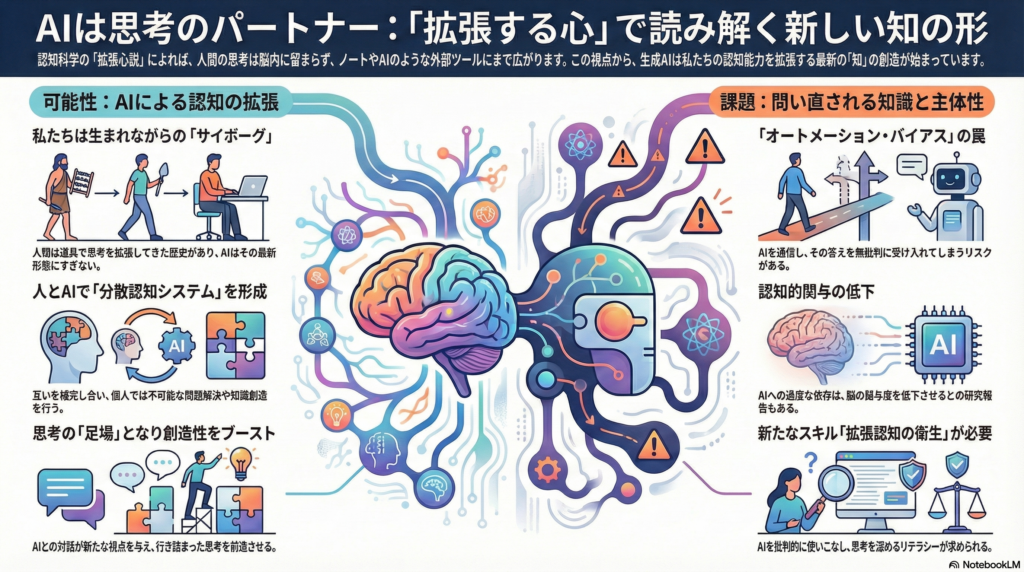

生成AIがもたらす認知革命:なぜ今「拡張心説」なのか

ChatGPTをはじめとする生成AIの登場により、私たちの思考や知識創造のプロセスは劇的な変化を遂げています。「AIに頼ると人間が愚かになるのではないか」という懸念がある一方で、認知科学の視点からは全く異なる解釈が可能です。

認知科学者アンディ・クラークが提唱する「拡張された心(Extended Mind)」理論によれば、人間は太古から道具を使って思考を拡張してきた「生まれながらのサイボーグ(natural-born cyborgs)」です。この視座に立つと、生成AIとの協働は人類史における認知拡張の最新形態として位置づけられます。

本記事では、拡張心説を理論的基盤として、生成AIが人間の認知・知識生成にもたらす変容を多角的に検討します。哲学的枠組み、認識論的考察、実証研究の知見、そして主体性の問題まで、AI時代の知的活動の本質に迫ります。

人間とAIの「共同知」を支える哲学的基盤

拡張された心:脳を超える認知システム

1998年、アンディ・クラークとデイヴィッド・チャーマーズは「拡張された心」仮説を提唱しました。この理論の核心は、人間の心的過程は脳内にとどまらず、ノートやコンピュータといった外的環境にまで拡張しうるという主張です。

クラーク自身、「我々人類は常にハイブリッドな思考システムであり、生物学的脳内に収まらない多様なリソースのモザイクによって定義される『拡張された心』である」と述べています。この視座では、AIもまた人間の認知拡張の一部となり得ます。

実際、人間は基本的に非生物的リソースを取り込んで思考能力を広げてきた歴史があります。文字、印刷術、計算機——これらはすべて認知的道具であり、生成AIはその系譜の最新版に過ぎないとも言えるのです。

分散認知:知識は個人を超えて存在する

拡張認知と関連して重要なのが、エドウィン・ハッチンスによる「分散認知(Distributed Cognition)」理論です。ハッチンスは著書『認知が野に行く』(1995)で、船舶航海の事例を分析し、認知は個人内部だけでなく人々や道具・環境に分散して存在すると論じました。

例えば飛行機の離陸には、多数の乗務員、計器、手順が関与し、一つの複雑なシステム全体で認知的課題を達成しています。ハッチンスは「人間の認知は常に複雑な社会文化的世界に埋め込まれており、それに無関係ではありえない」と述べ、道具や他者との相互作用抜きに純粋な個人の心だけで完結する認知観は誤りだと示唆しています。

この分散認知の枠組みは、人間とAIの関係にも当てはまります。人間とAIは一種の分散した認知システムを形成し、相互補完的に問題解決や知識創出を行う関係にあるのです。

共同知の創発:個人を超えた知的コラボレーション

分散認知論には、複数のエージェントが協働することで個人単独では得られない知識や解決策が生まれることが含意されています。Hutchins & Hazlehurst (1991)の研究は、コミュニティ全体で学習することで個人では不可能な知見を獲得できることを示しました。

今日、生成AIは膨大なデータから集団知を体現した存在と言えます。人間とAIの対話は一種の知的コラボレーションとなっており、AIは人間社会が蓄積した知識を圧縮したモデルとして、人間に新たなアイデアや視点を提供します。他方で、人間はAIにフィードバックや評価を与え、その出力を選別・修正します。

こうして人間-AI間の知識は共同的・相補的に構築され、まさに「共同知」が生まれているのです。拡張心・分散認知・共同知といった哲学的枠組みによって、人間とAIの協働は単なる道具利用ではなく一体化した認知システムとして把握できます。

AI時代の認識論的転換:知識とは何かが問い直される

知識生産プロセスの再編

生成AIとの相互作用は、知識の起源・正当化・構造に関する我々の認識論に挑戦を突きつけています。教育現場では、ChatGPT等の登場により、レポート作成や問題解答がAIで瞬時に行えるようになり、知識を「作る・教わる・確かめる」プロセスそのものが再編されつつあります。

学生が機械生成の解答をそのまま「知識の権威」とみなしてしまうとき、教師と学習者が対話を通じて知を構築してきた従来の役割分担も変質します。AIが**「代理的な知識主体」**として振る舞い、人間側の正当化プロセスを迂回してしまう危険が指摘されているのです。

オートメーション・バイアスの罠

「ChatGPTを『自分より優れた知者』とみなし、疑いもなく中心的情報源として依存する学生が増えている」との報告もあります。その結果、出力内容の偏りや限界への批判的検討が疎かになりがち——いわゆるオートメーション・バイアスの問題です。

哲学者マーク・コーケルバーグは「AIは人間の信念それ自体だけでなく、信念を修正するメカニズム(知識を採用・放棄・変更するプロセス)にまで影響を与えうる」と指摘し、AI時代には我々が何をもって知識とみなすかという基盤が書き換わりつつあると警告しています。

適応的認識論:ハイブリッドな知識創造

従来、知識は人間主体が獲得し蓄えるものでしたが、今や人間とAIのハイブリッドなネットワーク内で創発的・関係的に共創されるものと捉えられ始めています。ある研究では、この新状況に対応する「適応的認識論(adaptive epistemology)」を提唱し、知識を人間と非人間(AI)を含むハイブリッド社会技術アンサンブル内で共創されるものと再定義しています。

この立場では、AIの生成するアウトプットは「完成品の答え」ではなく、人間との対話的・状況的な解釈の出発点とみなし、それを踏まえて新たな知を共に構築することが重視されます。つまり、生成AIの台頭は認識論的なパラダイムシフトであり、知とは「客観的事実の集積」ではなく「ヒトとAIの相互作用から生まれるプロセス」として捉え直す必要があるのです。

人間の主体性を再確立する

こうした新たな知識観は、人間側の主体的なエージェンシー(主体性)を軽視するものではありません。むしろ、多くの論者は人間中心の権威と主体性の再確立を訴えています。

教育分野の議論では、生成AIによって自動化・効率化が進む一方で、人間教師の果たす意味づけや価値判断の役割を再評価し、学習者自身がAIを批判的に活用できるよう指導する必要性が強調されます。生成AIを単なる便利な道具ではなく新たな「知のアクター」と位置づけつつも、その権威を鵜呑みにせず、人間が能動的に吟味・統御する枠組みが求められているのです。

実証研究が示す認知プロセスの変容

自己エスノグラフィー:思考様式の変容

AIとの対話や支援を受けることで、人間の思考過程や問題解決のプロセスが具体的にどう変わるのか——近年、エスノグラフィ(文化記述)を含む様々な手法で実証研究が行われています。

Yulu Hou (2025)の研究では、博士課程の学生として自身がChatGPTを継続的に活用した結果、「生成AIとの持続的な関わりが自らの思考様式をいかに作り変えたか」を詳細に記述しています。ChatGPTを対話相手や思考パートナーとして用いることで、発想の広がりや文章構成の戦略に変化が生じ、自身の「知の捉え方」そのものに変容がもたらされたといいます。

従来は行き詰まっていた問題に対しても、ChatGPTに問いかけることで予想外の視点や補足知識が提示され、それを踏まえて考え直すことで**認知の足場掛け(scaffolding)**が生じたと報告されています。

専門家の現場観察:教師とAIの協働

Chenら (2025)は、英語教師が授業設計に生成AIを統合する様子を参与観察し、教師の専門性がいかに表現・維持されるかを検討しました。熟練教師がレッスンプラン作成にAIを用いる様子を詳細に追跡すると、AIから提案されたアイデアを取捨選択しつつ自らの意図に沿うよう調整していく過程が明らかになりました。

教師はAIをブレインストーミングの相手やリソース検索の代行者として活用しながらも、最終的な指導案の方向性や価値判断は自分自身でコントロールしていました。これは、生成AIが専門家の認知的負荷を軽減し創造的プロセスを補助しつつ、人間の意図に従属する道具として機能し得ることを示しています。

過度な依存のリスク:認知的関与の低下

他方、AIへの過度の依存が認知能力に与える負の影響を指摘する研究もあります。マサチューセッツ工科大学(MIT)のグループによる実験では、文章要約タスクでChatGPTを使用した参加者は、使わなかった場合に比べて脳の認知的な関与度が低く、神経的・言語的・行動的な指標で一貫して劣後したと報告されています。

同様に、アンディ・クラークも指摘するように、人はネット検索など外部情報源を多用すると**「自分は(技術なしでも)良く知っている」と錯覚しがちになることが実験で示されています。これは、容易に答えが得られる環境が知識の錯覚や過剰な自信**を生み、本来なら自力で考えたり記憶したりする努力が削がれる現象です。

もっともクラークは、こうした認知バイアスの副作用は新たな道具利用による小さな代償に過ぎないとも述べています。人類は書記術の発明以来、外部記憶への依存で記憶力が落ちるといった議論を繰り返してきましたが、それを上回る知の拡大を遂げてきた歴史があるからです。

バランスの探求:望ましい認知支援の在り方

現時点での実証研究は、総じて生成AIは人間の認知プロセスを変容させうる強力な拡張器具であることを示しています。適切に用いれば発想支援・学習補助・創造性のブーストといった恩恵が確認されつつあり、一方で注意散漫・思考停止・判断力低下などのリスクも認められます。

重要なのは、AIによる一時的なパフォーマンス向上と人間の認知成長のバランスを測り、AIに頼りすぎず活用しきる認知的リテラシーや教育手法の確立です。長期的に見て人間の認知能力やスキル習得にプラスとなるAIの使い方を見極める必要があります。

主体性と意図の再定義:道具か、パートナーか

道具を超える存在:ポストフェノメノロジーの視点

人間の主体性(エージェンシー)や意図、そして意味づけの構造が生成AIとの共存でどう変わり得るか——これは重要な哲学的論点です。

ポストフェノメノロジー(脱現象学)的技術論によれば、テクノロジーは人間と世界の関係を媒介し変容させるものであり、決して受動的・透明な道具ではありません。ドン・イフデらが論じるように、技術は我々の知覚や行為を仲介して経験の構造そのものを変えるのです。

生成AIも例外ではなく、ChatGPTの提案する文章表現に影響を受けて自分の伝え方が変わったり、レコメンドされる情報によって関心や意思決定が方向付けられることがあります。つまり、**AIは我々の意味形成や意思決定を”共創”するメディエーター(媒介者)**となりうるのです。

意図性の矢印の反転

人間がAIを使うとき、単に人間の内的意図が一方的に投影されるのではなく、AIの出力が逆に人間の解釈や次の意図にフィードバックを与えるという双方向的な構造が現れています。

例えば大規模言語モデル(LLM)は、人間の曖昧な問いを解釈してそれなりの回答を生成しますが、その回答は人間の問いの意図を再解釈・再定義する働きを持ちます。結果として、人間はAIの応答を見て「自分が本当に知りたかったのは何か」「どう質問すべきか」を考え直すこともあり、ここに意図性(intentionality)の矢印の反転が生じているとの指摘もあります。

拡張された主体性:人間中心性を保つために

**主体性(エージェンシー)**に関しては、AIと協働する際に人間の主体性が希薄化する懸念と、新たな形で拡張される可能性の両方が議論されます。

懸念面では、AIが高度化するにつれて人間が判断や意思決定をAI任せにし、自律的に考える主体性を損なうリスクがあります。学生がAIの解答を鵜呑みにすることで「知る主体」としての自律性(epistemic agency)の低下が起きうると示唆されています。

AIを認知的代理人として過剰に信頼すると、もはやそれは単なるツールではなく人間と並立する知的主体となり、道具とエージェントの区別が曖昧になるとも論じられています。このような事態を避けるため、研究者らは**「人間中心のエージェンシー」を再確立するデザインや教育**を模索しています。

具体的には、ユーザがAIからの提案に対してメタ認知的に批判・検証するスキルを身につけることや、システム設計側でAIの推論根拠を説明する透明性を高めることなどが提案されています。

ポジティブな可能性:協調的エージェンシー

一方、ポジティブな観点からは、拡張心的な枠組みにおいて人間の主体性そのものが道具を含めて拡張すると考えられます。クラークの言うように、心や認知のシステムが脳外に広がるなら、道具利用は主体の一部となります。

人間+AIが融合したシステム自体を一つの拡張主体と見ることもできるでしょう。現実の問題解決においては、人間が得意な直観や価値判断と、AIが得意なデータ処理やパターン発見を組み合わせることで、単独では達成できない成果が上がるケースも増えています。

この意味で、主体性は人間個人から人間-技術の協働体へと再定義されうるのです。ただしこの場合でも、人間側の意図や目的が不可欠である点は変わりません。AIには独自の「目的」や「意味理解」はなく、あくまで人間が与えた目標に沿って計算を行います。したがって、最終的な意図の源泉は人間にあり続けます。

まとめ:拡張された認知時代を生きる

アンディ・クラークの拡張心説やハッチンスの分散認知論は、生成AI時代の人間の認知と知識生成を理解する上で強力な理論的道具立てを提供します。これらによれば、人間の思考は頭蓋内に閉じず、外部の技術や他者との相互作用によって歴史的に拡張・分散されてきました。

生成AIとの協働も、この延長線上に位置づけることができ、人間-AIはハイブリッドな認知システムとして共同で知を創出します。しかしその一方で、認識論的には「誰が何を知っているのか」という従来の枠組みが揺らぎ、知識の正当性や権威の在り処について再考が必要になっています。

実証研究からは、生成AIの活用が人間の認知プロセスに変化をもたらすことが確認されており、認知的負荷の軽減や創造的インスピレーションといった恩恵と、思考力低下や無批判な受容といった弊害の両面が明らかになりつつあります。

哲学的考察では、AIが単なるツールを超えて意味形成を媒介する存在となったことで、人間の主体性・意図・意味づけの構造に変容が生じていますが、それは人間の自己拡張として統合し得るものであり、むしろ主体の概念自体を拡大・再定義する契機とも捉えられます。

今後の展望:拡張認知の衛生学

本報告が示すのは、生成AIとの相互作用は人間の「認知する主体」と「知識」の捉え方を根源的に再定義しつつあるということです。今後の課題として、どのような条件下でAIが人間の認知を拡張し、逆にどのような場合に人間の能力を阻害するのかを精査する必要があります。

例えば、創造的思考や批判的思考を損なわずにAIから利点を引き出す対話的インタフェース設計や、人間が主体性を保ちながらAIと協働できる教育・訓練法の確立が重要となるでしょう。

クラークが提唱するように、我々には「拡張された認知の衛生(extended cognitive hygiene)」とも言うべき新たなスキルセット、すなわちAIを批判的に用いて思考を深化させるリテラシーが求められています。幸い、人間は自らの認知環境をデザインし適応する能力を持ちます。

適切な哲学的洞察と実証知見を統合しながら、人間中心かつ協調的なAI利用のガイドラインを策定することで、**生成AIを真に「知を拡張するパートナー」**と位置づけることが可能になるでしょう。それは単に新技術への対応に留まらず、人間の心のあり方を見つめ直す機会ともなります。

拡張された心を持つ私たち人類が、AI時代においてどのように智慧を磨き社会的知を築いていくのか——その挑戦は始まったばかりです。

コメント