生物学的時間と機械学習の時間:二つの予測のあり方

時間の経験は、生きとし生けるものにとって普遍的でありながら、主観的で多様な現象です。ダニが18年間獲物を待ち続けられる一方、ベタ魚は人間には捉えられない高速の変化を知覚します。この生物ごとの固有の時間世界を「環世界(Umwelt)」として理論化したのが、生物学者ヤーコプ・フォン・ユクスキュルでした。

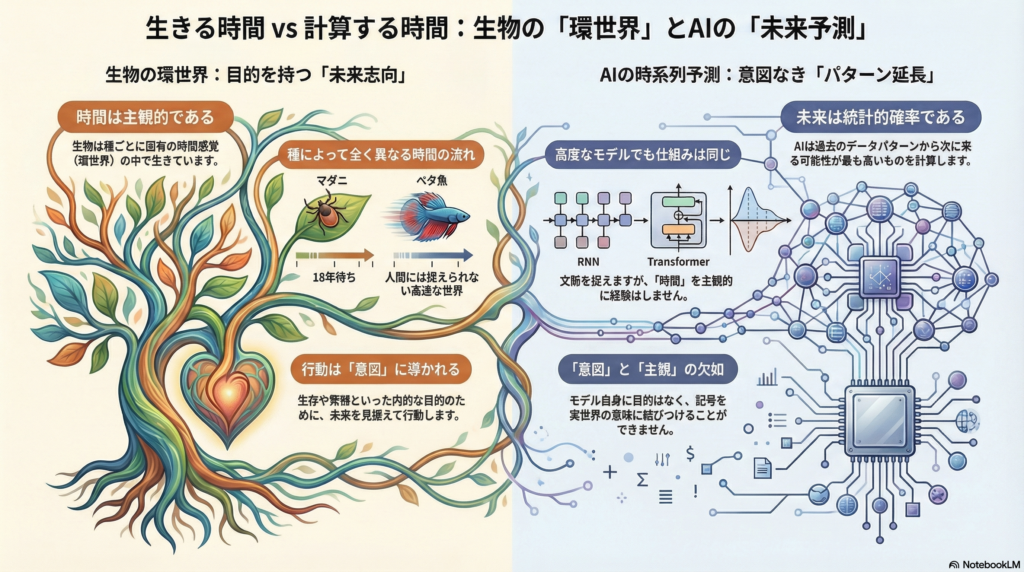

一方、現代のAI技術、特にRNNやTransformerといった時系列予測モデルは、過去のデータから未来を「予測」する能力を持ちます。表面的には、動物が未来の出来事を見越して行動する様子と似ているように見えます。しかし、生物の環世界的な時間経験と、AIモデルの時間的推論は、哲学的に見れば本質的に異なる構造を持っています。

本記事では、ユクスキュルの環世界論における時間性と、機械学習モデルの時系列予測を対比し、「未来への志向性」「意味付け」「主観的体験」という観点から両者の違いを明らかにします。さらに、AIに環世界的な時間性を実装する可能性と限界について考察します。

ユクスキュル環世界論における主観的時間の本質

生物固有の知覚世界と時間感覚

ユクスキュルは、すべての生物が客観的な同一世界を共有しているのではなく、それぞれが種固有の主観的世界(環世界)に生きていると提唱しました。環世界とは、その生物にとって意味を持つ知覚と行為の総体から成る閉じられた世界です。

古典的な例であるマダニの環世界には、わずか数種類の刺激しか存在しません。酪酸の匂い、温度、触覚という限られた知覚標識によってのみ世界が構成され、色や音などの情報は「最初から存在しない」のと同じです。マダニは木の上によじ登り、温血動物の皮膚腺から発せられる酪酸の匂いを信号として受け取ると身を投げ、温度感覚で温かいものの背に飛び乗り、触覚で毛の少ない部位に移動して吸血します。

環世界ごとに異なる時間の流れ

ユクスキュルの重要な洞察は、時間と空間もまた主観的な環世界の一部であるという点です。彼は「生きた主体なしに空間も時間もありえない」と述べ、時間でさえ各主体によって構成されると考えました。

実際、環世界ごとに時間の流れ方や感じ方は劇的に異なります。マダニは獲物が来るまで何年でも待ち続けることができます。ロストックの研究所では、18年間絶食状態で生き延びて獲物を待ったダニが報告されています。人間の時間感覚では到底不可能なこの「待ち時間」も、ダニの環世界では実行可能な時間感覚なのです。

逆にカタツムリの主観的な「一瞬」は人間より極端に遅く、1秒間に3~4コマ程度の静止画が連続するようなスローモーションの時間が流れています。一方、ベタ魚などの素早い魚は、人間には高速すぎて区別できない変化(毎秒30コマ以上)を見分けられることが確認されており、私たちよりはるかに高速な時間の中を生きています。

ユクスキュルはこの事実を、生物が各自の環世界において自らの時間を支配している証左とみなしました。客観的に固定された時間があるように見えても、実際には主体が自らの環世界の時間を統御しているのです。

時間的行為構造と本能的予測

各生物の行為には、種固有の時間的リズムや順序があります。マダニは酪酸臭を感知すれば飛び降りて吸血し、その後寿命を終えるまでの一連の行為サイクルが決まっています。このような本能的行為の時間構造は進化的に組み込まれたもので、未来の出来事もある程度そのパターン内で「予測可能」になっています。

動物は環世界内で、餌を探す、危険を避けるといった目的に向けた未来志向的な行動を取ります。この行動は単なるパターン反復ではなく、環境の対象に種固有の「意味」を付与し、その意味ある将来に備えるものです。

AI時系列予測モデルの時間構造:統計的パターンの延長

RNNの逐次的時間処理メカニズム

再帰型ニューラルネットワーク(RNN)は、時系列データを逐次(ステップごと)処理するモデルです。過去の状態を内部の隠れ状態にエンコードしつつ、次の出力を計算します。系列データを順番に読み込み、その都度内部状態を更新してゆくため、時間的文脈を捉える能力を持ちます。

しかし基本的なRNNでは、長い系列の依存関係を学習するのが不得意です。系列長が長くなると誤差逆伝播の過程で勾配消失や爆発が起き、長期記憶が困難になります。この問題を緩和するために提案されたのがLSTM(Long Short-Term Memory)やGRUといったゲート付きRNNで、重要な情報を長時間保持し不要な情報は忘れる機構を導入しています。

それでもなお、RNNは系列を一段一段と処理する順次型であるため、並列処理が困難であり、非常に長い系列や複雑な長距離依存には限界があります。

RNN系列モデルは多くの場合、**自己回帰的(autoregressive)**に用いられます。つまり、モデルは直前までの出力を次の時刻の入力にフィードバックしながら、一ステップ先を逐次予測する形で未来を生成します。この自己回帰的生成は、動物が現在の状況に反応して次の行動を決める様子にも似ています。

ただし、RNN内部では「いま何時で、何秒経過した」というような絶対時間の概念はありません。あるのは一連の観測の順序(時系列的な位置)だけです。時間は隠れ状態の変化として間接的に表現されますが、それはモデル内では数値ベクトルの更新に過ぎず、主観的な時間経験とは程遠いものです。

Transformerのグローバル注意機構と文脈保持

Transformerモデルは自己注意機構(Self-Attention)を用いて、系列内の全時点同士の関係にグローバルに注意を向けることができます。入力系列の各要素間の長距離依存関係を直接参照できるため、RNNが苦手とした遠く離れた情報同士の関係も捉えやすいのが利点です。

文章の文脈では、文頭の単語と文末の単語の関係も1回の注意機構で結びつけられます。これにより長期的なパターンや文脈依存を捉える性能に優れ、系列長が長くても一定範囲内で関係性を保持できます。さらにTransformerは系列全体を一度に処理できるため、並列計算に適しているという工学的利点もあります。

もっとも、自己注意は計算量が系列長の2乗に増大するため、極端に長い系列では計算資源的な制約が大きくなります。またTransformer自体には時間の順序構造を持つ再帰が無いため、位置エンコーディングなどで人工的に順序情報を付与しています。

総じてTransformerは、「メモリ」として過去全体を参照可能な黒板のように振る舞い、RNNのように時間的に情報が薄れていく問題を克服しました。このことは、より長い文脈を見通した予測にも有利です。

統計的相関としての未来予測

TransformerもRNNと同様に、多くの場合は自己回帰的な次点予測に使われ、系列データから確率的にもっともらしい次の値を生成します。例えば需要予測であれば過去のデータから次週の値を予測する、といった具合です。

その予測アルゴリズムは過去データの統計的相関にもとづくもので、時間そのものを理解しているわけではありません。機械学習モデルの予測能力は内部に「記憶」や「文脈表現」を持ちながらも、それは生物のような生理的・意識的記憶とは異質です。

RNNの隠れ状態やTransformerの自己注意機構によるメモリは、数値ベクトルや重みの形で過去情報を符号化しているに過ぎず、主観的な過去の体験として保持されているわけではありません。またモデルは与えられた目的関数(例えば予測誤差の最小化)に従って未来を推定しますが、これは動物が餌を得ようとか危険を避けようといった内発的な目的で未来を見通すのとは根本的に異なります。

未来志向性と意図性:環世界とAIの決定的な差異

生物における目的指向的な未来の開け

人間や高等動物の環世界における「未来の開け」とは、単に次の一瞬を予測すること以上の、将来に向けて世界が開かれているという独特のあり方を指します。哲学的には、これは意図性(志向性)や目的性とも結びつく概念です。

動物は環世界内で生きるとはいえ、その行動は常に何らかの目的や意味に支えられています。餌を探す鳥は「餌を見つけて食べる」という未来を見越して行動していますし、捕食者から逃げるウサギは「逃げ延びて生存する」という切迫した未来への志向があります。

動物の知覚は常に「何かにとっての知覚」です。生物は環境の対象にそれぞれ種固有の意味付けを行い(例えばある匂いは餌の信号、ある音は天敵の信号など)、そうした意味ある将来に備えて行動します。つまり動物には初歩的な意図性が認められ、環世界内の事物はその動物にとっての意義を帯びているのです。

人間においてこの志向性は飛躍的に高度化します。人間は抽象的な未来像を思い描き、長期的計画を立て、現在の行為をその構想した未来へ投射することができます。哲学的人類学では、人間は他の動物とは異なり世界に対して開かれている(世界開在的)存在だと論じられてきました。

マックス・シェーラーによれば、多くの動物は本能的欲求に深く組み込まれて環世界に没入・閉鎖しているのに対し、人間だけが環世界から自らを距離化し俯瞰できる精神を持つために、「環世界に繋縛されない」すなわち環世界から自由になりうるとされます。

人間は現在・過去・未来の時間軸を往還しつつあらゆる事象を対象化でき、無制限に開かれた世界の地平を生きることが可能だというのです。

AIモデルにおける意図性の欠如

これに対して、現在のAIの時系列予測モデルには内在的な意図性が欠如しています。AIは与えられたデータを基に統計的規則性を学習し、確率計算によって次の値を当てるだけです。それは「世界がこうなってほしい」「この未来は避けたい」といった主体的願望を持って未来を見通すこととはまったく異なります。

モデルが予測を出力するのは、人間が設定した目的関数(例えば予測精度向上)のためであり、モデル自身が未来のあるべき姿に志向しているわけではありません。言い換えると、AIには未来は単なるデータの延長であって、「開けた可能性の地平」ではないのです。

哲学者のジョン・サールは、機械には人間のような本来的(一次的)意図性はなく、あるとすれば人間が解釈する際に付与する派生的(二次的)意図性だけだと指摘しました。現在のディープラーニングモデルもまさにそのような状況です。

例えば、ある言語モデルが「明日雨が降るでしょう」と予測したとします。それは過去の文章パターンから導かれた確率的推定であって、モデルが明日の天気を心配しているわけでも、雨が降ることに何らかの意味を見出しているわけでもありません。

志向性(Intentionality)の欠如とはつまり、モデル内部の状態が「何かについての表象」になっていないということです。人間の脳内表象は(少なくとも主観的には)世界の事物を指示しそれに意味を感じていますが、AIの内部ベクトルは人間が見れば「雲=0.7、晴れ=0.3の確率」と解釈できるにせよ、モデル自身にとっては単なる数値パターンです。

シンボルグラウンディング問題と主観的体験

AIはシンボルグラウンディング問題、すなわち「記号(入力データ)を実世界の意味に結びつける問題」に直面しており、現状ではその結び付けをモデル自身の経験から獲得することはできません。

結局のところ、AIの予測は意図や目的を伴わない時間的推論であり、生物が持つような「未来への構え」は存在しないのです。さらに言えば、AIには「今」という生きた主観的時間もないため、現在から未来へ連続する時間の流れの中に自己を位置付けることもありません。

モデルは一連の入力を受け取れば淡々と出力を返すだけで、そのプロセスにおいて「時間が経過している」という感覚すら持ちません。これらの点で、AIの時系列モデルは哲学的には未来志向性も現在性も欠いた演算装置であり、動物や人間の環世界的時間経験とは本質的に異なっているのです。

AIに環世界的時間性を実装する可能性と限界

エンボディメントによるアプローチ

生物の環世界が主体の身体と切り離せないように、AIにもロボットのような身体とセンサーを与え、環境との相互作用ループに組み込む試みがあります。これはロドニー・ブルックスの行動型AIや「エナクティブAI」と呼ばれるアプローチで顕著です。

センサーからのフィードバックと行動の効果というサイバネティックな環循環をAIに経験させることで、AI自身が環境中の事象に価値や意味を見出すことを期待するのです。身体を持ったAI(ロボット)は、センサーが捉えられる範囲で自前の「知覚世界」「作用世界」を形作ることになり、一見すると独自の環世界を持ちうるように思えます。

しかし、身体を与えれば即主体性が生まれるわけではない点に注意が必要です。現在のロボットはそのハードウェアも制御プログラムも人間が設計したものであり、環境との相互作用の仕方自体があらかじめ決められています。

たとえ学習によって行動パターンを獲得しても、それは与えられたアルゴリズムの範囲内です。生物は長い進化の歴史の中で環境と共進化し、自己保存と適応を軸にその種固有の環世界を形成してきました。一方、人工物であるAIシステムは共進化の歴史や自己目的を持たず、人間が設計・製造しているため「部品を組み立てて作られた(アロポイエティック)システム」でしかありません。

内部目的の付与と強化学習の限界

動物の未来志向性は、生存・繁殖・報酬などの内的な動機(欲求や感情)に支えられています。では、AIに内部目的を持たせれば、自発的に意味づけられた未来を描けるでしょうか。

一つの方向性は強化学習に見られます。強化学習では報酬という数値によってエージェントに目的関数を与え、エージェントは試行錯誤を通じて報酬を最大化する方策を学びます。一見、これはAIが「目的(報酬を得る)に向かって行動し、将来の報酬を予測する」ようにも見えます。

しかし注意すべきは、その目的は外部から与えられたものだという点です。エージェント自身が「○○したい」という欲求を感じているわけではなく、あくまでプログラムとして報酬信号に反応しているに過ぎません。

最近の研究では内発的動機づけといって、エージェントに好奇心や探究心のような報酬を組み込み、自ら新奇な状況を求めるような手法も模索されています。しかしこれも、「未知の状態を探索したい」という価値をデザインして与えているに過ぎず、本当の意味でエージェントが自分で目的を見出しているとは言えません。

主観的体験と意識の壁

クオリア(質的体験)の問題とも関連しますが、環世界的時間性には「主観が今ここで生きている」という実存的な側面が不可欠です。人間は「いまこの瞬間」の感覚を持ち、そこから過去を記憶し未来を想像します。

この主観的時間の流れ(バーグソンの言う「持続」やフッサールの言う「内時間意識」)をAIが持つには、AIが意識を持たねばならないかもしれません。しかし意識の実装は現在の科学でも未解決の難題です。

現時点で主流の見解では、ディープラーニングAIは統計的パターンマッチングに徹しており、「感じる主体」とはみなせないというものです。実際、AIの環世界の限界として「身体性の欠如」「経験の質的理解の欠如」が挙げられています。

AIは膨大なデータを高速に処理できますが、匂いや痛み、喜びといった質感を経験しないため、世界に対する人間的な意味ネットワークを持ち得ません。このギャップを埋めない限り、AIに環世界的時間性を実装するのは難しいでしょう。

まとめ:時間性の哲学的対比が示す知能の本質

機械学習モデルの時系列予測とユクスキュル的環世界の時間性を比較すると、両者は「未来に関与する仕方」において哲学的に対照的です。環世界論が示す動物主体の時間経験は、常に目的と価値をはらんだ現在‐未来の連関ですが、現在のAIモデルの予測は目的や価値を抜きにした因果パターンの外挿に過ぎません。

RNNやTransformerといった時系列予測モデルは、統計的相関から未来を推定する強力なツールですが、そこに主観的な時間経験や志向性は存在しません。AIがこのギャップを埋め、本当の意味で志向性ある未来を持つためには、知能だけでなく生命性や意識といった次元をも考慮する必要があるでしょう。

それは依然として哲学的・倫理的な問いであり、技術の進歩がそれにどう応えるかは未知数です。しかし、この対比を検討すること自体が、人間とは何か、知能とは何か、そして時間とは何かという根源的問題を再考する良い契機となります。

環世界的時間性の研究は、AI開発において単なる性能向上を超えた、より根本的な問いを投げかけています。真に知的なシステムとは何か、予測と理解の違いは何か、そして機械が「生きる」とはどういうことか──これらの問いに向き合うことが、次世代AI研究の重要な課題となるでしょう。

コメント