なぜ今、ピアジェ理論でAIを語るのか

大規模言語モデル(LLM)や画像生成AIが急速に普及するなかで、「AIは人間の思考をどう変えるのか」という問いがますます切実になっている。検索エンジンの登場がすでに記憶のあり方を変えたように、生成AIとの日常的な対話は、人間の認知プロセス自体に新たな影響を与え始めている。

こうした変化を理解するための理論的枠組みとして、スイスの発達心理学者ジャン・ピアジェが提唱した**反省的抽象化(reflective abstraction)**は依然として有効な視点を提供する。ピアジェの理論は「子どもがいかに考える力を獲得するか」を問うものだったが、その本質——自分の認知操作を意識化し、より高次の構造へ再編成するプロセス——は、人間とAIが協働する現代においても鋭い示唆をもたらす。

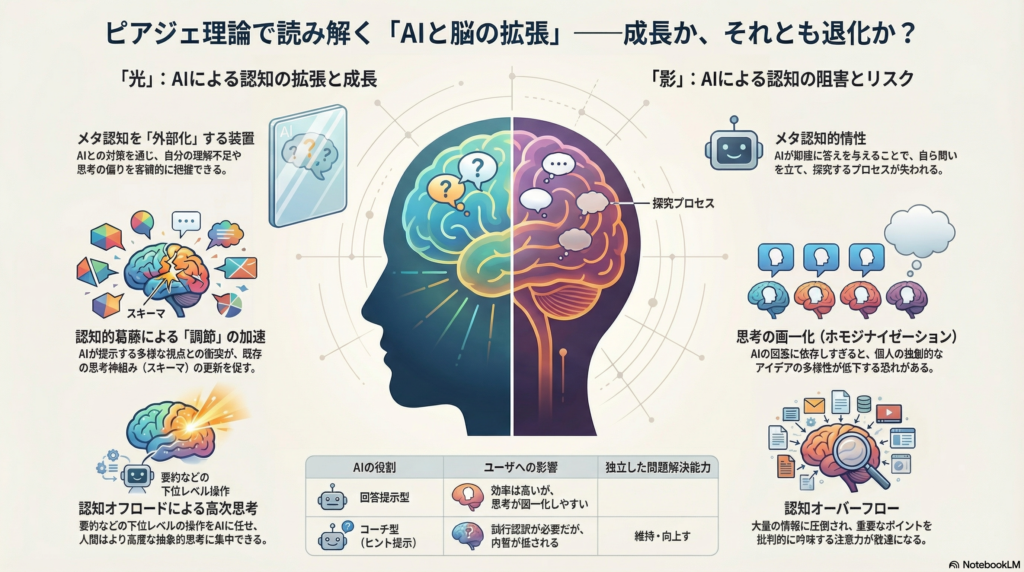

本稿では、ピアジェの同化・調節・均衡化・反省的抽象化の概念を軸に、生成AIが人間の「脳の拡張要素」として機能する可能性と、その光と影を6つの仮説から考察する。

ピアジェの反省的抽象化とは何か——理論の基礎を押さえる

同化・調節・均衡化の三角形

ピアジェは、認知発達を**同化(assimilation)と調節(accommodation)**の相互作用によって説明した。同化とは、新しい情報を既存の認知スキーマに取り込む過程であり、調節とは、既存スキーマでは処理できない情報に直面したときにスキーマ自体を変化させる過程だ。この二つの力のバランスが崩れた「認知的不均衡」を解消しようとする動きが、**均衡化(equilibration)**として学習・発達の原動力となる。

つまり学習とは、単なる情報の蓄積ではなく、認知構造の能動的な再編成なのである。

反省的抽象化——自分の思考を「考える」能力

反省的抽象化とは、自身の行為や認知操作を振り返り、それをより高次の論理的構造へと昇華させるプロセスだ。例えば「足し算ができる」という具体的操作を、「演算一般のルール」として抽象化するような働きがこれにあたる。

重要なのは、このプロセスが外部から与えられるものではなく、主体の内部から湧き出す自己調整的な認知活動である点だ。そしてまさにこの点において、生成AIとの関係性が問われることになる——AIは反省的抽象化を促すのか、それとも阻害するのか。

生成AIがメタ認知を「外部化」する可能性

AIとの対話が引き出す自己省察

メタ認知とは、自分の認知過程を監視・制御する能力であり、ピアジェの反省的抽象化とも深く関連する。生成AIとの対話は、このメタ認知を外部化する装置として機能しうる。

ChatGPTのようなAIに問いを投げかける行為は、単に「検索する」ことと本質的に異なる。望ましい応答を得るためには、自分が何を理解していて何がわからないのかを言語化し、AIの出力を批判的に評価し、必要に応じて質問を修正する、という一連のプロセスが必要となる。この過程がユーザにメタ認知的スキル——計画立案・自己評価・自己管理——を要求することは、CHI 2024で発表されたTankelevitchらの研究が指摘している通りだ。

プログラミング学習に会話型AIを導入した教育研究では、学生が「与えられた情報の正確さを自分で判断できるか不安だ」と自覚し、AIへの指示の仕方を試行錯誤する姿勢が観察されている。このように、AIとの対話そのものが学習者に自己を振り返らせる契機となる。

AIデザインがメタ認知を支援する方向性

一方で、AIが次の行動をすべて指示してしまう環境では、ユーザ自身が状況を評価する機会が減少するリスクもある。これを防ぐため、AIがあえて直接答えを与えず「本当にそれで正しいと言える根拠は何ですか?」といった問いかけを返す**”プロヴォケーション型”デザイン**の研究も進んでいる。ユーザに十分考えさせつつ適切に支援するAIのあり方は、今後の重要な設計課題だ。

発散的アイデアの提供がアコモデーションを加速する

生成AIは「認知的葛藤」の触媒になれるか

ピアジェの枠組みでは、既存スキーマと矛盾する情報との出会いが認知的不均衡を生み、調節を促す。生成AIは膨大な知識と多様な視点をもとに、人間一人では想像しにくい解決策やアイデアを瞬時に提示できる。この特性は、ブレインストーミングのパートナーとして機能しうる。

Bellemare-Pepinら(2024)の大規模実験では、LLMが発散的思考の一部タスクで人間を上回る多様性を示したことが報告されている。また別の研究では、ChatGPTに同じ問いを10回異なる形で質問すると、8〜10人の人間グループに匹敵するアイデアの広がりが得られたという。AIが「疑似集団知」として機能する可能性が見えてくる。

「思考の画一化」というリスク

しかしトロント大学のKumarらによる2024年の実験は、別の側面を照らし出している。LLMから解答例を得ながら発散課題に取り組んだ参加者は、当座はアイデア数が増えた一方、後のAI非依存フェーズでは独創的なアイデアの多様性が対照群より低下する傾向が見られた。研究者らはこれを**「ホモジナイゼーション効果(思考の画一化)」**と呼ぶ。

興味深いのは、AIが直接回答を提示する形よりもコーチのようにヒントや戦略を示す形で支援した場合の方が、ユーザが独立した問題解決能力を維持できる可能性が示唆されたことだ。AIの発散的アイデアを最大限に活かすには、ユーザ主体の内省との組み合わせが不可欠と言える。

人間とAIの「協調的な反省的抽象化」は成立するか

AIを学習パートナーとして捉える視点

ピアジェ理論は主に個人内の発達を対象としたが、ヴィゴツキーの**発達の最近接領域(ZPD)**理論は、他者との協働を通じた内在化の重要性を示した。現代の研究者たちは、生成AIとの対話をこの協調学習の一形態として捉え始めている。

Haoら(2024)は、学生とAIエージェントのインタラクションを「知識を共同構築し合い、フィードバックによって理解を調整する一種のコラボレーション」と位置づけた。人間がある問題について考えを述べ→AIが分析や別視点を返し→人間がそれを踏まえて再評価する、という対話的リフレクションのサイクルは、AIを「鏡」や「批評家」として機能させる。

協調学習の実証と課題

Yanら(2024)のプログラミング学習研究では、学生-生成AI間の効果的なコラボレーションが学生のメタ認知力や自己調整学習スキルを高め、人間同士のコミュニケーションにも好影響を与えたと報告されている。AIと上手に協働できた学生ほど、クラスメートとの議論にも積極的になったというのは示唆深い。

ただし課題もある。AIが積極的に提案しすぎると人間は受け身になり、逆に人間ばかりが説明する非対称な構図になりがちだ。AIを「インタラクティブな道具」として位置づけつつ、人間が常に検証者・決定者として主導権を持つ姿勢の教育が求められる。

AIを「認知操作」として活用することで抽象化が新段階に入る

認知オフロードが高次思考を可能にする

ピアジェが言う「操作(operation)」は本来、人間の脳内で行われる論理演算や類推だ。しかし生成AIは、文章要約・パターン発見・概念整理といった多様な認知操作を代行できる。

科学研究において膨大な論文をレビューし理論的枠組みを抽出する作業を例に取ると、LLMを用いれば主要ポイントの整理を短時間で行える。その結果、研究者は得られた要約をもとにより高次のメタ理論を構築したり新規仮説を立てたりする創造的思考にリソースを割ける。人間が下位レベルの操作をAIに委ね、上位レベルの抽象化に集中するこの図式は、生成AIを「認知の拡張ワークスペース」として捉える視点を与えてくれる。

ChainofThoughtが人間の思考様式を変える可能性

ChainofThoughtやTreeofSoughtといったLLMの推論手法では、モデルが中間推論ステップを明示的に列挙する。このAIの推論過程を観察・追随することで、人間の問題解決手順にも変化が生じる可能性が指摘されている。通常は暗黙の心的表象として進む思考が、AIとともに「半外在化」されることで再帰的に検討できるようになる——この新たな思考ループが、反省的抽象化の新段階を開く鍵になるかもしれない。

ただし、基礎訓練の機会を失う初心者へのリスクには注意が必要だ。初期段階ではAI支援を限定して基礎力を養成し、上級段階でAI活用を解禁するという段階的アプローチが教育現場では推奨されている。

「認知オーバーフロー」——生成AIが反省的抽象化を阻害するリスク

即座の回答が「考える機会」を奪う

生成AIの最大の強みである「即答性」は、同時に最大のリスクにもなりうる。ピアジェ流に言えば、本来は認知的不均衡を感じて考え込むべき場面で、AIが一見もっともらしい回答を与えて不均衡をすぐ解消してしまうため、内省や自己修正の機会が失われるという事態が起きる。

「なぜ空は青いのか」と疑問に思った子どもがAIアシスタントに即座に答えを得たとき、知識は手に入っても探究のプロセスは経験していない。これは反省的抽象化の観点では、単なる同化にとどまり真の調節が起きていない状態だ。

メタ認知的惰性と情報過負荷の二重リスク

さらに深刻なのが**「メタ認知的惰性」**の問題だ。難しい問題に直面するたびに「AIに聞けばいいや」となれば、自らの認知方略を省みて改善するという深い反省的プロセスが省略されてしまう。British Journal of Educational Technologyに掲載されたTamimらの研究は、ChatGPTのような生成AIが学習者のメタ認知的惰性を誘発する可能性を警告している。特に若年層や初心者ほどメタ認知戦略が未熟なため、このリスクは高まると考えられている。

加えて、LLMによる大量のアウトプットは**認知オーバーフロー(認知過負荷)**を招き、重要な点に注意を向けて吟味する力を弱める可能性がある。さらにLLMはユーザの先入観に沿った答えを返す傾向(肯定バイアス)や、自信ありげな口調で不確かな情報を断言するスタイルが、批判的吟味を妨げるリスクも指摘されている。

これらへの対策として、AIがあえてヒントを小出しにする設計、学習者が自問自答で結果を検証するトレーニング、情報量を自分でコントロールできるインタフェースの整備などが提案されている。

内在化と外在化の循環が多層的発達をもたらす

生成AIが加速する「知の螺旋」

内在化(取り込み)と外在化(表出)の往復運動は、深い学習の根幹をなす。ヴィゴツキーが言語という道具を通じた内在化を重視したように、生成AIは現代の「外在化の媒体」として機能しうる。

ユーザはAIに自身のアイデアや問いを入力することで思考を外部化し、AIからの応答を読んで理解・咀嚼することで知識を再び内在化できる。人間の断片的な考えを対話という形で具現化し、それを見てまた考えを更新するループが、従来よりもはるかに高頻度で回せるのだ。AIは口頭試問の試験官やゼミ仲間の代わりを務め、学習者の思考を何度でも引き出しては返す役割を果たしうる。

自己調整学習の三段階との接続

プログラミング教育の実証研究では、学生の学習過程が自己調整学習理論の三段階——予見(計画立案)→実行(試行錯誤)→自己省察(振り返り)——に対応して変容することが確認されている。特に自己省察フェーズでは、AIとの振り返りを通じて「次はもっとこうしよう」という具体的な改善点が自覚される例が多く見られた。これはまさに内在化-外在化ループを通じた認知的成長の姿だ。

Guy Leviらの論考が提示する**人間知能・AI・集団知能の相互作用フレームワーク(HI-AI-CI)**は、この循環をさらに拡張する。個人の認知、社会的学習、文化的文脈が連関しあう新たな学習モデルにおいて、生成AIは個人とコミュニティをつなぐ結節点として機能しうる。

まとめ——AI時代のピアジェ的知性をいかに育むか

本稿で検討した6つの仮説を整理すると、生成AIは適切に用いれば次の可能性を持つことがわかる。

ユーザのメタ認知を引き出し自己省察を促す(仮説1)、多様なアイデア提示で認知的葛藤と調節を加速する(仮説2)、対話的パートナーとして協調的な知識構築を支える(仮説3)、下位操作をオフロードすることで高次の抽象思考を可能にする(仮説4)、内在化-外在化サイクルを加速して多層的発達をもたらす(仮説6)——これらはいずれも実証が始まった段階であり、楽観的な断言は禁物だが、方向性は示されつつある。

一方で、AIへの過度の依存や情報過多は認知的怠惰や深い思考の阻害を招く(仮説5)という負の側面も無視できない。

ピアジェが強調した「主体的で能動的な学び」は、デジタル時代においても本質を変えない。AIという新たな道具を統合しながら人間の自律的な知的成長を守ること——それ自体が現代における壮大な「調節」のプロセスと言えるかもしれない。AIとの賢い共存のあり方を問い続けることが、反省的抽象化の精神そのものでもある。

コメント