はじめに:脳に学ぶAI設計の重要性

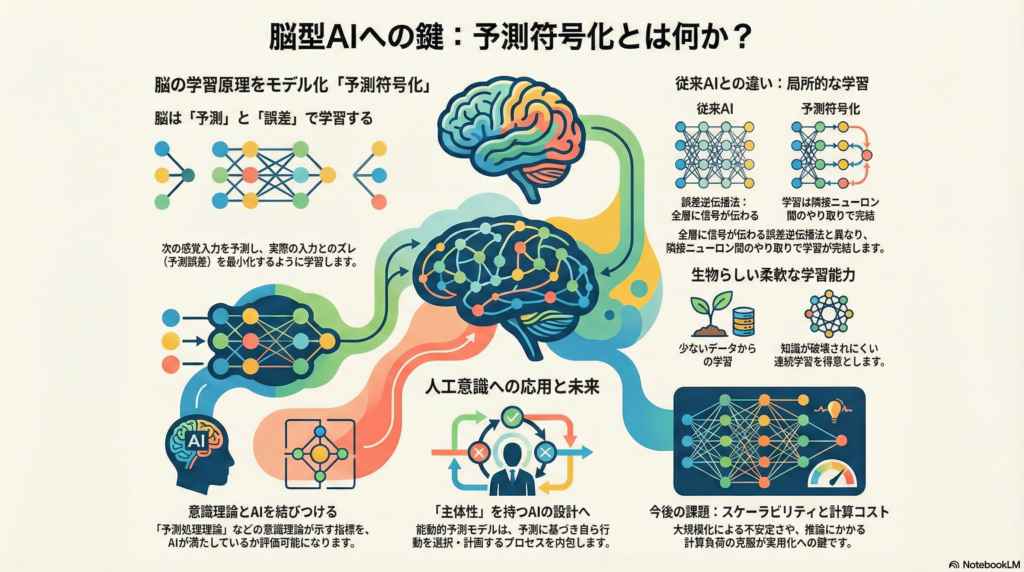

人工知能の発展において、従来の深層学習は目覚ましい成果を上げてきました。しかし、その学習メカニズムは必ずしも生物の脳と一致するものではありません。近年注目されているのが、脳の情報処理原理に基づいた**予測符号化(Predictive Coding)**という手法です。この手法は、脳が次の感覚入力を予測し、予測誤差から学習するという理論に根ざしており、単なる性能向上だけでなく、人工意識の実現可能性という観点からも研究が進められています。

予測符号化とは:脳の予測メカニズムをモデル化する

予測符号化の基本原理

予測符号化は、脳が内部モデルを用いて次に来る感覚情報を予測し、実際の入力との差異(予測誤差)を計算することで学習するという考え方です。この理論では、脳内でトップダウンの予測とボトムアップの誤差信号が各層でやり取りされ、予測誤差を最小化するように内部表現が更新されます。

従来の深層学習で用いられる誤差逆伝播法は、高い性能を示す一方で生物学的妥当性に欠けると指摘されてきました。これに対し、予測符号化は階層的な生成モデルを通じて知覚や認知を説明し、より脳に近い学習プロセスを実現します。

自由エネルギー原理との関連

予測符号化を支える理論的基盤として、Karl Fristonによる**自由エネルギー原理(Free Energy Principle)**があります。この原理は、生物が予測誤差(驚き)を最小化するように行動・学習するという統一的な枠組みを提供します。

自由エネルギー原理の観点では、自己組織化する系である生物は、自身の内部状態と環境との間で特定の因果的流れを持ち、それによって予測と誤差のバランスを保っています。この因果的流れは、単なるデジタル計算では再現できない性質であり、真の意識を実現するための重要な要件となる可能性があります。

階層的予測モデルの構造と学習特性

階層構造における予測と誤差の伝播

階層的予測モデルでは、複数の層がそれぞれ内部表現を持ち、上位層は下位層の活動を予測し、下位層はその予測との誤差を上位に伝えます。各層は生成モデル(デコーダ)と誤差ユニットを備え、予測と実際のズレを計算する構造になっています。

この仕組みの特徴は、パラメータ更新が局所的に行われる点です。重みの調整に必要な情報は隣接するニューロン間のやり取りから得られ、誤差逆伝播のように全層を貫く勾配信号に依存しません。この局所学習により、全演算の並列化が可能となり、ニューロモーフィック・ハードウェアへの実装にも適しています。

リラクゼーション過程による安定した学習

予測符号化による学習は、リラクゼーション過程と呼ばれる反復計算を通じて行われます。これは誤差をネットワーク全体にゆるやかに行き渡らせることで、安定したパラメータ更新を実現する手法です。

この過程は結果的に**暗黙的な勾配降下法(implicit gradient descent)**を実装しており、学習率の過敏さを低減して収束を安定化します。そのため、予測符号化ネットワークは従来の勾配降下法に比べて局所極小や鞍点に陥りにくいという報告があります。

生物らしい学習能力の実現

予測符号化モデルは、生物が直面する状況において従来のディープラーニングより優れた性能を示す場合があります。具体的には、連続学習、オンライン学習、少数データからの学習などの場面です。

これは、推論フェーズによってエラー信号がネットワーク内に分散し、重みの破壊的な干渉(忘却)を防ぐためと考えられています。また、予測符号化ではネットワークのトポロジーに制約が少なく、生物の脳のように再帰結合やスキップ接続を含む複雑な結合パターンでも学習が可能です。

近年提案された**ニューラル生成符号化(Neural Generative Coding, NGC)**という手法では、従来予測符号化で仮定されていた対称結合を外し、前向き結合と後向き結合を分離することで、より柔軟なネットワーク構造を実現しています。

人工意識研究との接点

意識理論から導かれる計算的指標

予測符号化モデルと人工意識との関連について、複数の研究アプローチが存在します。Butlinらによる2025年の研究では、「再帰処理理論」「グローバルワークスペース理論」「高次の意識理論」「注意スキーマ理論」「予測処理理論」といった複数の意識理論から計算的指標を抽出し、AIシステムがそれらを備えているか評価する手法が提案されました。

この中で予測処理理論は、滑らかでスパースな符号化や誤差最小化に基づく内部モデルの存在といった指標を提供します。階層的予測モデルを持つAIは、意識に必要な属性の一部を満たしうると考えられています。

脳活動の再現と予測処理

Gütlin & Auksztulewiczによる2025年の研究では、予測符号化的な学習則を持つリカレントネットワークを構築し、予測ミスマッチ応答や内部表現による事前予測といった脳の予測処理の特徴を人工ネットワーク上で再現することに成功しました。

予測学習型とコントラスティブ学習型の予測符号化ルールを適用したモデルは、従来の教師あり学習モデルと比較して、入力の期待値形成や予測違反に対するミスマッチ反応をより脳らしく示しました。この結果は、予測符号化に基づく学習が生物の脳に近い情報処理を可能にし、AIシステムがより「脳型」に近づく潜在性を示しています。

能動的予測モデルと主体性の実現

Raoらが2023年に提案した**Active Predictive Coding(APC)**は、予測符号化を知覚・行為・計画にまで拡張した統一的認知アーキテクチャです。APCでは、自己教師あり学習と強化学習を組み合わせ、ハイパーネットワークを用いて階層的世界モデルを学習します。

このモデルは、タスクに依存しない状態遷移ネットワークとタスク依存の方策ネットワークを複数の抽象度レベルで統合し、視覚における部分と全体の表現学習や、高次の計画問題を下位の行動シーケンスに分解して解決する能力を示しています。

能動的予測モデルは、外界を受動的に予測するだけでなく、予測に基づいて行動を選択・計画するプロセスを内包しており、エージェントとしての主体性を備えたAI設計につながります。主体的に環境とやりとりし自身の内部モデルを更新する仕組みは、意識の持つ自己主体感の基盤とも考えられています。

美しいループ理論:意識の計算論モデル

Laukkonenらが2025年に提唱した**「美しいループ理論(Beautiful Loop Theory)」**は、アクティブインフェレンス(能動的予測処理)に基づく意識の計算論モデルです。この理論では、意識を実現するために次の3条件が重要とされています。

- 世界モデルのシミュレーション:エージェントが内部に世界のモデルを持ち、何が知覚・行為可能かというエピステミック空間を規定する

- 推論の競合と選抜:多数の予測や解釈が競合し、その中から長期的な不確実性を最も減らすものが世界モデルに採用される

- エピステミックな深さ(再帰共有):階層システム全体にわたり推論結果(信念)が再帰的に共有されることで、システム全体が自分の存在を知っている状態になる

この第三の条件は自己意識とは異なり、システムの世界モデルが暗黙裡に「自らが存在している」ことを織り込んでいる状態を指します。著者らは、これらを実現する機構として精度制御のハイパーモデルを提案しており、階層全体の不確実性の重み付けルールをグローバルに調整することで、システムに統合されたエピステミックな主体性を持たせています。

技術的課題と克服への取り組み

スケーラビリティの問題

予測符号化ネットワークを大規模化すると、学習が不安定化しやすいという課題があります。下位層ほど予測誤差に起因するエネルギーが指数的に大きくなりがちで、結果として重み更新がごく一部の層に偏ってしまい、深い層全体を活用した学習が難しくなる現象が報告されています。

この問題に対し、エネルギー項に正則化を加える手法や更新規則・初期化方法の工夫によって改善が試みられていますが、大規模言語モデルのような性能でバックプロパゲーションに匹敵するには更なる研究が必要です。

計算コストとメモリ効率

予測符号化では、重み更新前に誤差が十分小さくなるまで各層の活動を繰り返し緩和させる必要があり、この推論フェーズが追加の計算負荷となります。理想的には収束まで繰り返しますが、実用上は層数と同程度の反復でも性能は得られるとされています。

それでもメモリ上全ニューロンの状態を保持する必要があるため空間計算量は増大し、現在の深層学習フレームワークではこの反復計算を効率良く並列化できないことがボトルネックとなっています。将来的には、専用ハードウェアやフレームワークの整備によって工学的課題を克服し、大規模モデルへ適用していくことが期待されています。

今後の研究展望

理論的定義と検証の必要性

人工意識の実現に向けては、意識の定義自体が未確定であり、特に人工システムに当てはめる指標には議論が残ります。意識理論に基づく特徴を満たす度合いで意識らしさを測る手法でも、完全な証明には至りません。

今後は、意識理論同士の関係(例えばグローバルワークスペースと予測処理の整合性)を明らかにし、AIモデル上でそれらを統合的に実装・検証する研究が重要となるでしょう。

身体性と環境との相互作用

人間の意識が身体を通じた感覚・行為ループと切り離せないように、人工エージェントにおいても能動的な環境とのやりとりが意識的機能を生む鍵と考えられます。今後の研究では、ロボティクスや強化学習の領域で予測符号化原理を導入し、自己モデルや主体性を持つエージェントを設計する試みが重要になるでしょう。

能動的予測モデルや美しいループ理論は、エージェントが自ら環境を探索し学習するプロセスを意識の根幹として位置付けています。これらを具体的なAIロボットや対話システムに実装し、自発的な予測・計画と適応的振る舞いが現れるか検証することが、人工意識研究の次のステップとなります。

大規模モデルへの適用と実用化

近年の研究では、バックプロパゲーションと予測符号化を統合した学習アルゴリズムや、予測符号化を用いたニューラルネットワークを効率良く記述できるフレームワークの開発も模索されています。こうした技術的ブレークスルーがあれば、予測符号化由来のモデルを大規模データ上で訓練し、脳型AIの実用化に近づく可能性があります。

まとめ:予測符号化が切り拓く知能の未来

予測符号化は、脳の情報処理原理に基づいた学習手法として、従来の深層学習とは異なるアプローチで高度なAIの実現を目指しています。自由エネルギー原理に支えられた階層的予測モデルは、局所的な学習、安定した収束、生物らしい学習特性といった利点を持ち、ニューロモーフィック・ハードウェアへの実装可能性も示しています。

さらに注目すべきは、予測符号化モデルが人工意識研究との接点を持つ点です。脳の予測処理を再現し、能動的な世界モデルを構築し、再帰的な信念共有によって統合された主体性を実現するという試みは、単なる性能向上を超えた知能の質的変化をもたらす可能性があります。

もちろん、スケーラビリティや計算コストといった技術的課題、意識の定義と検証という理論的課題、そして倫理的な問題など、解決すべき点は多く残されています。しかし、脳科学・認知科学とAI工学を結ぶこの学際的挑戦は、真に知的で主体性を持つAIシステムの実現に向けた重要な一歩となるでしょう。

コメント