説明可能AIの「本当の目的」は可視化ではなく翻訳である

AI技術が社会実装の段階に入るにつれ、「なぜそう判断したのか」を説明できるAIへの需要は急速に高まっている。しかし、説明可能AI(XAI: Explainable AI)の研究や実装において、見落とされがちな根本的な問いがある。それは「誰のために、何のために、説明するのか」という問いだ。

XAIをただのモデル可視化技術として捉えると、ヒートマップや特徴量グラフを出力することがゴールになる。だが実際には、AIの判断根拠を人間が理解し、適切に信頼し、正しく運用するためには、単なる可視化以上のものが必要だ。

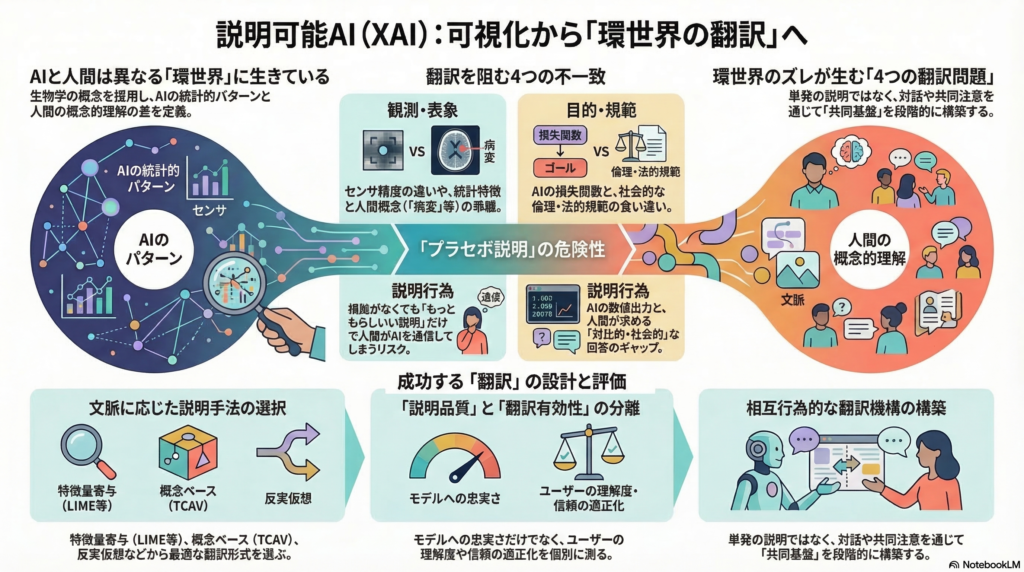

本記事では、XAIの本質を「異質な認知システム間で意味と意図をすり合わせる翻訳(translation)」として再定義し、生物学・認知科学における「環世界(Umwelt)」の概念と組み合わせることで、AI説明の成功と失敗を分ける構造的な要因を掘り下げる。

環世界(Umwelt)とは何か:AIと人間の「見ている世界」の違い

ユクスキュルの環世界概念とAI研究への応用

「環世界(Umwelt)」は、生物学者ヤーコプ・フォン・ユクスキュルが提唱した概念で、生物が知覚・行為を通じて立ち上げる「主体固有の世界」を指す。たとえば、マダニが温度と匂いだけで世界を認識するように、各生物は自らのセンサと行為能力によって異なる世界に生きている。

これをAI研究に転用すると、深層学習モデルもまた「人間とは異なる環世界に生きている」と言える。画像分類モデルは、ピクセルの統計的パターンを通じて世界を捉えており、人間が「病変」と呼ぶ概念とモデルが検出する特徴量は必ずしも一致しない。

身体性・エナクション・共同意味形成の3層構造

環世界をXAI分析に活用するうえで重要な3つの層がある。

第一は**エンバディメント(embodiment)**だ。センサや身体の構造が知覚内容を規定する。カメラ画像しか持たない自動運転AIと、視覚・触覚・平衡感覚を持つ人間ドライバーでは、同じ「危険な状況」の認識が根本的に異なる可能性がある。

第二は**エナクション(enaction)**だ。フランシスコ・ヴァレラらが体系化した概念で、意味とは脳内の表象処理によって生まれるのではなく、身体と環境の相互作用の中で立ち上がる。AIが出力するラベルや確率値は、人間が実際の行為文脈に埋め込むことで初めて「意味」を持つ。

第三はナラティブ的環世界だ。言語・説明・物語は、共同注意や社会的相互作用を通じて「共同基盤(common ground)」を増やす実践である。ここがXAIの主戦場になる。

翻訳問題の定式化:4種類の「ズレ」を理解する

XAIにおける翻訳問題とは、AIシステムと人間(専門家・非専門家)の間に生じる認知的なズレを埋めるプロセスだ。このズレは少なくとも4つの種類に分類できる。

観測の不一致

同じ環境でも、センサや前処理・注意機構が異なれば入力空間は一致しない。医療AIが学習した画像の解像度や撮影プロトコルが臨床現場と異なれば、説明が正確でも現場では意味をなさない可能性がある。

表象の不一致

人間が使う概念(「肺炎」「危険な走行状態」など)と、モデルが内部で使う統計的特徴量は一致しないことが多い。TCAVのような概念ベースの手法は、この「概念のズレ」を埋めるために開発されたが、そもそも概念セットの定義が難しいという課題も残る。

目的・規範の不一致

最適化目標(損失関数・報酬設計)と、実社会で求められる倫理的・法的な規範は異なる。自動化バイアスや意図せぬショートカット学習(例:病変の特徴でなく撮影機器の差異を学習してしまう)はこの不一致から生じる。

説明行為の不一致

人間の説明は対比的・社会的であることが多い。「なぜAではなくBを選んだのか」という問いに対して、モデルが確率値の羅列を返しても翻訳は成立しない。質問の形・期待する粒度・文脈への適合性が問われる。

XAI手法の体系:どの説明形式が「翻訳」に向いているか

XAIの手法は多様だが、翻訳問題の観点から整理すると、それぞれが「環世界の差」をどの程度吸収できるかで評価が変わる。

局所説明・特徴寄与系(LIME・SHAP)

LIMEは特定入力の近傍で単純モデルを当てて局所的な説明を生成し、SHAPはゲーム理論(シャプレイ値)をベースに各特徴量の寄与を統一的に表現する。実装の容易さとモデル非依存性が強みだが、局所近傍の選び方によって結果が不安定になりやすく、忠実性(モデルの実際の計算を反映しているか)が保証されない場合がある。

サリエンシ(勾配・ヒートマップ系)

画像や時系列データに対して直感的な可視化を提供するが、見栄えが良くても忠実性や頑健性が低いリスクがある。「サニティチェック(健全性検査)」──ランダム化テストでサリエンシがモデルやデータに本当に依存しているかを検査する手法──の重要性が指摘されており、検証なしに信頼するのは危険だ。

概念ベース説明(TCAV)

ユーザ定義の概念に対するモデル内部の感度を方向微分で定量化する。人間の言語概念とモデルを「翻訳辞書」でつなぐアプローチとして有望だが、概念データの定義が難しく、前提となる概念セットに大きく依存する。

反実仮想説明

「入力をこう変えれば別の出力になる」という形式で、行動可能性を直接提示する。異議申立や介入設計に向いているが、提案される変更が社会的に実現可能か、あるいは不当な属性変更(変えられない特性の要求など)になっていないかを規範制約とセットで検討する必要がある。

因果説明

相関ではなく介入を含む因果構造で説明することで、「なぜ」への回答品質が上がる可能性がある。ただし因果仮定の構築やデータ要件が重く、実装のハードルは高い。

対話型説明・メタ説明

質問者と説明者の対話として説明をモデル化する対話型アプローチは、共同基盤を増やしやすいが、設計・評価コストが高い。また、説明手法自体の限界や誤解リスクを示す「メタ説明」は、過信を抑制するうえで重要であり、特に高リスク領域での導入が推奨される。

実装事例:ロボティクス・医療・自動運転における翻訳の成否

ロボティクスとHRI(ヒューマン-ロボットインタラクション)

ロボット領域での翻訳問題は、「なぜこの行動・計画を選ぶのか」の共有にある。成功事例に共通するのは、ロボット側が人間の期待モデルを計画段階から織り込む「説明可能な計画(explicability)」の発想だ。人の期待から外れた行動をとる際に差分を説明することで、共同基盤を段階的に増やしていく。

一方、失敗パターンとして繰り返し報告されるのは次の3点だ。ロボット側の概念地図と人間の概念が一致しない状況での言語説明、共同注意が成立していない状態での誤訳の連鎖、そして対話コストが現場の運用に乗らないケースである。

医療診断支援AIにおける翻訳の限界

医療AIの説明は、規制対応だけでなく臨床意思決定の「監督可能性」に組み込まれる必要がある。しかし現状の説明(特に可視化中心)が、患者レベルの意思決定支援に対して過大な期待を生んでいるという批判も根強い。

典型的な失敗モードは2つある。第一に、サリエンシマップが入力の微小な摂動で大きく変化し、臨床判断を誤誘導するリスクがある。第二に、医療AIが疾患特徴ではなく撮影機器や患者属性などのショートカットを学習し、その説明もそれを覆い隠してしまう可能性がある。翻訳問題として整理すると、「人間の環世界(病理・生理・所見中心)とモデルの環世界(データ収集の痕跡中心)がズレる」事象だといえる。

成功に向けては、サリエンシ偏重を避け多様な説明形式(概念・反実仮想・因果)を組み合わせること、説明の限界を含めたメタ説明の設計、そして臨床ワークフロー内での実証評価(application-grounded)が重要な要素として挙げられる。

自動運転における環世界の翻訳失敗と事故リスク

自動運転・運転支援では、説明は「車両の意思決定を理解させる」だけでなく、適切な監視・介入・引継ぎを促すコミュニケーション手段として位置づけられる。

過信による事故は繰り返し報告されており、米国国家運輸安全委員会(NTSB)が調査した2018年の事故事例でも、システムの限界の未伝達・運転者の過信・監視設計の不備が原因として挙げられている。環世界翻訳の観点では、「車両側の環世界(センサと制御の前提・機能限界)が、運転者側の環世界(今何ができるか・できないかの行為可能性)に適切に翻訳されなかった」問題として解釈できる。

翻訳有効性の評価:「説明品質」と「相互理解」を分けて測る

XAIの評価は、説明品質(モデル忠実性)と翻訳有効性(相互理解の成立)を分離して設計することが重要だ。

説明品質の指標としては、局所忠実性(局所領域での近似精度)、帰属の健全性(ランダム化テストによる検査)、概念感度(人間概念に対するモデルの内部感度)、反実仮想の妥当性(最小変更性・実現可能性)が挙げられる。

翻訳有効性の指標としては、メンタルモデル精度(利用者がモデルの出力や失敗を予測できるか)、共同基盤増分(対話後に共有される前提・用語の一致度)、行為整合(同一状況での推奨行動の一致度)、信頼較正(性能に見合った信頼ができているか)、認知負荷(NASA-TLXなど)が実務的に使いやすい。

特に重要な点として、「プラセボ説明」問題がある。実際の根拠に基づかない説明であっても、もっともらしさだけで信頼を上げてしまう可能性がある。翻訳インターフェースが「説得装置」に堕するリスクは、過信抑制の設計と切り離せない課題だ。

まとめ:XAIの未来は「翻訳の設計」にある

説明可能AIの本質は、モデルの内部状態を可視化することではなく、異質な認知システム間で意味と意図を共有する翻訳プロセスを設計することにある。環世界の観点は、その翻訳がなぜ失敗し、何を条件に成功するかを構造的に理解するための有効なフレームを提供する。

記事の要点をまとめると:

- XAIの説明形式(局所説明・サリエンシ・概念ベース・反実仮想・因果・対話型)はそれぞれ「翻訳適性」が異なり、文脈に応じた選択が必要

- 環世界差が大きいほど、説明の提示だけでは不十分で、共同注意・プロトコル学習・行為-感覚対応付けを含む相互行為的な翻訳機構が求められる

- 評価は「説明品質」と「翻訳有効性」を分離し、忠実性・メンタルモデル獲得・意思決定改善・過信抑制を同時に測る必要がある

- 医療・自動運転・ロボティクスの失敗事例は、いずれも「環世界のズレ」として再解釈できる

コメント