はじめに

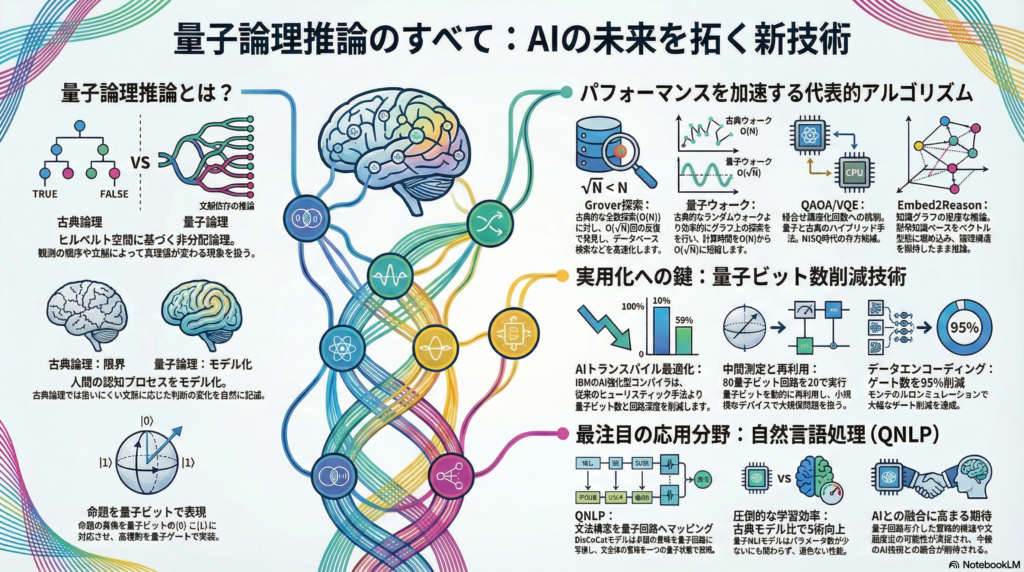

量子コンピューティングの発展に伴い、従来の古典論理では捉えきれない推論や計算を実現する「量子論理推論」が注目を集めています。量子論理は、ヒルベルト空間上の部分空間格子に基づく非分配論理であり、文脈依存的な真理値を表現できる特性を持ちます。この特性は、人間の認知や推論における文脈依存性など、古典論理の排中律や分配律に反する現象を自然に記述できる可能性を秘めています。

本記事では、量子論理推論の基本構造から代表的な量子アルゴリズム、実装技術、さらには自然言語処理への応用まで、最新の研究動向を交えながら包括的に解説します。

量子論理推論の基本構造

非分配論理と文脈依存性

量子論理の最大の特徴は、古典論理とは異なる非分配的な構造にあります。古典命題論理では分配律(A∧(B∨C) = (A∧B)∨(A∧C))が成り立ちますが、量子論理ではこれが一般には成立しません。この性質により、観測の順序や文脈によって真理値が変化する現象を表現できます。

人間の推論プロセスにおいても、文脈によって判断が変わる現象は珍しくありません。量子論理は、こうした古典論理では扱いにくい認知現象をモデル化する有力な枠組みとして研究されています。

量子ビットによる命題表現

最近の研究では、古典的な命題を量子ビット状態にマッピングする手法が提案されています。真理値を|0⟩と|1⟩に対応させ、あいまいな信念は重ね合わせ状態として符号化します。

論理則(例:「AかつBならC」)は、A・Bを制御ビット、Cをターゲットとする多重制御回転ゲートで実装されます。これにより、真理値間に量子的相関を与えることが可能です。さらに、「矛盾する命題の両立は許さない」といった制約は、位相ゲートで矛盾状態に位相を付与し、破壊的干渉を起こすことで実現されます。

こうした量子推論では、推論過程を量子状態の干渉過程として扱い、一連のユニタリ変換を学習可能なパラメータで構成する可微分モデルも提案されています。

代表的な量子アルゴリズム

Grover探索アルゴリズム

未構造探索問題に対するGroverのアルゴリズムは、量子コンピューティングの代表的な成功例です。古典的な全数探索がO(N)時間を要するのに対し、Groverアルゴリズムは√N回の反復で解を発見できます。この二乗根の高速化は、データベース検索や最適化問題において実用的な優位性をもたらす可能性があります。

Groverアルゴリズムは量子ウォークの一種としても解釈でき、重ね合わせと干渉という量子力学的性質を巧みに活用した手法です。

量子ウォーク探索

量子ウォークは、古典的なランダムウォークの量子版であり、重ね合わせと干渉によって探索効率を向上させます。古典的ランダムウォークではグラフ上のマーク探索にO(N)時間がかかりますが、量子ウォークではO(√N)時間に短縮されます。

要素の重複検出問題(element distinctness)では、古典のO(N)に対し、量子ウォークを用いてO(N^{2/3})のアルゴリズムが実現されています。このほか、グラフの三角形検出やNAND木評価など、多項式的な速度向上をもたらす問題にも応用可能です。

ただし、古典手法に対する指数的優位性がある問題は限定的で、多くはGroverレベルの二乗加速に留まるのが現状です。

QAOA/VQEと組合せ最適化

組合せ最適化問題に対しては、量子近似最適化アルゴリズム(QAOA)や変分量子固有値ソルバー(VQE)が用いられます。これらは変分的手法であり、古典コンピュータと量子コンピュータを組み合わせたハイブリッドアプローチを採用しています。

NISQ(Noisy Intermediate-Scale Quantum)時代の量子デバイスにおいて、エラーの影響を抑えつつ実用的な問題を解くための有力な候補とされています。

Embed2Reason:知識グラフ推論

IBMのEmbed2Reason(E2R)は、記号知識ベースを量子論理理論に触発された高次元ベクトル空間に埋め込む手法です。論理構造を保持したままクエリ推論を行うことができ、符号付グラフクエリなどへの適用が報告されています。

知識グラフやオントロジーを扱う際、Embed2Reasonのような手法は、従来の統計的関係学習手法を上回る性能を示す可能性があります。

量子ビット数削減の実装技術

現実的なNISQデバイス上で複雑な量子回路を実行するには、量子ビット数と回路深さの削減が不可欠です。

AIトランスパイル最適化

IBMは、AI強化型のQiskitトランスパイラパスを開発しています。従来のヒューリスティック手法に比べて必要量子ビット数を減らし、回路深度も浅くできることが報告されています。実験では、AIパスの併用により平均して2量子ビットゲート数を42%削減する例もあります。

高度なコンパイラや変換規則を用いてゲート数を削減することで、限られた量子リソースでより大規模な計算が可能になります。

中間測定と量子ビット再利用

現在の量子機器では、中間測定およびリセットが可能なものが増えています。これを利用して、量子ビットを動的に再利用する技術が開発されています。

実際に、80量子ビットで記述されるQAOA回路を20量子ビットの回路に圧縮し、量子プロセッサ上で実行した例が報告されています。この技術により、大規模な問題を小規模デバイスで扱えるようになります。

データエンコーディングと剪定

問題設定に応じて少ない量子ビットで表現する方法も重要です。量子ニューラルネットワークでは、入力データを事前処理で剪定し、情報量を損なわずに次元を削減する技術(ATP)が提案されています。

動的に閾値を適用することで、必要な情報を保持しつつ不要なデータを削減し、効率的かつ柔軟にQNNを運用できる点が画期的です。また、モンテカルロシミュレーションの事例では、疑似乱数法と高度な回路圧縮技術により95%のゲート削減を達成した例もあります。

SoftBankの検証では、分子の対称性や活性空間を利用して回路を縮約できることが指摘されており、量子化学計算において実用的な削減効果が期待されています。

自然言語処理における量子推論の応用

DisCoCatモデルとQNLP

自然言語処理(NLP)分野では、文法構造と量子回路の結合構造の対応を利用した「量子自然言語処理(QNLP)」が注目されています。

CoeckeらはDisCoCatモデルと呼ばれる枠組みで、単語ベクトルのテンソル積結合を量子回路に写像し、文の意味を量子状態で表現する方法を提案しました。2016年にはZengとCoeckeらが初の量子計算を用いたNLPアルゴリズムを提案し、理論上の計算量優位性を示しています。

初期提案では、文分類タスクに対して古典的な行列積の代わりにGrover探索を組み合わせることで、指数的コストの回避可能性が議論されています。

量子NLIモデルの性能

近年の応用例として、量子回路モデルを用いた自然言語推論(NLI)タスクが報告されています。Sunら(2025)は、DisCoCatベースの量子回路モデルで前提–仮説ペアを符号化し、従来のTransformerモデルと比較しました。

結果として、パラメータ数が大幅に少ないにもかかわらず性能が遜色なく、学習効率(パラメータ当たりの情報利得)は古典比で5桁も高いことが示されました。この研究は、量子回路を介した意味的推論や文脈推定の可能性を実証するものです。

最新研究動向とプロジェクト

量子論理推論に関する研究は、世界中の主要な研究機関で活発に進められています。

Embed2Reason(IBM, MIT, Oxford):量子論理を用いた知識グラフ埋め込み手法として、NeurIPS 2019で発表されました。ノード埋め込みを量子状態で扱い、論理クエリ精度を向上させています。

量子回路推論モデル:パラメータ化した量子回路で論理推論を実装し、経験的に学習するフレームワークがarXiv 2025で提案されています。

量子自然言語処理プロジェクト:Bob Coecke(Oxford)らが構築した「DisCoCat」「lambeq」ライブラリを用いた研究が進展しており、2025年にはSunらがNLIタスク適用を報告しています。

量子ウォーク探索研究:連続時間量子ウォークによる空間探索の最適性について、ChakrabortyやSahuらによる成果がScientific Reportsなどで発表されています。

回路圧縮・最適化ツール:ClassiqやQuantinuum、IBMなどがAI駆動のコンパイラ技術を開発しています。2025年にはClassiqが金融モンテカルロシミュレーションで95%圧縮を達成し、SoftBank研究所も化学回路の圧縮事例を報告しています。

主要研究者としては、Bob Coecke(QNLP)、Dinesh Garg(IBM, Embed2Reason)、William Zeng(Quantinuum)、Matthew DeCross(Quantinuum)、Chakraborty(IISc)などが活発に活動しています。日本ではSoftBankおよび富士通・理研・量研などが量子回路最適化の研究を推進しています。

まとめ:量子論理推論の未来展望

量子論理推論は、古典論理では扱いきれない文脈依存性や非分配性を自然に表現できる強力な枠組みです。Grover探索や量子ウォークといった代表的アルゴリズムは、未構造探索やグラフ探索において古典手法に対する二乗根の高速化を実現しています。

実用化に向けては、量子ビット数削減が重要な課題です。AIトランスパイル最適化、中間測定による再利用、データエンコーディングなど、多様な技術が開発され、NISQデバイス上での実行可能性が向上しています。

特に注目すべきは、自然言語処理への応用です。DisCoCatモデルやlambeqライブラリを用いたQNLPは、少ないパラメータで高い学習効率を示しており、今後のAI技術との融合が期待されます。

量子論理推論は、知識グラフ推論、組合せ最適化、自然言語理解など、幅広い分野への応用可能性を持ちます。今後の研究により、理論的優位性が実用的なアドバンテージへと転換されていくことが期待されます。次のステップとしては、より大規模な問題への適用、エラー耐性の向上、そして量子デバイスと古典デバイスのハイブリッド活用が重要なテーマとなるでしょう。

コメント