ベイトソンの学習II・IIIと量子機械学習(QSVM)を接続する:メタ学習・自己組織化の視点から

グレゴリー・ベイトソンが提唱した階層的学習理論は、50年以上を経た今も認知科学・組織論・教育学などで参照され続けています。一方、量子コンピュータを機械学習に応用する「量子機械学習(QML)」は、古典的手法では難しい特徴抽出や大規模分類を実現しうる新興分野として急速に発展中です。

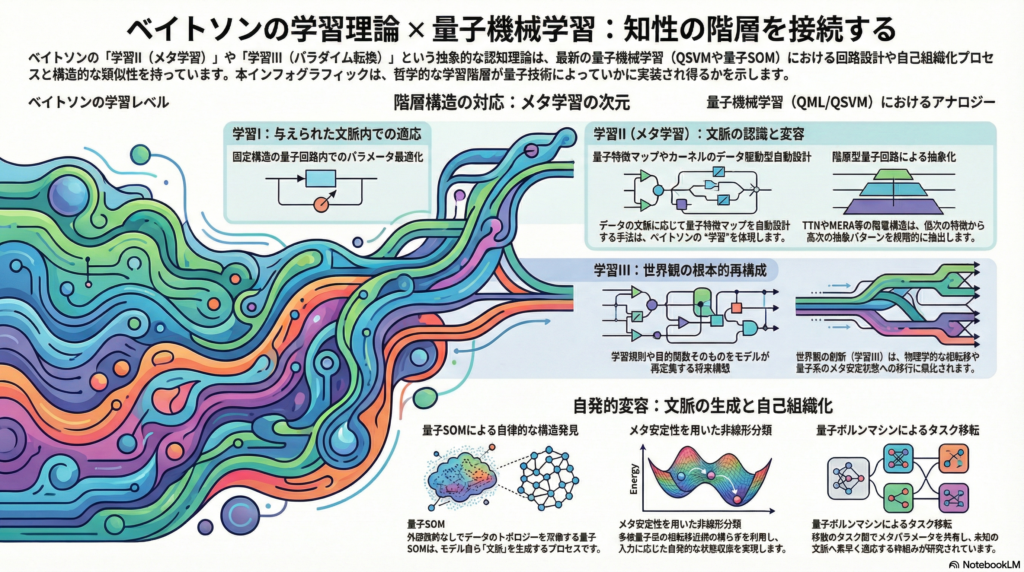

一見異なる文脈の両者ですが、「学習者がいかに文脈を自ら生成・変容させるか」 という問いにおいて、驚くほど近い概念構造を持ちます。本記事では、ベイトソンの「学習II」「学習III」の骨格を整理したうえで、量子サポートベクターマシン(QSVM)を中心とした量子機械学習にどう接続できるかを、最新研究を交えて論じます。

ベイトソンの学習II・IIIとは何か:階層的学習の骨格

学習Iから学習IIへ:「学習の学習」が始まる

ベイトソンは生物の学習を複数の階層に分類しました。最も基礎的な学習I(プロト学習)は、特定の刺激に対する反応を修正する条件づけに相当します。これはいわば「与えられたルールの中での適応」です。

これに対し学習II(デューテロ学習)は、学習者が「今どのような文脈にいるか」を把握し、状況に応じて学習戦略そのものを変える能力です。単に正解を覚えるのではなく、正解を導く枠組み自体を習得する——これをベイトソンは「学習の学習」、すなわちメタ学習と定義しました。

学習IIの特徴として見逃せないのは、この段階で獲得された前提は自己強化的・自己正当化的になる点です。一度「この文脈ではこのルールが有効だ」という認識が定着すると、それを覆す証拠があっても見落とされやすくなります。組織論でいう「ダブルループ学習」の困難さも、この性質に由来します。

学習III:世界観そのものを刷新するパラダイム転換

学習IIIはベイトソン理論の中でも特に稀な変容として位置づけられます。これは学習IIで前提としていた価値観・自己概念・世界観の枠組み自体を根本から書き換えるプロセスです。

人間においては精神療法の転機や宗教的悟りといった場面でしか起こりにくいとベイトソンは述べており、「人間にすら困難で稀」な出来事と表現しています。それは特定のスキルを修正するのではなく、自分が何を「正常」とみなし何を「問題」とみなすかという認識の前提ごと変わる体験です。

物理学的なアナロジーで捉えるなら、学習IIIは相転移に近いプロセスです。系が一つの安定状態(既存の世界観)にある期間を経て、一時的にメタ安定な揺らぎを経由し、まったく異なる安定状態(新しい世界観)へと移行する——この過程は、後述する量子系のメタ安定性と共鳴します。

量子機械学習(QML)とQSVMの理論的枠組み

量子コンピュータが機械学習にもたらす可能性

量子機械学習(QML)は、量子重ね合わせ・量子エンタングルメントといった量子力学の特性を機械学習モデルに活用しようとする研究分野です。量子コンピュータは指数的に大きなヒルベルト空間を扱えるため、適切に設計することで古典計算機が多項式時間を要するタスクを、理論的には指数的に短縮できる可能性があります。

その代表的手法が量子サポートベクターマシン(QSVM)です。古典的なSVMはカーネル関数を用いて非線形データを高次元空間で線形分離しますが、QSVMは量子状態空間そのものを特徴空間として利用し、カーネル行列の計算をHHLアルゴリズムなどの量子アルゴリズムで効率化することで、大規模データに対する分類の高速化を図ります。

量子特徴マップの課題:何を「文脈」として選ぶか

QSVMの性能を左右するのが量子特徴マップ——古典データを量子状態に変換するエンコード回路——の設計です。どの量子特徴マップを用いるかで学習の成否が大きく変わりますが、「最適な特徴マップを体系的に設計する汎用的な方法」はいまだ確立されていません。

かつては問題に依存しない固定回路Ansatzが一般的でしたが、それでは帰納バイアスの欠如による勾配消失や非効率な大規模回路という問題が生じやすい状況でした。この課題への対応として、データ駆動で回路を自動設計するアプローチが浮上しています。その一例がQ-FLAIR(Quantum Feature-Map Learning via Analytic Iterative Reconstructions)です。

Q-FLAIRは空の回路から始め、有効なゲートを一つずつ解析的に評価しながら追加していくボトムアップ設計を採用します。この手法により、従来は特徴次元(784次元)の大きさゆえに実機学習が困難だったMNISTの2クラス分類で、90%以上の精度を実現したことが報告されています。特徴次元数に依存しないリソース効率を達成した点で注目を集めています。

学習II・IIIの原理とQSVMへの接続:3つの視点

視点① 階層構造:学習の抽象レベルを重ねる

ベイトソンが示した学習の多層構造は、量子機械学習の階層型量子回路に類比できます。ツリーテンソルネットワーク(TTN)やMERAのような木構造回路は、量子ビットの集約とユニタリ操作を階層的に重ねることで、低レベルの特徴から高レベルの抽象パターンへと段階的に特徴抽出を行います。

この構造は、学習I(個別パターンの学習)を積み重ねることで学習II的な効果(より抽象的なパターン認識)が生まれる、というベイトソンの階層観と共鳴します。実際、より深い階層構造を持つ量子分類器ほど高い分類精度を示す可能性があることも研究から示唆されています。

QSVMそのものは単一階層の分類器ですが、量子カーネル法という仕組みを通じて事実上、暗黙の特徴抽出が階層に内包されています。そしてどのカーネル(特徴空間)を選ぶかという判断は、まさにメタレベルの設計——学習IIにおける「文脈を選び取る能力」——に相当します。

| 学習レベル(ベイトソン) | QML/QSVMにおけるアナロジー |

|---|---|

| 学習I:与えられた文脈内での行動修正 | 固定構造の量子回路内でのパラメータ最適化 |

| 学習II:学習方法・文脈の認識と変容 | 量子特徴マップやカーネルをデータに応じて自動設計・適応 |

| 学習III:世界観・目的関数の根本的再構成 | 学習規則や目的関数そのものをモデルが再定義する将来的構想 |

視点② 文脈生成的学習:タスクをまたぐ知識の移転

ベイトソンが強調した「文脈の生成」——学習者が現在の状況を見極め、それに応じた振る舞いを自発的に選ぶ能力——は、量子メタ学習の研究とも接点を持ちます。

Nikoloskaら(2022年)は量子ボルンマシンを用いたベイズ推論型メタ学習の枠組みを提案しています。複数のタスク分布に対して共有メタパラメータを量子回路で表現し、タスク固有パラメータを素早く適応させる二段階の学習(内ループと外ループの最適化)を実現しています。これはまさにベイトソンの言う「文脈をまたいで知識を共有し、新しい文脈でも素早く適応する」メタ学習の量子実装と言えます。

また、古典LSTMを用いて量子回路のパラメータ更新規則そのものを学習する「学習の学習」実験(Verdonら、2019年)も報告されており、量子システムにおけるメタレベルの適応がすでに実験的に探索されていることがわかります。

将来的には、QSVMが複数のデータ分布を経験しながら最適な量子特徴マップやハイパーパラメータを自律的に獲得する、という構想が描けます。それはベイトソンの「文脈の学習」が機械学習アルゴリズムに実装される姿に近いでしょう。

視点③ 自己組織化とメタ安定性:モデルが内部秩序を自発的に形成する

ベイトソン理論との接続で特に示唆深いのが、量子自己組織化マップ(量子SOM)と量子ニューラルネットにおけるメタ安定性の活用という二つの研究です。

量子SOМについて、Deshmukhら(2025年)はKohonenのSOMを量子計算に拡張した変分量子自己組織化マップを発表しました。ユークリッド距離の代わりに量子状態間のフィデリティ(量子的な重なり)を類似度指標として用い、高次元ヒルベルト空間上のデータを低次元グリッドにトポロジーを保ちながら写像します。この量子SOMはアイリスデータセットの3品種を明確に分離するマップを構築することに成功しており、外部の教師なしでモデルがデータの構造を自律的に発見・マッピングする自己組織化の実例として注目されます。

ベイトソンの枠組みで言えば、この量子SOMは学習者(モデル)が新たな文脈(クラスタ構造)を自発的に形成しているプロセスと解釈できます。意味のあるまとまりをデータから自ら発見し、内部に新しい区分けを生み出す——これは「文脈の生成」という学習IIの特質を機械学習モデルに見出す試みです。

メタ安定性の活用について、Bonebergら(2024年)は量子ニューラルネットが本質的に線形であるという課題に対し、多体量子系の相転移近傍でのエルゴード性の破れを利用することで、実効的な非線形分類を実現できることを示しました。

局所的に線形なユニタリ操作しか行わない量子回路でも、大規模な相互作用系が熱力学的極限で示す相転移現象の近似的な振る舞いとして、複数の準安定状態(メタ安定状態)が現れうることが知られています。この性質を活用すると、入力に応じてネットワークが異なるメタ安定出力へと自発的に収束し、設定された目的関数なしにデータの構造を反映した複数の状態を生み出すことが可能になります。

この「複数のメタ安定状態が共存し、入力に応じていずれかへ収束する」という構造は、ベイトソンの学習IIIにおける相転移的な変容プロセスのアナロジーとして解釈できる余地があります。系が複数の準安定的な解釈枠組みを同時に内包しながら、入力に応じていずれかに着地していく様子は、「異なる文脈の間で揺れながらやがて新たな安定状態へ移行する」という学習IIIの動態と構造的に類似しています。

まとめ:概念的接続の意義と今後の展望

本記事で見てきたように、ベイトソンの学習II・III理論と量子機械学習の発展は、以下の三点において概念的な接続可能性を持ちます。

まず階層性の観点では、ベイトソンが学習の多層構造を強調したように、階層型量子回路やQ-FLAIRのような適応的な回路設計が、固定された学習から「学習の学習」へと段階を引き上げる試みとして位置づけられます。

次に文脈生成的学習の観点では、量子ボルンマシンを用いたメタ学習やタスク間の知識共有アルゴリズムが、「現在置かれた文脈を見極め適応する」というベイトソン的な能力の量子実装として注目されます。

そして自己組織化とメタ安定性の観点では、量子SOMとメタ安定性を活用した量子ニューラルネットが、外部教師なしに内部秩序・パターンを自発的に形成する能力を示しており、学習者が文脈を自律的に創出するというベイトソン的なプロセスを体現しています。

ただし、学習IIIに相当するパラダイム変革的な変容——すなわちモデル自身が目標や学習規則を根本から再定義するプロセス——は、現時点では概念的提案の段階にとどまります。理論的にもハードウェア的にも多くの課題が残されています。

しかし、「機械学習モデルが自己をメタ的に制御・変容する」という問いに向き合うとき、ベイトソンの洞察は設計指針として深い示唆を持ちます。パターンと文脈の認識という視点は、量子機械学習における特徴量設計やモデルアーキテクチャの再考に、今後も刺激を与え続けるでしょう。

コメント