説明可能AI(XAI)はなぜ「生活世界への翻訳」が必要なのか

AIシステムが医療・司法・教育など社会の重要な局面に組み込まれるにつれ、「なぜそのような判断が下されたのか」をユーザーが理解できることの重要性は増している。しかし従来のXAIは、特徴量の重要度グラフや注意マップを可視化する「ブラックボックスの開示」に留まりやすく、非専門家が日常的な意思決定に活用できる形になっていないことが多い。

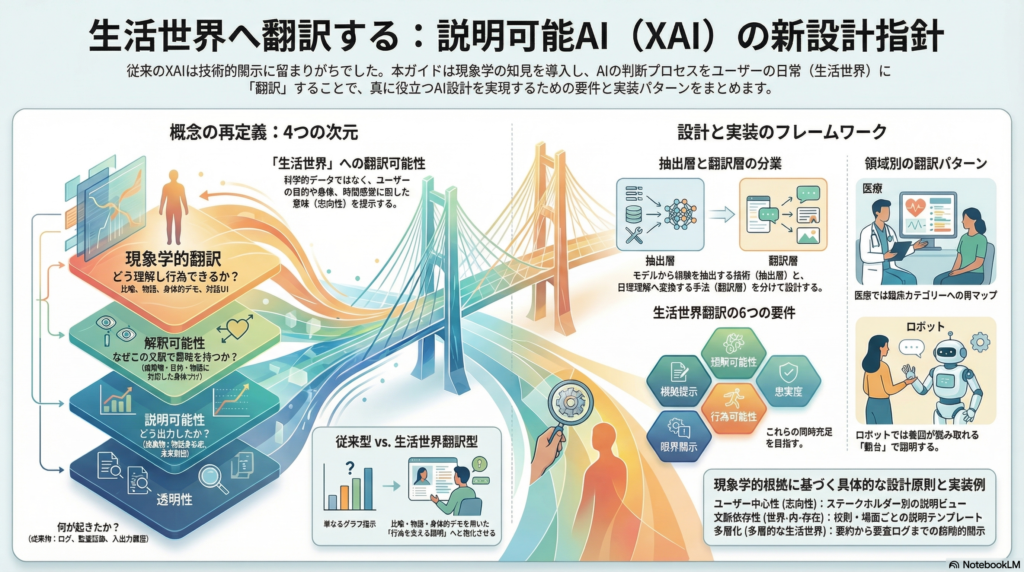

本記事では、XAIを**現象学的な「生活世界(Lebenswelt)への翻訳可能性」**として再定義するアプローチを紹介し、設計原則・技術実装・評価指標・法的枠組みを体系的に整理する。医療・司法・教育・ロボットという異なる領域のケーススタディも示すことで、抽象論にとどまらない具体的な設計像を提示する。

XAIにおける三つの概念を整理する――透明性・説明可能性・解釈可能性

XAIの議論では、「説明」という一語の下に異なる目的が混在しがちである。NISTが整理する三区分を起点とすると、概念の混同を避けやすくなる。

透明性・説明可能性・解釈可能性の違い

**透明性(Traceability)**は「何が起きたか」を問う。ログや監査証跡、入出力履歴が主な成果物となる。典型的な失敗は、記録はあるが利用者が読めない、または監査時に再現できないケースである。

**説明可能性(Explainability)**は「どうやって出力に至ったか」を問う。特徴寄与度・サロゲートモデル・反実仮想・概念ベース説明などが代表的な手法となる。ここでの落とし穴は、視覚的にもっともらしいが実際のモデル挙動に忠実でない「見た目の説明」が生まれやすい点である。

**解釈可能性(Interpretability)**は「なぜそれがこの目的・文脈で意味を持つか」を問う。目的・価値・文脈に接続した意味づけが求められるが、情報は出力されても意思決定に接続しない、あるいは誤った信頼を生むという失敗が起きやすい。

「生活世界への翻訳可能性」という第四の概念

本記事が注目するのは、これら三概念に加えた現象学的な翻訳層の必要性である。つまり、「その判断は、私の生活・実践・身体・時間の中でどう理解し行為できるか」を問う次元だ。この問いに応えるためには、比喩・物語・身体的デモ・対話型UIを組み合わせた多層設計と、限界の明示が不可欠となる。

現象学から導く説明設計の要件

現象学をXAI設計に接続する核心は、「説明」を情報提示ではなく、ユーザーが世界の中で意味を取り出して行為へ接続するプロセス(意味生成)として捉え直す点にある。

フッサールの志向性と生活世界

フッサール現象学の核は、意識が常に「何かについての」意識であるという志向性にある。生活世界(Lebenswelt)は、科学的客観化に先立つ経験世界であり、日常的カテゴリー・目的・関心と直結している。

XAIへの含意は明確だ。モデル内部の重みや表現を提示するだけでは、生活世界の意味としては不足する。説明はユーザーが前提にしている日常的カテゴリーと目的に再接続されなければならない。

ハイデッガーの世界-内-存在と道具性

ハイデッガーは人間(Dasein)を**世界-内-存在(being-in-the-world)**として捉え、意味は孤立した主観と客観の対応ではなく、実践・社会・道具連関の中で立ち現れると論じる。

この視点をXAIへ移すと、説明は「AIを外から眺めるための説明」ではなく、ユーザーが遂行している実践(診療・採点・裁判・家事)という道具連関の中で「使える」理解を形成するものでなければならない。欧州AI法が求める「出力を解釈し適切に使用できる透明性」とも整合する方向性である。

メルロー=ポンティの身体性と知覚-行為ループ

メルロー=ポンティは、知覚を「外界が心に刻印される過程」ではなく、**生きられた身体(lived body)**による世界への関わり(行為としての知覚)として捉える。

含意は、説明がテキストや数値に限定されず、身体的比喩・動作デモ・視覚合図など、知覚-行為ループに乗る形式を含みうることだ。特にロボットや家電では、「行為が説明になる」設計、すなわち意図が読み取れる運動(legibility)の設計が重要になる。

生活世界への翻訳可能性:六つの要件

上記の現象学的考察を踏まえ、「生活世界に翻訳可能な説明」が同時に満たすべき要件は以下の六点に整理できる。

① 証拠・理由の提示:出力に対し、根拠や理由を付す。

② 意味のある理解可能性:ユーザーの個人差に応じた形式・粒度・語彙で提示する。

③ 説明忠実度(妥当性):提示された説明が、対象モデルの挙動に対して十分に忠実であること。視覚的にもっともらしいだけの説明は排除されなければならない。

④ 限界の開示(地平の明示):何が不確かで、何がモデルの能力範囲外かを明示する。

⑤ 行為可能性(Actionability/Recourse):説明が、理解のためだけでなく、異議申立て・改善・次の行動に資する。反実仮想説明を「行為を支える説明」と捉える立場はこの方向と一致する。

⑥ 現象学的翻訳:上記1〜5を、ユーザーの「世界内での実践」「身体」「時間的連続」「社会的規範」の中で読める形へ落とし込む。

設計原則と実装パターン:抽出層と翻訳層の分業

説明の生成プロセスは、抽出層(モデルから説明を作る技術)と翻訳層(生活世界へ落とし込む変換)に分けて設計することが有効である。

抽出層:代表的な説明技術

局所説明の代表としては、LIME(局所近傍で解釈可能モデルを学習)と、Shapley値に基づくSHAP(特徴寄与の公理的性質を備える)がある。どちらも予測の「理由らしさ」を提示するが、忠実度の検証が常に必要となる。

人間の概念(例:「縞模様」)にモデルの内部表現を接続する**概念ベース説明(TCAV)**は、志向的対象(ユーザー概念)に寄せる方向性を持つ。

反実仮想説明は「なぜそうなったか」に加えて「望む結果のために何を変えればよいか」というリコース情報を与えうる。ただし、相関モデルの反実仮想が因果信念を不当に誘導しうる点には十分な注意が必要だ。

翻訳層:日常理解へ変換する四つのアプローチ

メタファー(比喩)の活用と限界の自覚:AI比喩は理解を助ける一方で誤解も誘うため、比喩の射程を管理する設計が必要となる。

物語(ナラティブ)化:技術的説明(寄与度・反実仮想)を時間的・因果的連鎖として提示することで、非専門家の理解を支える。ただし生成物語はハルシネーションや誤導に注意が必要だ。

身体的比喩・デモ:ロボットの意図が読み取れる運動(legibility)や視線・間合いの設計は、説明を「読む」以前に「感じ取る」理解を支える。

限界開示:相関である可能性・適用範囲外・データの偏り等を明示し、ユーザーの過信を抑制する。

設計原則と現象学的根拠の対応

| 設計原則 | 現象学的根拠 | 実装パターン例 |

|---|---|---|

| ユーザー中心性 | 志向性・生活世界 | ステークホルダー別説明ビュー |

| 文脈依存性 | 世界-内-存在 | 役割・場面ごとの説明テンプレート |

| 時間的連続性 | 時間性 | ドリフト検出と説明同期・長期対話 |

| 対話性 | 意味は相互理解として形成 | Why/Why not/What if の質問応答 |

| 多層化 | 生活世界は多層で単一表現に還元できない | 要約・理由・反実仮想・監査ログの段階的開示 |

評価指標と評価プロトコル

生活世界翻訳の評価は、技術的妥当性・ユーザー理解・行為と信頼の帰結・社会的受容と法的適合を同時に扱う必要がある。

**理解度(定量)**は、説明後にモデル出力を当てられる予測可能性やエラー検出率をA/B実験などで測定する。

**理解度(定性)**は、半構造化面接やthink-aloud手法によるメンタルモデルの質・納得性の評価が有効だ。

**信頼(校正)**については、過信・不信のバランスや長期的な信頼維持を、適切な依存行動の観察を通じて評価する。

行動変容は、リコース行動(改善の試み)・異議申立ての質・意思決定の改善をログや追跡調査で確認する。

**妥当性(忠実度)**は、説明がモデル挙動に依存して変化するかをランダム化テストや感度分析で検証する。

誤導性は、説得的説明による不合理な選択や因果誤認誘導を行動実験で独立に検査する必要があり、特に物語化や言語生成AIを翻訳層に用いる場合には不可欠なガードレールとなる。

応用ケーススタディ:領域ごとの生活世界翻訳

医療:白箱モデルと臨床実践への接続

医療では、説明は納得だけでなく誤り検出・安全性・責任に直結する。GA2M(Generalized Additive Models with pairwise interactions)のような解釈可能モデルを用いると、肺炎リスクや再入院等を高精度かつ可読に示しながら、データ由来の危険なパターンを発見・修正できる可能性がある。

生活世界翻訳としては、寄与度グラフを「症状・所見・既往」という臨床カテゴリーに再マッピングし、時間的連続(過去24時間の変化)として根拠を提示したうえで、適用集団外・データシフトの限界を明示する構成が妥当とされる。

司法:異議申立て可能な説明の設計

司法領域では、リスク評価ツール(COMPAS)をめぐるバイアスや透明性の論争が示すように、「特徴が効いた」だけでは不十分だ。制度上の意思決定(保釈・量刑)における位置づけ、異議申立て・再審査のための情報、そして説明が説得・誘導に変質しないことが重要となる。

解釈可能な代替として、ルールリスト(CORELS)は「どの条件なら高リスク判定か」を明示でき、監査・反論可能性を高めうる。ただしどの特徴を使うべきかという規範判断は別途必要である。

教育:複数の生活世界への多層説明

教育領域のXAIは、教師(授業運営)・学習者(理解・動機づけ)・保護者(安心)・行政(説明責任)という複数の受け手を前提にする。教育向けXAI(XAI-ED)の枠組みは、ステークホルダー・提示方式・HCI設計・陥りやすい失敗を含む設計観点を提示している。

生活世界翻訳としては、学習者には比喩・例示で「なぜ間違えたか」を、教師にはクラス運用可能な粒度(介入ポイント)を、保護者・管理者には限界と公平性情報を提供するという多層・多受け手設計が有効となる。

日常家電・ロボット:行為としての説明

家庭内AIやロボットでは、説明は「読む」よりも先に「行為として理解される」側面が大きい。ロボット運動のlegibility(観察者が軌道から目的を推論しやすいこと)とpredictability(目的が既知のとき期待通りであること)は区別され、協働のためには意図表現が設計課題になる。

生活世界翻訳の実装は、動作・視線・間合いなどの非言語説明、対話で「なぜ今それをしたか/しなかったか」を補う説明、誤作動時には因果・責任・安全の説明を強化するという段階的構造が有効とされる。

倫理・法的枠組みとガバナンス

欧州AI法とGDPRの要求

欧州AI法(Regulation (EU) 2024/1689)は、高リスクAIについて、運用が十分に透明でありデプロイヤーが出力を解釈して適切に使用できること、そして関連性・アクセス可能性・理解可能性を備えた使用説明の提供を求める(第13条)。

GDPRでは、自動化意思決定(第22条)や情報提供義務(第13〜15条)の文脈で「論理に関する意味のある情報」の提供が求められ、当事者が理解して異議申立てや行為に移れるレベルの情報提示(リコース情報を含む)が必要となる。

透明性・プライバシー・バイアスの緊張関係

透明性と説明可能性は、プライバシーや安全保障と緊張関係に立ちうる。UNESCOのAI勧告も、透明性・説明可能性の重要性を強調しつつ、文脈に応じて他原則(プライバシー・安全等)との緊張を認めている。説明の受け手と目的を特定したうえで、最小限必要な解釈可能性(minimal necessary level)を設計することが重要になる。

国際標準との整合

OECDのAI原則は、透明性・説明可能性を「状況に応じた有意味な情報提供」および「異議申立て可能性」に接続しており、生活世界翻訳が単なるUX改善ではなく権利保障と関わることを示唆している。ISO/IEC 42001(AIマネジメントシステム)やISO/IEC 23894(AIリスク管理ガイダンス)は、組織的にリスクと責任あるAI運用を組み込む枠組みとして参照できる。

まとめ:生活世界翻訳可能なXAIの設計に向けて

本記事では、説明可能AIを現象学的な「生活世界への翻訳可能性」として再定義し、以下の論点を整理した。

まず、NISTの三区分(透明性・説明可能性・解釈可能性)に加えて、現象学的翻訳層という第四の次元が必要であることを示した。次に、フッサールの志向性・ハイデッガーの世界-内-存在・メルロー=ポンティの身体性という三つの現象学的概念が、それぞれ具体的な設計要件に翻訳できることを明らかにした。実装面では抽出層(LIME・SHAP・反実仮想等)と翻訳層(比喩・物語・身体的デモ・限界開示)の分業が有効であり、評価においては忠実度・理解度・誤導性・社会的受容を同時に測る必要がある。医療・司法・教育・ロボットという異なる領域では、同じXAI技術でも翻訳設計が異なることも確認した。

生活世界翻訳の追求は「分かりやすさ」の向上にとどまらず、ユーザーの自律的な判断・異議申立て・行為可能性を支える権利保障の問題でもある。説明は一度作って終わりではなく、モデル更新・ドリフト・社会的文脈の変化とともに継続的に更新され続けるべきものだ。

コメント