なぜ今、「非人間アクターの連合」がネットワーク設計の核心になるのか

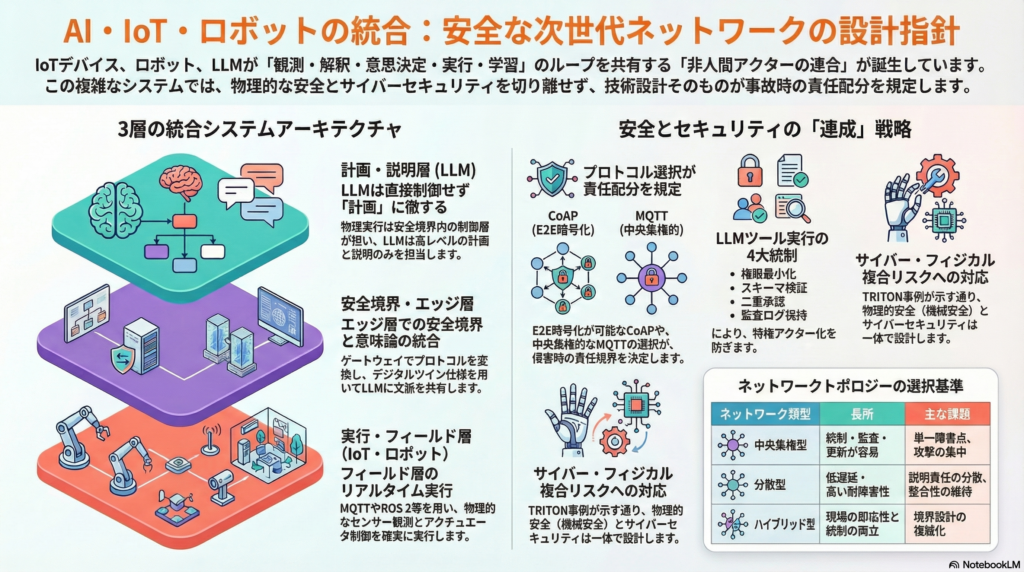

IoTデバイス、産業用ロボット、大規模言語モデル(LLM)が、同一の運用ネットワーク上で結合し始めている。これは単なる技術の組み合わせではなく、「観測→解釈→意思決定→実行→学習」という閉ループを、ソフトウェアだけでなく”モノ・機械・モデル”の集合として成立させる構造変化だ。

従来の「機器は末端、クラウドは頭脳」という二層構造は崩れ、分散・ハイブリッド・中央集権という三類型が競合する局面に移行しつつある。この変化の何が重要かといえば、相互運用性の設計が競争力と安全性を同時に規定する点にある。プロトコルをどこで終端するか、LLMにどこまで権限を与えるか、安全とセキュリティをどう連成させるか——これらの設計判断が、そのまま責任配分・規制適合・事故時の帰責構造を形作る。

本記事では、①技術スタック(IoT・ロボ・LLM)の特性と接続、②ネットワークトポロジーと相互運用性、③脅威モデルと代表的な侵害事例、④倫理・法規制・ガバナンス、⑤統合アーキテクチャと実装ロードマップ——の順に、実務に直結する形で整理する。

IoT通信プロトコルの選択がセキュリティ設計を決める

MQTTとCoAP——用途の本質的な違い

IoTネットワークにおいて、プロトコル選択は「遅延・省電力・信頼性・セキュリティ終端位置」を一度に決定づける設計判断だ。

MQTTは、軽量なpublish/subscribeモデルで標準化されており、QoS(少なくとも一度等)による配信保証の段階を持つ。典型的なトポロジーはブローカー中心であり、中央集権型のイベント集約と相性が良い。セキュリティの観点では、TLS終端がブローカーやゲートウェイで行われることが多く、端末からブローカーまでの区間が暗号化の境界になりやすい。クラウド側ではAWS IoT CoreがMQTT接続を明示的にサポートしており、Azure IoT HubもMQTT/AMQP/HTTPSを併用する構成を推奨している。

CoAPは、制約環境向けのREST系転送プロトコルで、UDPなど軽量トランスポートを前提に設計されている。ObserveやBlock-Wise転送、アプリ層暗号(OSCORE)などの拡張がRFCとして整備されており、E2E(エンドツーエンド)暗号保護の設計が可能な点が大きな特徴だ。ゲートウェイが復号できないため、中継経路での盗聴リスクを下げられるが、運用上は「どこが復号できるか」を明示した設計が必要になる。

LoRaWANは、バッテリー駆動端末を想定した低消費電力広域ネットワーク(LPWAN)で、スマートシティや広域計測に多用される。端末→ゲートウェイ→ネットワークサーバという「スター・オブ・スターズ」型のトポロジーが標準で、仕様と認証がLoRa Allianceにより管理されている。

IoTセキュリティの構造的課題とラベリング制度

IoTが抱える本質的なリスクは、(1) 膨大な端末数、(2) 長寿命かつ更新が困難、(3) 初期設定不備(既定パスワード等)という三つの構造的要因に集約される。2016年のMiraiボットネット事件は、これを象徴するケースだ。既定認証情報等で侵害されたIoT機器が、DNS事業者Dynへの大規模DDoSに悪用され、社会インフラ級のサービス障害へ波及した。「端末側の最小要件が欠けると連鎖崩壊が起きる」という教訓は、今も有効だ。

この課題への制度的対応として、日本では情報処理推進機構がIoT製品のセキュリティ機能を可視化する**JC-STAR(IoTセキュリティ・ラベリング)**を制度化している。欧州でも民生IoTのベースライン規格(ETSI EN 303 645)が改版され、設計段階の欠陥(更新機能、脆弱性報告、既定パスワード等)に焦点を当てる。調達要件への組み込みと、SBOM(ソフトウェア部品表)による継続的な可視化が、次のフェーズとして求められている。

ロボティクスにおける安全とセキュリティの「連成」

産業用・協働・自律移動——用途別の安全規格

ロボティクスは用途によって要求特性が大きく異なる。産業用ロボットの設計安全(ISO 10218)、人との協働運用(ISO/TS 15066)、無人搬送(ISO 3691-4)など、それぞれの領域に安全規格が整備されている。さらに近年では、サービス事業者がロボットサービスを提供する際の「運用者要件」を定めた国際規格が公表されるなど、製造者責任だけでなく運用側の責任が前面化しつつある。

制御アーキテクチャの設計思想として注目されているのが、**Behavior Tree(ビヘイビアツリー)**だ。反応性とモジュール性を両立するこのアプローチは、「LLMによる高レベルの計画」と「ロボット制御の低レベル実行(リアルタイム制約)」を明確に分離する安全弁として再評価されている。LLMを上位層に置くアーキテクチャでは、この境界設計が安全の根拠になる。

OT環境へのサイバー脅威——TRITONが示す連成リスク

2017年に明らかになったTRITON/Trisisは、産業安全計装システム(SIS)を直接標的にしたマルウェアだ。サイバー侵害が安全機能そのものに干渉し得ることを示した事例であり、FBI等は重要インフラへの継続的な脅威として注意喚起を続けている。

このケースが示す教訓は、「ロボット・OTの安全は、もはや物理的な機構設計だけで保証できない」という点だ。IEC 62443(産業用自動化・制御システムのセキュリティ標準)への準拠、ネットワークセグメンテーション、そしてROS 2向けのSROS2(DDS-Securityを活用したセキュア通信)の導入が、「サイバー・フィジカル複合リスク」への実務的回答となる。ロボット導入は「機械安全+サイバー安全+運用教育」の束として設計する必要がある。

LLMの統合設計——「推論配置」と「ツール実行の権限管理」

クラウド・エッジ・ハイブリッドの三類型

LLM統合の本質は、モデルの賢さよりも、(a) 推論をどこに配置するか、(b) 外部ツールをどう実行するか、(c) 会話状態と監査ログをどう保持するか、という設計にある。

- クラウド集中型:高性能・統制が容易だが、レイテンシ・データ主権・依存リスクが課題になる

- エッジ分散型:低遅延・データ最小化が可能だが、モデル更新と評価が難しい

- ハイブリッド型:エッジが即応・安全対応を担い、クラウドが計画・学習を担う分業構造

ETSI(欧州電気通信標準化機構)が提示するMEC(Multi-access Edge Computing)参照アーキテクチャや、OpenAI/Azure OpenAIのストリーミング/WebSocket設計は、このハイブリッド収斂を後押しする技術基盤となっている。オンプレ志向ではvLLMがOpenAI互換サーバを提供し、既存クライアントを流用しながら自前モデルをサーブする形が現実的な選択肢になっている。

LLMのツール呼び出しが生む「新しい特権主体」

LLMがロボット操作APIや端末状態の問い合わせを実行できる場合、それは単なる対話UIではなく特権操作を行う準自治的アクターになる。OWASPが整理する「LLMアプリケーションTop 10」では、Prompt Injection(プロンプト注入)、Insecure Output Handling(出力処理不備)、Supply Chain(サプライチェーン)などが主要リスクとして挙げられている。

実務的な対策として求められるのは、(1) ツール権限の最小化、(2) スキーマ検証による入出力の正規化、(3) 高リスク操作への二重承認、(4) 監査ログの保持——の四点だ。Anthropicが公式仕様としてtool use(ツール使用)のストリーミングとイベント構造を詳細に記述しているように、この「イベント列」を運用統制のポイントとして設計することが重要になる。

ネットワークトポロジーと相互運用性——三類型の比較

中央集権・分散・ハイブリッドの設計判断

「非人間アクターの連合」が大規模化した場合、ネットワーク構造の選択は責任・安全・意味を運ぶ制度的インフラの設計問題になる。

| 類型 | 長所 | 主な弱点 |

|---|---|---|

| 中央集権(プラットフォーム型) | 統制・監査・更新が容易 | 単一障害点、攻撃集中 |

| 分散(ピア協調型) | 低遅延・耐障害性 | 説明責任の分散、整合性の困難 |

| ハイブリッド(階層・フェデレーション型) | 実時間性と統制の両立 | 境界設計の複雑化 |

実務では、ハイブリッドを基本形として「安全に関わる制御は現場で閉じる」「学習・計画・分析は上位で集約する」分業を採る設計が増えている。これは、中央集権の管理性と分散のレジリエンスを使い分けることで、攻撃集中リスクと説明責任の両方に対応しようとするアプローチだ。

意味論相互運用性——LLMが「文脈を理解できる」設計

相互運用性は「通信できる」だけでは不十分だ。少なくともプロトコル・API・意味論の三層が必要になる。

特に重要なのが意味論層だ。LLMが「どのセンサーが何を意味し、どのアクチュエータにどの制約があるか」を理解するためには、デジタルツインの語彙と関係が共有されている必要がある。W3C WoT(Web of Things)のThing Description、Microsoft DTDLやOPC UA情報モデル、oneM2Mサービス層——これらは「LLMが参照できる辞書」として機能し、デジタルツイン仕様の整備はLLM統合の実装条件に変わりつつある。

倫理・法規制・ガバナンス——EU AI ActとJC-STARの実務的含意

EU AI Actの段階適用と変動リスク

EU AI Act(Regulation (EU) 2024/1689)が公式に公布され、AIをリスク区分し義務を課す枠組みが確立した。禁止事項・AIリテラシー義務から始まり、一般目的AI(GPAI)、ハイリスクAIへの義務が段階的に適用される設計だ。

ただし、2026年3月時点で欧州議会が一部適用期限の延期や新たな禁止項目の追加を支持する動きも出ており、規制の適用タイムラインは政治プロセスによって変動し得る。企業は「固定日付での対応」ではなく、「適用条項×製品機能×監査ログ」でトレーサブルに管理する体制が求められる。

日本のガバナンス整備——AI事業者ガイドラインとJC-STAR

国内では、経済産業省・総務省のAI事業者ガイドラインが「開発・提供・利用」の三者視点を統合し、説明責任・リスクベース・調達要件の整備を進めている。IoT製品については、JC-STARが段階拡張(★2以上等)を予定しており、政府調達と連動した市場可視化の仕組みとして機能しつつある。

また、個人情報保護委員会が生成AIサービス利用に関して注意喚起を行っているように、個人情報・機密情報の投入、利用目的、提供先の管理は実務課題として継続する。

統合アーキテクチャ提案——LLMは「直接制御しない」設計が原則

三層分離によるリスク低減

現実に実装可能な統合アーキテクチャの核心は、LLMが物理実行を直接制御しないという設計原則にある。

- フィールド層:IoTセンサー・アクチュエータ・ロボが存在し、MQTT/CoAP/LoRaWAN/ROS2/DDS/OPC UAでデータを送受信する

- エッジ/ゲートウェイ層:プロトコル変換・集約、デジタルツイン/意味モデル(WoT TD/DTDL/OPC UA)の管理、リアルタイム制御層と安全境界(ポリシー強制/レート制御/署名検証)を担う

- クラウド/データ&AI層:LLMサービス(クラウド/オンプレ/ハイブリッド)、オーケストレーション(ツール呼び出し/ワークフロー)、監査・ガバナンス(ログ/モデル管理/リスク管理)が集約される

LLMは「計画・説明・問い合わせ」を担い、物理実行は安全境界内の制御層が引き受ける。ロボットの安全停止・速度監視・フェイルセーフなどは、LLMから切り離されたRuntime Assurance層で保証される設計が理想だ。

実装ロードマップの考え方

現実的な実装は段階的に進める必要がある。

**短期(2026年)**では、現状の資産・プロトコル・データの棚卸しと端末ベースライン導入(IoT要件/ラベル活用)を優先する。LLMの活用は非制御領域(文書生成・問い合わせ対応等)のPoCから始める。

**中期(2026〜2027年)**では、ゲートウェイによるMQTT/CoAP/HTTP統合、監査ログと会話状態管理の整備、ツール呼び出しの権限制御を実装する。デジタルツインの語彙標準化(WoT/DTDL/OPC UA)とロボットOTのセグメンテーション(IEC 62443整合)も並行して進める。

**長期(2028年以降)**では、ハイブリッド推論(エッジLLM+クラウドLLM)の本格稼働と、AI RMF/ISO 42001による継続評価体制、インシデント対応訓練と第三者評価の統合が目標になる。

まとめ——「技術選択」が「責任配分」を形作る時代

IoT・ロボティクス・LLMの統合は、単なるシステム連携ではなく、「相互依存するアクター集合のガバナンス設計問題」だ。プロトコルの選択(MQTTかCoAPか、E2E暗号かゲートウェイ終端か)、LLMへの権限付与範囲、安全境界の位置——これらの技術的判断が、そのまま事故時の帰責構造と規制適合の質を決める。

Miraiが示したIoTの量的攻撃面、TRITONが示した安全とセキュリティの連成リスク、LLMツール呼び出しが生む新しい特権主体——これらは個別に対処するのではなく、連合としての統合脅威モデルとして設計しなければならない。

「非人間アクターの連合」が社会インフラへ組み込まれていく過程で、技術選択と制度設計の一体化がますます求められる。

コメント