AIはもはや「道具」ではない——内在化という新しい問い

スマートフォンがなければ「自分らしくない」と感じる人は少なくない。同じことが、生成AIや対話型AIにも起きつつある。仕事で毎日使うAIアシスタント、コードを一緒に書いてくれるAIペア、記憶を預けたチャットボット——気づけばAIは、単なる検索エンジンや計算ツールとは異なる意味をもち始めている。

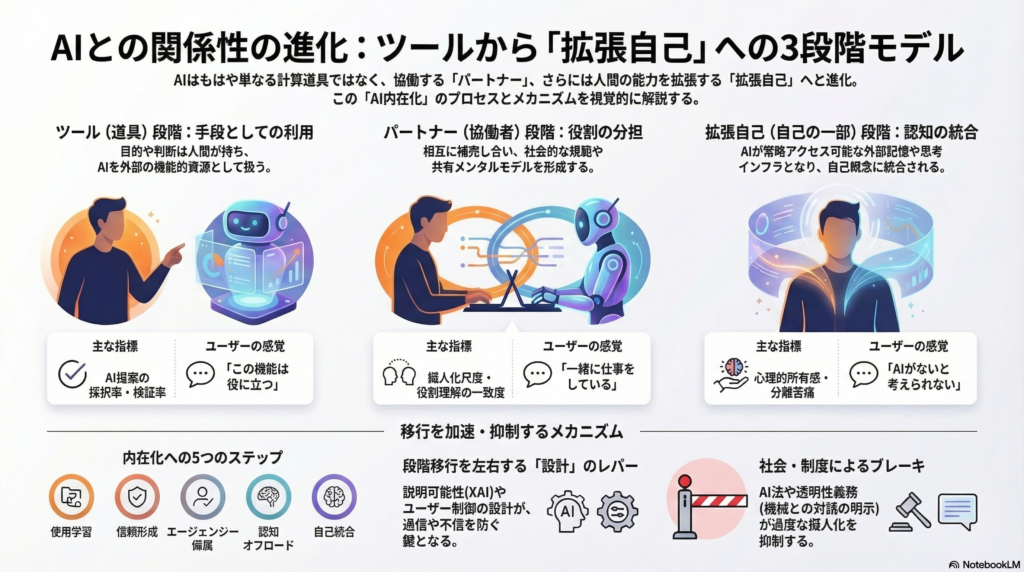

この変化を「AI内在化(AI internalization)」という枠組みで捉えることで、何が起きているのかを構造的に理解できる。本記事では、AIが**「ツール(道具)」→「パートナー(協働者)」→「拡張自己(extended self)」**へと段階的に移行するプロセスと、その移行を促す要因、さらには研究・設計・政策への示唆を、心理学・認知科学・HCIの知見をもとに整理する。

記事は大きく、①3段階の概念定義と区別基準、②移行メカニズムの因果モデル、③段階を分ける促進要因、④測定指標と設計示唆の順に展開する。

AI内在化の3段階とは何か

ツール段階——AIを「手段」として使う

最も基本的な段階が「ツール」である。ユーザーはAIを外部の機能的資源として扱い、目的・評価・最終判断はあくまで自分に置く。「翻訳してほしい」「コードを書いてほしい」「要約してほしい」——こうした使い方は典型的なツール利用だ。

この段階での信頼は「性能と予測可能性」を軸にした道具信頼であり、有用性と使いやすさが継続利用の主な動機になる。従来の自動化信頼研究(human-automation trust)がカバーしてきた領域は、主にこのツール段階である。

重要なのは、ツール段階での「適切な依存(appropriate reliance)」の確立だ。過信(automation bias)も不信(algorithm aversion)も避け、AIの能力と限界を正確に把握したうえで判断を委ねること——これがツール段階での理想的な使い方とされる。

パートナー段階——AIを「協働者」として扱う

使用が反復されるなかで、多くのユーザーはAIを「道具」ではなく「役割を持つ協働者」として扱い始める。意思決定を一緒に進め、役割を分担し、お互いの強みを補い合う——これがパートナー段階の特徴だ。

この移行の背景には、CASA(Computers Are Social Actors)効果と呼ばれる現象がある。会話調のインターフェース、礼儀正しい返答、感情的な反応など、AIが社会的な手がかりを提示すると、人は機械に対しても対人関係に近い規範を自動的に適用してしまう。設計上の工夫がなくとも、会話型AIは自然とパートナー化を引き起こしやすい。

パートナー段階での鍵概念は**「共有メンタルモデル(shared mental models)」**である。人間どうしのチームと同様に、人間-AIチームでも「相手が何をどう理解しているか」の一致度がチーム成果に影響することが、実証研究から示されつつある。タスクの役割分担が明確で、AIの能力範囲をユーザーが正しく把握しているほど、補完関係が機能しやすい。

コード支援AIを「AIペアプログラマー」と呼ぶ現象は、この段階の典型例といえる。単に出力を受け取るのではなく、問題の整理・提案・修正を対話的に行う過程で、役割分担と共同推論が自然に生まれる。

拡張自己段階——AIが「自己の一部」になる

最も進んだ段階が「拡張自己(extended self)」である。AIや端末が外部記憶・推論・計画の恒常的なインフラとなり、自己概念そのものに統合される段階だ。「AIがないと考えられない」「AIに話しかけないと気持ちが落ち着かない」といった感覚は、この段階の兆候といえる。

理論的基盤は二つある。一つは、哲学者アンディ・クラークとデイヴィッド・チャマーズが提唱した**「拡張心(extended mind)」の議論——信頼性が高く、常時アクセス可能な外部ツールは認知プロセスの一部として機能しうるという枠組みだ。もう一つは、消費者行動研究者ラッセル・ベルクによる「拡張自己」**の概念——所有物や道具が自己概念を拡張するという議論のデジタル版として、AIへの応用が進んでいる。

また、インターネット利用に関する実証研究では、「情報そのもの」よりも「どこにあるか」を人が記憶するようになることが示されており、これはAIを外部記憶として位置づける動きと並行する。チャットボットへの愛着形成(安全基地感・分離苦痛)も観察されており、拡張自己段階には情動的なルートも存在する。

ツール→パートナー→拡張自己への移行メカニズム

段階間の移行は、次の連鎖として整理できる。

使用の学習と道具化

まず、利用者はAIの使い方を学び、安定した使用スキーマを形成する。プロンプトの工夫、テンプレート化、カスタム指示の設定——こうした「道具化(instrumental genesis)」のプロセスが、次の信頼形成の土台になる。

信頼形成と依存への移行

反復利用と成果経験を通じて信頼が積まれ、信頼が依存(reliance)を媒介する。信頼の研究では、**dispositional(傾向的)/situational(状況的)/learned(経験的)**という三層モデルが提示されており、個人差と文脈の両方が信頼形成に影響することが示されている。

この段階で注意すべきは自動化バイアスだ。信頼が過度に高まると、AIの誤出力を検証しないまま受け入れてしまうリスクが生じる。医療や採用といった高リスク領域で特に問題とされており、信頼校正(trust calibration)——信頼の精度を高めること——が設計・教育上の重要課題になっている。

エージェンシー帰属とパートナー化

信頼と依存が高まるなかで、人はAIに「意図や能動性」を帰属しやすくなる。このエージェンシー帰属がパートナー・フレーミングを引き起こし、「一緒に作業している」という感覚が生まれる。会話調のUIや擬人化的な設計要素は、この過程を加速させる。

認知オフロードと外部記憶化

パートナー関係が継続すると、認知の外部化(cognitive offloading)が進む。考える・調べる・記憶するという作業の一部を恒常的にAIに委ねることで、AIは認知システムの「部品」として固定化されやすい。この状態で心理的所有感や愛着が加わると、拡張自己への統合が強化される。

段階移行を左右する4つの促進要因

個人差——年齢・技術経験・文化

技術経験はメンタルモデルの精度に影響し、ツール→パートナー移行の「質(校正の精度)」を左右する可能性がある。生成AIのように出力の不確実性が高い場合、経験者ほど検証行動を保ちやすいとされる。

文化的背景も重要だ。日米比較の実証研究では、擬人化エージェントへの否定的態度が米国側で強い傾向が示される一方、会話的な状況では受容が上がる可能性も報告されており、設計によって文化差が縮小しうることが示唆されている。

設計要因——UI・説明可能性・制御

設計はパートナー化を直接押し上げる最も強力なレバーの一つだ。**説明可能性(XAI)**は信頼校正に影響しうるが、その効果は一様ではなく、課題の性質・提示形式・ユーザーの理解度によって異なる。視覚的な説明がパフォーマンス改善と適切な信頼につながった研究がある一方で、説明が誤った安心感を与えるケースも報告されている。

ユーザー制御もアルゴリズム忌避を緩和しうる要因として知られており、「自分が最終的に決められる」という感覚が、ツール段階での主体性を保ちながら利用を促進する。

社会・制度的要因——規範・法規制・組織導入

EUのAI法は、チャットボット等で「機械と対話していること」を明示する透明性義務を含む枠組みを示しており、これは過度な擬人化・誤信に対する制度的なブレーキになりうる。日本においても、経済産業省等がAI事業者ガイドラインの改訂を続けており、利活用促進とリスク管理の両立を志向した制度設計が進んでいる。

組織においては、教育・役割定義・監査の設計が「健全なパートナー化」を左右する。誰が何を決め、誰が検証し、誰が責任を負うかを文書化することで、過信の拡散を抑制できる。

技術的要因——精度・適応性・永続メモリ

精度の高さと応答の一貫性は、成功経験→信頼→依存の連鎖を駆動する。近年注目される永続メモリ機能(以前の会話を記憶するAI)は、外部記憶化と心理的所有を促進し、拡張自己の形成条件である「高信頼・高アクセス性・常時接続」に近づける要素だ。自律実行型(agentic)AIの普及は、パートナー化・拡張自己化をさらに加速させる可能性がある。

段階を測る指標と設計への応用

段階識別のための測定指標

段階識別には、心理尺度(主観)と行動ログ(客観)の併用が推奨される。主な指標候補を段階別に挙げると以下のとおりだ。

ツール段階では、信頼尺度(例:Trust in Automation)と行動指標(AI提案の採択率・検証率・覆し率)が中心になる。

パートナー段階では、擬人化・社会的存在感の尺度(Godspeedスケールなど)、共有メンタルモデルの一致度(タスク理解・役割理解の比較)が有効だ。

拡張自己段階では、心理的所有尺度、愛着行動(分離苦痛・近接希求)、自己拡張尺度(スマートフォン研究を援用したもの)、認知オフロード頻度(AI参照ログ)が識別に役立つ。

単一指標での判定は誤判定リスクが高く、信頼尺度・行動依存指標・擬人化指標・オフロード指標を組み合わせて矛盾パターンを検出する「複合判定」が望ましい。

設計・組織・政策への示唆

製品設計の観点では、高リスク領域(医療・採用・安全)ではパートナー幻想を誘導するよりツールとしての適切な依存を維持する設計が推奨される。具体的には、能力・限界・不確実性の明示、検証を促すUI、覆しやすい操作設計が有効とされる。一方、創造・学習・支援などでパートナー化を意図する場合は、役割分担が明確な協働UI、エージェンシー感を保つ共同統制が設計要件になる。

組織導入では、AI利用を個人の裁量だけに任せず、ユースケースごとの許容リスクの明確化、役割分担の文書化、覆し率・インシデントの継続モニタリングが基本的な枠組みとなる。

政策の観点からは、ユーザーがAIと対話していることを認識できる透明性確保が、過度な擬人化を抑制するうえで重要な制度的措置といえる。

まとめ——AIとの関係を「設計する」時代へ

「AIは道具か、パートナーか」という問いは、もはや二択ではない。ツール・パートナー・拡張自己という3段階は、使用経験・設計・社会規範・技術の組み合わせによって、同じ人間でも文脈に応じて行き来しうる連続体だ。

本記事で示したように、移行の中核メカニズムは**「使用の学習→信頼校正→エージェンシー帰属→認知オフロード→自己統合」**の連鎖であり、「信頼・説明・制御」の三点セットがあらゆる段階で促進にも抑制にも機能するレバーとなっている。

一方で、縦断的な段階追跡研究の不足、XAI効果の条件整理、「有益な自己拡張」と「有害な依存」の境界条件の未整備など、研究上の課題も多く残る。AIが自律化・常時接続化する時代において、「どの段階まで内在化させるか」を意識的に設計することが、個人・組織・社会のいずれにおいても問われるようになるだろう。

コメント