なぜ今、協働学習のAI設計が問われるのか

オンライン学習が急速に普及する中、「AIを導入すれば学習が改善される」という単純な期待が広がっています。しかし実際には、AIの効果は教材品質だけでなく、学習者同士の社会的・認知的・教育的なやりとり——いわゆる「プレゼンス」——の質に強く依存することが、学習科学の研究から明らかになっています。

とりわけ成人学習者を対象とした中規模のオンライン協働学習(20〜100名規模)では、グループの調整力や対話の深さが成果を左右します。この文脈でAIをどう設計に組み込むかは、今や教育現場の実務的な課題です。

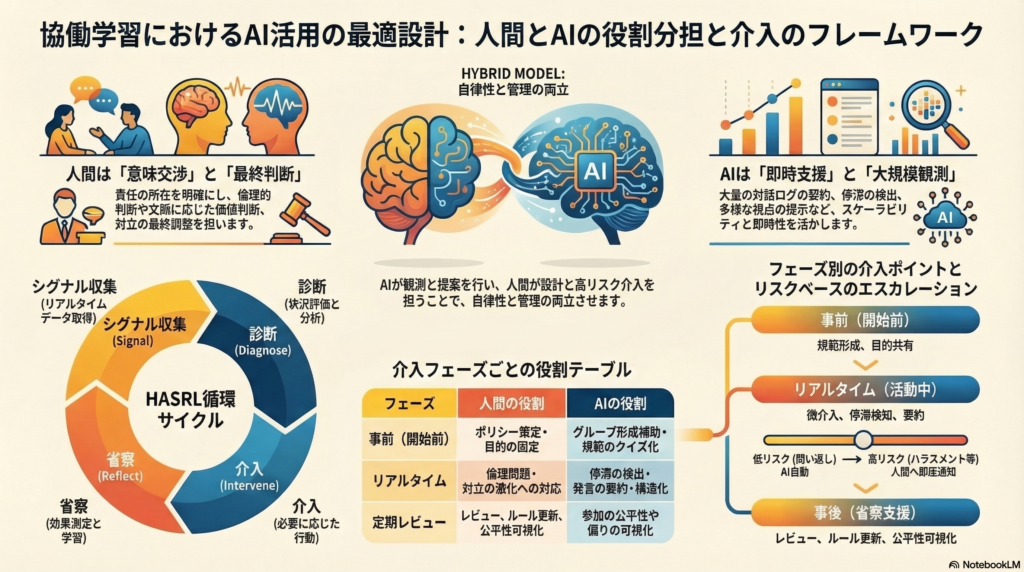

本記事では、人間(学習者・ファシリテータ)とAI(支援エージェント・自動フィードバック)が共存する協働学習コミュニティにおいて、「誰が何を担うか(役割配分)」と「いつ介入するか(介入タイミング)」をどう設計すべきかを、最新の研究知見と実践的な枠組みをもとに解説します。

協働学習に必要な4つの機能領域と各アクターの役割

協働学習を支える機能を分解する

協働学習コミュニティを設計するうえで、まず必要なのは「何が起きていなければならないか」を機能レベルで整理することです。研究知見をもとに整理すると、主に以下の4つの機能領域に分解できます。

① 認知的機能:知識の構築、説明、批判的検討

② メタ認知・調整機能:目標設定、進捗モニタリング、方略の変更

③ 社会的相互作用機能:合意形成、関係構築、対立の調整

④ 評価・フィードバック機能:形成的な改善提案、ルーブリックに沿った評価補助

これらの機能のうち、どれを人間が担い、どれをAIが担うかは「アクターの強み」に応じて配分するのが合理的です。

各アクターの強みとリスク

学習者(人間) は意味交渉や価値判断、文脈の共有、そして責任ある合意形成に強みを持ちます。一方で、フリーライドや発言の偏り、同調圧力といったリスクも生じやすいです。

ファシリテータ(人間) は目的設定、学術的誠実性の担保、最終判断という「責任の固定」に欠かせない存在です。ただし、複数グループを同時に監視するオーケストレーション負荷が高くなりやすく、介入が遅れるリスクがあります。

AI支援エージェント(対話・介入) はスケール、即時性、多様な視点の提示、言語処理(要約・構造化)に優れています。しかし誤情報の生成、認知過負荷、学習者の過度依存といったリスクを内包します。

AI自動フィードバック(分析・ダッシュボード) は継続的な観測、トリガ(異常)の検出、可視化によるファシリテータの意思決定支援に強みを発揮します。ブラックボックス化やプライバシー侵害のリスクには注意が必要です。

ハイブリッドモデルが「最も汎用的に強い設計」とされる理由

3つの設計パターンの比較

役割配分の設計パターンは大きく3つに分類できます。

AI主導モデル は大規模対応と教員負荷軽減に優れますが、誤情報・過度依存・責任境界の曖昧化といったリスクが高くなります。低ステーク(練習・演習)かつ強固なガードレールとログ監査が可能な場合に限定して適用するのが現実的です。

ファシリテータ主導モデル は信頼性・倫理性の確保に向いており、機微情報や高ステーク(成績配点が大きい、臨床・法・研究倫理が絡むテーマ)の文脈で推奨されます。ただし監視負荷が高く、介入遅延が起きやすいという課題があります。

ハイブリッドモデル は、AIが観測・提案・低リスク介入を担い、人間が設計・最終判断・高リスク介入を担う形です。学習者の自律性とスケールを両立でき、責任の所在が明確に保たれます。実装事例も最も多く、「AIが制御を共有しても、教室内の行為責任は人間に残る」という原則を明文化した設計が実現しやすいのが特長です。

ハイブリッドモデルを支持する3つの根拠

第一に、協働学習の成功には**社会的に共有された調整(SSRL)**が不可欠であり、AIは「検出・診断支援」、人間は「目的・価値・関係調整」という分担が自然に成り立ちます。

第二に、Lawrenceら(2024)によるPair-Upシステムの研究など、「AIが推薦し、人間が最終決定する」shared controlの実装事例が、実際に機能することを示しています。

第三に、Zhangら(2026)のプログラミング授業での実装研究では、教員がAIのフィードバックモードをリアルタイムで切替できる設計(technical/heuristic/automatic/silent)が、過度依存を防ぎつつ支援を提供できることを示しています。これは「介入レバー」を人間側に確保するという原則の実装例です。

介入タイミングの設計:トリガ駆動と定期点検のハイブリッド

なぜ「いつ介入するか」が重要なのか

介入のタイミングは、学習成果と学習者の自律性の両方に大きく影響します。介入が早すぎれば自律性が育たず、遅すぎれば学習の停滞・関係悪化・誤情報拡散といった「崩壊」を招きます。

この問題に対して有効なのが、HASRLモデル(Human–AI Shared Regulation in Learning) の枠組みです。シグナル収集→トリガ検出→診断→介入→省察という循環として協働学習プロセスを捉え、人間とAIの役割分担を各フェーズに対応させます。

介入フェーズ別の設計指針

事前(開始前) では、目的・ルーブリック・規範の共有とグループ形成が中心です。AIによるグループ候補の複数提示や規範クイズ化が有効で、人間(ファシリテータ)はAI利用方針を含めた授業ポリシーを明示します。方針が曖昧なまま始まると、不正・依存・混乱が増える可能性があります。

開始直後(キックオフ) では、共同理解形成(タスク理解・役割・進め方)が目的です。AIは役割確認チェックや合意形成を促す問いを提示し、人間は短く期待値を固定します。初期の合意は後のSSRLを大きく規定するため、このフェーズへの投資は費用対効果が高いと言えます。

リアルタイム(活動中) では、破綻回避とSSRL促進のための微介入が中心です。停滞(沈黙・同語反復)、支配的参加、誤情報の兆候、AIへの丸投げを「トリガ」として設定し、AIは低リスクの問い返しや要約・ターンテイキング促進を担います。対立の激化・倫理問題・成績関連は人間にエスカレートします。注意すべき点は、学習者とAIとの相互作用そのものも監視対象に含めることです。

直後(セッション直後) では省察と形成的フィードバックが目的です。AIによる議論ログの要約・未解決論点の抽出が有効ですが、フィードバックの「出所説明」を行うことが受容度を高める可能性があります。

定期レビュー(週次/隔週) では継続改善とガバナンスが目的です。ダッシュボードで公平性・参加の偏りを可視化し、AIが改善案を提示、人間がルール更新や脚本修正を判断します。リスク管理は継続的・タイムリーに行う必要があります。

緊急(セーフティ介入) では、ハラスメント・差別・個人情報漏えいなどへの対応が必要です。AIによる自動フラグと入力抑止・ログ保全を備え、人間が事実確認と教育的措置を担います。

実験設計と評価指標:何をどう測るか

検証可能な設計案の要点

役割配分と介入タイミングの効果を実証するには、単なる定性評価では不十分です。推奨されるアプローチは、グループ単位のランダム化と、ログ・成果物・サーベイ・質的データを組み合わせた混合研究法です。

代表的な検証テーマとして以下が挙げられます。

- 介入タイミング比較(リアルタイム微介入 vs. 直後省察中心):認知的エンゲージメントへの影響と成果物改善の関係

- グループ形成のshared control検証(手動 vs. AI自動 vs. AI推薦+人間承認):協働の安定性・公平性・教師負荷への影響

- 学習者–AI相互作用の監視と過度依存抑制:教員がAIのモードを切替可能にすることで、学習成果を維持しつつ依存を抑えられるかの検証

多次元で評価指標を設定する

評価は「学習成果」だけを見るのでは不十分です。以下の次元を組み合わせた多面的な評価設計が求められます。

- 学習成果:概念理解テスト、成果物のルーブリック評価

- 協働の質:参加の公平性、相互説明の有無、ネットワーク分析

- SSRL/自己調整:目標設定・モニタリング行動の質、振り返り記述

- エンゲージメント:認知的・情動的・行動的エンゲージメントの各側面

- 説明可能性・信頼:AI提案への理解度、異議申し立て可能感

- 倫理・公平性:属性別の不利益分布、差別的出力の監査、プライバシーインシデントの記録

実装で必ず押さえたい5つの課題

① プライバシーとデータ設計

学習ログや対話ログはセンシティブな情報になりやすく、生成AIでは入力内容が保存・再利用される可能性があります。データ最小化・個人情報の入力抑止UI・保存期間と削除手順の明文化・学習分析の匿名化が基本対策です。

② 説明可能性とアカウンタビリティ

AIの推薦(ペアリング・介入・評価補助)が妥当かどうかを人間が判断できなければ、採用されないか、逆に盲従が起きます。フィードバックの出所・特性を提示するUI設計が、知覚される公平性・信頼に影響する可能性があります。

③ バイアスと公平性の監視

参加の偏り・言語能力差・障害や文化差・AI利用経験差は、協働の不利に直結します。介入の効果は「平均」ではなく「分布(誰が不利か)」で監視する必要があります。

④ スケーラビリティと運用コスト

高頻度のリアルタイム介入は費用・負荷の観点から限定的に運用し、直後・定期レビューを厚くする階層設計が現実的です。高リスクのみ人間にエスカレートする仕組みが、持続可能な運用を可能にします。

⑤ 過度依存とガバナンス

生成AIの即答性は便利な反面、批判的思考の弱化や受動化のリスクがあります。AIの介入モードを人間が切替可能にする設計と、学内のAI利用ポリシー(許可範囲・引用・評価との関係)の明文化が過度依存抑制の鍵となります。国際的にはUNESCOの人間中心アプローチ、NISTのAI RMF、OECDのAI原則が参照枠として有用です。

まとめ:設計の「共通言語」としてHASRLを活用する

本記事の要点を整理します。

- 協働学習でのAI活用に最も汎用性が高い設計は、「ハイブリッドモデル(人間主導の意思決定+AIによる観測・提案・低リスク介入)」 です。

- 介入タイミングは固定スケジュールとトリガ駆動のハイブリッドにすることで、過介入と放置の両方を避けやすくなります。

- HASRL(シグナル→検出→診断→介入→省察)の循環を設計の共通言語として採用することで、人間とAIの協働点が明確になります。

- 評価は学習成果だけでなく、協働の質・公平性・説明可能性・倫理性を多次元で測定する設計が必要です。

- 実装課題(プライバシー・バイアス・過度依存・コスト)には、設計段階から対策を組み込む必要があります。

AIを「単なる便利ツール」ではなく「協働学習コミュニティの設計要素」として捉え直すことが、質の高い学習体験を実現する第一歩です。

コメント