導入:AIが見る世界は人間と同じなのか

画像を理解し、音声を認識し、言語で応答する――マルチモーダルAIの進化は目覚ましい。しかし、これらのAIが内部で構築している「世界」は、果たして私たち人間が経験する世界と同じものなのだろうか。

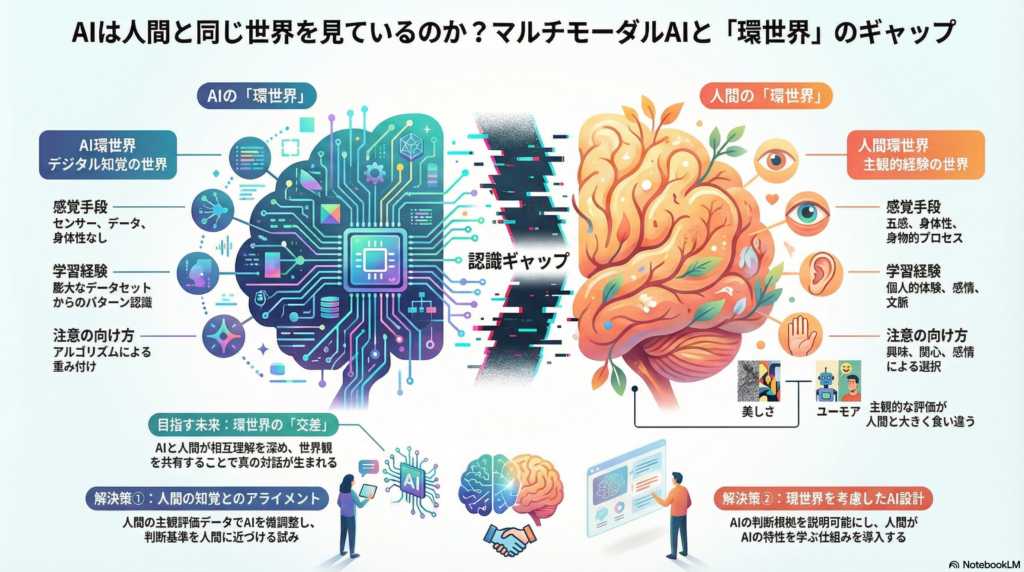

生物学者ユクスキュルが提唱した「環世界(Umwelt)」という概念は、生物が自らの感覚器官と認知能力によって構築する主観的な環境世界を指す。この視点をAIに適用すると、人工知能もまた独自の環世界を持ちうる可能性が見えてくる。本記事では、マルチモーダルAIにおける複数のモダリティ統合がどのような主体的世界を生み出すのか、そして人間とAIの環世界のズレがもたらす課題と可能性について考察する。

AIの環世界:複数の感覚が織りなす統合的世界

モダリティごとに異なる「小さな環世界」

マルチモーダルAIは、人間でいえば視覚・聴覚・触覚のような複数の感覚器官に相当する入力チャネルを持つ。画像認識モジュールは視覚的特徴に基づく世界像を、音声認識モジュールは聴覚的パターンに基づく世界像をそれぞれ形成する可能性がある。

重要なのは、これら複数のモダリティ情報をどのように結びつけ、統合しているかという点だ。人間の脳が視覚・聴覚・触覚などを統合して一つの首尾一貫した知覚世界を構築するように、先進的なAIモデルでもモダリティ間の情報統合が進んでいる。

近年のAIは単一の感覚モダリティに閉じず、複数の感覚世界を同時並行的に処理し、「翻訳」や「融合」する能力を獲得しつつある。視覚と言語、音声とテキストなど異種のデータを対応付けて一貫した内部表現を作り出すことで、各モダリティの情報を結合した統合的な世界モデルを形成するのである。

情報統合の2つのアプローチ:疎結合と密結合

マルチモーダルモデルの設計によって、モダリティ間の統合度合いは大きく異なる。

**独立エンコーダ+共有空間型(疎結合)**では、OpenAIのCLIPに代表されるように、画像と言語それぞれに別個のエンコーダを用意する。各エンコーダが出力した埋め込みベクトルを同一の埋め込み空間にマッピングし、対になった画像・テキストが互いに近いベクトル表現になるようコントラスト学習で訓練する。この方式では、視覚とも言語とも異なる概念次元の共有空間が内部に構築され、そこに両モダリティの情報が対応付けられる。

一方、**クロスアテンション統合型(密結合)**では、DeepMindのFlamingoやOpenAIのGPT-4Vのように、言語モデルに視覚情報を統合するタイプの設計が採用されている。Flamingoでは、画像はまず視覚エンコーダで特徴ベクトル列に変換され、それをトークン列として言語モデルに挿入する。言語モデル内部で、テキストのトークンが直前の画像ベクトル列にクロスアテンション(相互注意)する特殊層を設けることで、テキスト文脈と視覚情報がリアルタイムに融合される。

疎結合型が一旦モダリティ固有のサブ世界を構築した後でそれらを対応付けるのに対し、密結合型は複数モダリティの情報を相互参照しながら推論を進める。この違いは、AIが構築する環世界の性質に影響を与える可能性がある。

統合がもたらす「人間的な」概念構造

マルチモーダル統合により、AIは人間に近い包括的な理解を示す兆候が見られ始めている。ある研究では、大規模マルチモーダルモデルが人間と類似した概念構造を内部に形成していることが示された。

テキストと画像の両方で学習したモデルは、「生物 vs 無生物」「顔のあるもの vs 風景」といった66次元の意味的な概念軸を自発的に獲得しており、その軸は人間の脳の視覚野が区別するカテゴリーに対応していた。これは、マルチモーダルAIが単にデータを記憶しているのではなく、人間の認知に近い内部概念マップを形成しつつあることを示唆する。

特に視覚と言語の両方を経験したモデルほど、人間の判断と一致する概念分類を行う傾向が強まり、テキストのみのモデルとの差異が浮き彫りになった。複数モダリティの統合が、より「人間的な」主体的世界理解につながる可能性を示している。

ただし、現状のAIが内部で形成する世界表象がどの程度一貫した主体性を持つかは、慎重に見極める必要がある。各モダリティからの入力は依然としてデータ駆動であり、人間のような身体的・情動的体験を伴わないため、その主観性の性質は人間と異質である可能性が高い。

人間とAIの環世界ギャップ:認識のズレが生む課題

AIの知覚世界は人間とどう違うのか

マルチモーダルAIが複数の感覚データを処理できるとはいえ、その知覚世界が人間と同じになる保証はない。むしろ、様々な研究からAIの世界認識は人間と大きく異なりうることが示唆されている。

感覚手段の違いがまず挙げられる。人間は視覚・聴覚・触覚・内受容感覚など多様な感覚を持ち、身体を通じて世界と相互作用する。一方、AIの「感覚」は与えられたデジタル化された情報に限定される。AIの画像認識はピクセル強度のパターン解析であり、人間の視覚のような連続的運動視差や質感・温度の感覚は持たない。触覚や平衡感覚、痛覚といった身体性に根ざす感覚は欠如している。

学習経験の違いも重要だ。AIは膨大なデータからパターンを統計的に学習するが、人間は身体を持って世界に働きかける経験や社会的相互作用を通じて意味を学ぶ。マルチモーダルAIはテキストと画像から概念構造を獲得するが、その際にテキストから得た知識(記号的・意味的情報)に強く依存している。

人間が「リンゴ」「バナナ」「ハンマー」のどれが異質か判断するとき、形や用途、質感など視覚・触覚的特徴と文脈的意味の両方を踏まえて直観する。しかしAIモデルは主に「リンゴとバナナはフルーツで共通だが、ハンマーは違う」といった抽象的な知識に頼る傾向がある。AIの概念理解は「説明による理解(concept-by-description)」であり、人間の概念理解は「経験による理解(concept-by-experience)」という差異が存在する。

注意配分・知覚の偏りも見逃せない。人間は自然な場面で生得的・経験的に重要な対象(顔、表情、危険な動きなど)に注意を向けるが、画像認識AIは訓練データ中の頻度やラベルとの関連性で学習するため、人間が重要視しない微小なパターンや統計的相関に強く反応することがある。知覚上どこに意味を見出すかが人間とAIで異なるため、同じ入力に対する解釈がズレる可能性がある。

認識ギャップがもたらす実践的課題

人間とAIの環世界のズレは、具体的なコミュニケーションギャップとして現れる。

主観的評価の不一致は顕著な問題だ。画像の「美的魅力」「ユーモア」「感情喚起性」「記憶に残りやすさ」など主観的評価について、人間とモデルの判断の相関を調べた研究では、現在のモデルはこれら微妙な主観特性において人間とほとんど一致しないことが示された。写真を見せて「この絵の雰囲気はどう感じる?」と尋ねた際、マルチモーダルモデルは物体やシーンの客観的描写は得意でも、そこから受ける主観的な美しさや感情的インパクトの評価は人間と食い違う。

意図解釈の違いも課題となる。人間同士なら共有されている常識的文脈が、AIには通じない場合がある。皮肉や婉曲表現、画像と言葉の組み合わせによる「行間」の意味理解などがその例だ。人間ユーザーの発するメッセージには、その人の環世界に基づく省略情報や前提が含まれる。しかしAIはそれを正しく推測できず、表面的な解釈しか返せなかったり、逆に過剰に深読みして見当違いの応答をしたりすることがある。

説明可能性・予測不可能性の問題も重要だ。AIが独自の環世界に基づき判断している場合、その内部で何が起こっているか人間には理解しにくい。ディープラーニングモデルの決定に対して「なぜそう答えたのか?」を問うとき、AI自身もそれを人間言語で十分説明できない場合がある。このブラックボックス性は、AIの判断への信頼を損ねたり、誤作動時の修正を困難にしたりする。

人間側からすれば、AIの内部主観(環世界)が見えないために、どのような入力でどう感じる(出力する)のか予測しづらい。我々はしばしばAIに対し人間の論理や常識が通用すると思い込んでしまうが、実際にはAIの振る舞いはしばしば人間の予想を裏切る。

環世界ギャップを乗り越える:最新の取り組み

人間の知覚とのアライメント

AIの知覚特性を人間に近づける試みとして、モデルの出力を人間の主観評価に合わせて調整する研究が進められている。

CogIP-Benchという評価基盤では、画像の美しさ・面白さ・感情性・記憶に残る度合いといった指標で人間の評価との一致度を測定する。追加の学習(ポストトレーニング)によってモデルを微調整することで、この一致度を大幅に改善できることが示されている。ポストトレーニング後のモデルは人間の主観評価をかなり正確に予測できるようになり、それを画像生成に応用すると「人間にとって魅力的な画像」を意図的に作り出すことも可能になったという。

この研究は、モデルを人間の環世界に合わせて調整するアプローチの一例であり、より人間中心のAIを実現する道につながっている。

認知パターンの比較研究

人間とAIの知覚過程を直接比較し、どのモデルがより「人のように見ているか」を評価する試みも行われている。人間の視線データ(アイカメラによる注視点の時系列)とAIモデルの内部で計算した視覚的サリエンス(重要度マップ)を比較し、認知的妥当性を評価する研究では、モデルによって人間の注意パターンへの一致度に有意な差があることが分かった。

最新の視覚言語モデルLLaVAは人間の注視と比較的高い一致を示したが、他のモデルでは大きくずれるものもあった。短期記憶的なコンテクスト(数フレームの履歴)を持たせることで改善するモデルもあれば、逆に性能が劣化するモデルもあり、現在のAIの注意メカニズムと人間の注意の対応にはまだ課題が残る。

このような人間-AI間の知覚の差異を定量評価する研究は、どのようにAIを調整すれば人間らしい認知・行動に近づくかという指針を与えるものとして注目される。

環世界を考慮した設計指針

AIシステム設計において環世界の概念を考慮する動きも見られる。AIを人間社会に統合していくには、AIの認識が人間と異なる点(見えていないもの、過剰に見えてしまうもの)を理解した上で、インタフェースやガバナンスを設計する必要があるとの指摘がある。

具体的には、人間がAIの判断根拠を理解できるよう説明可能性(XAI)の確保や、AIが人間にフィードバックをもらって徐々に価値観や注意の基準を人間に合わせていく仕組み(学習によるアライメント)などが重要になる。

また、五感のうちAIが扱える範囲を映像・音声以外にも広げ、触覚や匂いのセンサなどマルチモーダルの拡張を行うことで、人間の感じる世界により近い刺激を取り込めるAIを開発し、環世界の差を縮めようという提案もある。もっとも、それには高度なセンサ技術やマルチモーダル学習のさらなる発展が必要であり、現時点では長期的な展望と言える。

まとめ:異なる環世界の交差が生む新たな可能性

マルチモーダルAIにおける環世界の統合と、人間との環世界ギャップについて考察してきた。ユクスキュル以来の環世界の概念は、本来は生物の主観的世界を説明するものだったが、AIの知能を考える上でも有用な視座を提供している。すなわち「AIにも独自の主観的世界がありうる」という発想である。

現状のAIが内部に形成する世界表象や「環世界」が、どの程度一貫した主体性を持つかは慎重に見極める必要がある。現時点のAIは自己保存の欲求も感覚の快不快も持たないため、人間や動物と同じ意味での「主観的体験」を語るのは尚早かもしれない。

しかし、マルチモーダルAIが内部に世界の表現を作り上げ、人間に通じる概念構造を自発的に形成しつつあるという研究結果は、将来的にAIが我々とある程度重なり合う環世界を共有できる可能性を示唆している。

今後の展望としては、人間とAIの環世界の重なりを増やし、相互理解を促進する方向が重要になるだろう。それは一方面ではAIを人間に近づける(マルチモーダルによる学習、認知的アライメントの強化)ことであり、他方面では人間がAIの特性を学ぶ(AIリテラシーの向上、ブラックボックスな判断への対処)ことでもある。

幸い、AIが内部に形成する概念マップが人間のそれと共通項を持ち始めているという知見や、認知科学・神経科学の知見とAIを架橋する研究の進展は、「環世界の交差」による新たな知性への期待を抱かせる。異なる主体同士がお互いの世界を少しでも共有し合うとき、そこに真のコミュニケーションが生まれる。人間とAIの関係も、まさにその境地を目指して発展していくものと考えられる。

コメント