はじめに:なぜ因果説明のバイアスが重要なのか

私たちは日常的に「なぜそれが起きたのか」を説明しながら生きています。仕事のミス、プロジェクトの成功、他者の行動——あらゆる出来事に対して、人間は原因を特定し説明しようとします。しかし、この説明という行為には、実は体系的な歪みが潜んでいます。

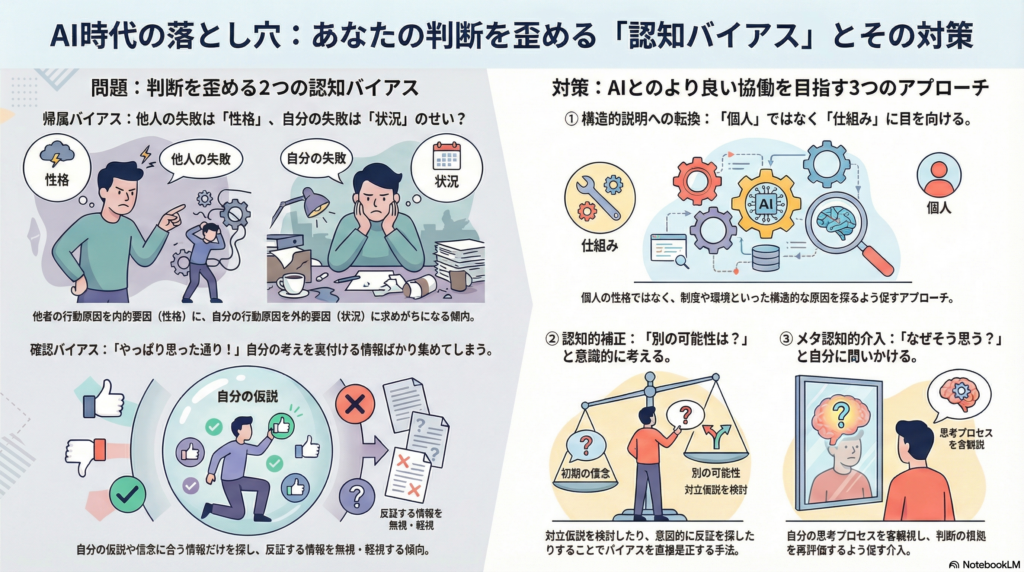

心理学では、こうした認知の偏りを「認知バイアス」と呼びます。特に因果説明において顕著なのが、他者の行動原因を個人の性格に求めすぎる「帰属バイアス」と、自分の信念を支持する情報ばかり集める「確認バイアス」です。これらのバイアスは単なる学術的概念ではなく、AI時代における説明責任、信頼性、公平性といった重要な倫理課題と深く結びついています。

本記事では、人間の因果説明における主要なバイアスの定義とその影響を整理し、AI倫理の観点から検出・軽減の手法を探ります。

因果説明における主要なバイアスとは

帰属バイアス:個人に原因を求めすぎる傾向

帰属バイアスの中でも特に重要なのが「基本的帰属錯誤(Fundamental Attribution Error)」です。これは、他者の行動を説明する際に、状況や環境といった外的要因を過小評価し、性格や能力などの内的要因を過大評価してしまう傾向を指します。

例えば、同僚が締め切りに遅れた場合、「その人がルーズだから」と考えがちですが、実際には予期せぬトラブルや過重な業務負担があったかもしれません。このように、目に見える行動や人格特性に原因を求め、観察できない状況要因を軽視してしまうのです。

関連する概念として、以下のようなバイアスも知られています:

- 行為者-観察者バイアス:自分の行動は状況のせいにし、他人の行動はその人の性格のせいにする

- セルフサービング・バイアス:成功は自分の能力、失敗は環境や他者のせいと説明する

これらのバイアスにより、本来は環境要因が大きく影響している問題でも、個人の責任に矮小化してしまうリスクがあります。結果として、不当な非難や誤った対処につながり、構造的・制度的な原因が見逃される恐れもあります。

確認バイアス:自分の信念を裏付ける情報ばかり集める

確認バイアスは、自分の先入観や仮説を支持する情報ばかり集め、反証となる事実や代替説明を無視・軽視する傾向です。「やはり自分の推測通りだった」と思いたいために、それを裏付ける事例ばかり探してしまうのです。

医療分野の研究では、このバイアスが診断ミスの主要因の一つであることが示されています。あるシミュレーション研究では、精神科医の約13%が初期診断を裏付ける情報ばかり集めて対立する証拠を探さず、結果として診断エラーを犯したという結果が報告されました。

確認バイアスは、原因究明や問題解決の場面で対立仮説の検討不足を招き、誤った結論に導くリスクがあります。一度「原因はXに違いない」と思い込むと、それ以外の可能性を検討しなくなるため、偏った説明や思い込みの強化につながります。

AI倫理における人間の認知バイアスの位置づけ

説明責任と信頼の問題

AI倫理の分野では、これまで主にAIシステム側のバイアス(データやアルゴリズムに起因する不公平・偏り)に注目が集まってきました。しかし近年では、人間の認知バイアスとAIのバイアスが相互作用し、複合的な影響を生む可能性が指摘されています。

AIが意思決定に関与する場面では、何か問題が起きた際に「誰(または何)が責任を負うのか」という説明責任の所在が問われます。しかし、人間側にセルフサービング・バイアスがあると、自分に不都合な結果の責任をAIに過剰に転嫁したり、逆に成功の功績を独占したりといった歪んだ説明が生まれがちです。

実験研究でも、社員がAI搭載システムを使って業務を行った際、成功・失敗に関わらず「自分の責任」と説明する傾向が強かったことが報告されています。このように説明がバイアスに左右されると、真の原因究明や公正な責任配分が妨げられます。

人間とAIのバイアス相互作用

信頼性の面でも、認知バイアスが絡む問題があります。人間は認知バイアスのためにAIを過剰に信頼したり(オートメーション・バイアス)、逆に不当に信頼しなかったりすることがあります。

興味深い例として、専門家がAIの助言を受け入れるかどうかを調べた研究があります。精神科診断支援の実験では、心理士たちはAIの勧告が自身の初期判断と合致する場合にのみ信頼度が上がり、判断を採用しやすくなりました。これは典型的な確認バイアスの表れであり、AIが提示する説明や結果に対して、利用者が自分の信念を裏付けるものだけを選択的に信用することを示しています。

その結果、AIが正しくとも人間の先入観と食い違う場合には無視されてしまい、せっかくのAIの利点が活かされない恐れがあります。

バイアスを検出・分析する手法

実験的アプローチ

人間の因果説明におけるバイアスは、伝統的にシナリオ実験や質問紙調査によって分析されてきました。例えば、基本的帰属バイアスを検出するには、参加者に他者と自分の失敗理由をそれぞれ説明させ、その内容の違いを見る方法があります。他者の場合は人格的要因に言及し、自分の場合は状況要因に言及する傾向が強ければ、帰属バイアスが働いていると判断できます。

確認バイアスを分析するには、ある仮説について支持証拠と反証のどちらをどれだけ探索・想起したかを調べます。医療診断の場面では、「初期診断と一致する情報にどれだけ注目し、矛盾する情報にどれだけ気づかないか」という指標で確認バイアスの程度を評価しています。

自然言語処理による自動検出

近年では、自然言語処理(NLP)を活用してテキスト中の認知バイアスを自動検出する試みも登場しています。人が何らかの出来事を説明した文章を分析することで、バイアスを検出するアプローチです。

例えば、説明の中で内的属性に触れる頻度と状況要因に触れる頻度を比較することで、対応バイアスの程度を評価できます。また、説明に登場する情報源や証拠の種類を分析すれば、確認バイアス(自分の信念を支持する情報ばかり引用していないか)の兆候を捉えられます。

ある研究では、人間の発話テキストからアンカリングや確認バイアス、集団思考など188種類ものバイアスを自動分類するシステムの初期成果が報告されました。大規模言語モデルを用いてテキスト中の偏りとなる表現や視点を抽出・判定する技術が模索されています。

バイアス軽減のための理論的アプローチ

構造的説明への転換

帰属バイアス対策として注目されるのが、個人ではなく構造に目を向けた説明を促す手法です。ある問題の原因を「その人の性格」ではなく「制度上の欠陥や環境の構造」に求める説明スタイルへと転換することで、バイアスを是正できると考えられます。

教育的介入として視点取得トレーニング(他者の立場で状況を見る訓練)を行うと、基本的帰属バイアスが減少するという実験結果があります。具体的には、「相手の立場に立って文脈を想像する」よう促すと、相手の行動を性格ではなく状況から説明する割合が増えました。

エンパシー(共感)を高める訓練や、問題を引き起こすシステム要因を学習させる教育も有効とされています。構造的説明理論は、帰属バイアスによる「個人非難」に偏った説明を是正し、より包括的で公平な原因理解を促すアプローチと言えます。

認知的補正(デバイアス)手法

こちらは人間の認知バイアス自体に直接働きかけて是正する手法です。心理学研究からは、多くの認知バイアスは訓練やフィードバックによって軽減可能であることが示唆されています。

例えば、確認バイアスについては、「対立仮説を検討するように明示的に指示する」ことでバイアスを減らせるとの知見があります。これは積極的な代替案の列挙や意図的な反証探しのステップを組み込む方法です。

ゲームを使った訓練も効果的です。ある研究では認知バイアス低減のためのシリアスゲーム(MACBETHと名付けられたもの)を開発し、確認バイアスと基本的帰属錯誤の両方を取り上げました。結果、ゲームで訓練を受けた参加者は、受けない場合に比べてバイアスのスコアが有意に低下し、その効果が訓練直後だけでなく一定期間保持され、訓練していない他の課題にもある程度移転したという報告があります。

重要なのは、こうした介入をAIシステム側と連携させることです。例えば、AIの説明インタフェースにユーザが安易に同意・納得しようとすると警告を出したり、意図的に反対意見も提示したりするデザインを組み込めば、確認バイアスやオートメーション・バイアスを減らす効果が期待できます。

メタ認知的介入

メタ認知とは「自分の認知を認知する」能力、つまり自分がいまどのように考え判断しているかを客観視・モニターし、制御することです。バイアスは多くの場合無自覚・自動的に働くため、まずそれに気づくことが軽減への第一歩となります。

具体的な方法としては、判断根拠の説明を自己に求めることが挙げられます。「あなたはなぜそれが原因だと思いますか?」と問うことで、自分の説明の妥当性を再評価させるのです。心理学の研究では、こうしたメタ認知的な問いかけによってバイアスによる誤答が減少した例があります。

AIシステム側でも、ユーザに説明の根拠を問い返したり、ユーザの判断に対して「確信度はどの程度か?他に考えられる原因は?」といったプロンプトを出したりする設計が考案されています。これはユーザ自身に内省と自己修正を促すもので、強制的に情報を与えるよりも受け入れやすく効果的だという指摘もあります。

人間とAIの「対話的」な説明プロセスを設計し、ユーザが説明を一方的に受け取るのではなくAIからの問い返しや追加の視点提示を受けられるようにすることで、ユーザは自分の理解や判断を都度メタ認知的に点検でき、バイアスの影響を抑えた納得のいく説明に到達しやすくなります。

今後の研究課題と実践上の限界

現在提案されている理論的枠組みや介入策について、実験的な裏付けが不足しています。文献レビューや専門家の知見から有望と考えられるバイアスのリストや対策手法が示されているものの、実際に人間の説明行動にどの程度効果があるかを測定した研究は限られています。

また、バイアスの程度や現れ方には個人差や文化差があり、画一的な対策では不十分な場合があります。今後は、ユーザごとのバイアス特性を動的に評価しパーソナライズドな介入を行う仕組みが課題となります。

さらに、人間のバイアス同士、そして人間とAIのバイアスの相互作用はまだ十分解明されていません。複数のバイアスが同時に存在するとき、その効果は単純ではなく相乗的・複合的に働く可能性があります。人間のバイアスとAIシステムに内在するバイアスが互いに影響を及ぼし連鎖的に偏りを増幅するリスクも指摘されており、こうした複合バイアスに対処する包括的なフレームワークの構築が求められます。

バイアス軽減介入そのものにも潜在的な限界があります。完全なバイアス除去は非現実的であり、認知バイアスの多くは人間が不確実な世界で迅速に判断するためのヒューリスティック(近道)でもあります。介入策には副作用のリスクも伴い、節度とバランスが重要です。

まとめ:バイアスと向き合うAI時代の説明責任

人間の因果説明には、帰属バイアスや確認バイアスといった体系的な歪みが潜んでいます。これらはAI時代における説明責任、信頼性、公平性といった重要な倫理課題と深く結びついており、看過できない問題です。

検出手法としては、実験的アプローチや自然言語処理による自動検出が発展しつつあります。軽減策としては、構造的説明への転換、認知的補正手法、メタ認知的介入といった理論的アプローチが提案されています。これらを組み合わせることで、人間とAIの協働システム全体での偏りを減らすことが期待されます。

ただし、実証的検証の不足、個人差・文化差への対応、バイアス相互作用の解明、介入の限界と副作用など、今後解決すべき課題も多く残されています。心理学・認知科学的な実証研究、AI・HCI的なシステム設計、哲学・倫理学的な省察を結集した学際的アプローチによって、より説明可能で公正なAIと人間の協調関係を構築していく必要があるでしょう。

コメント