はじめに:なぜ今、意味の起源論が生成AIに必要なのか

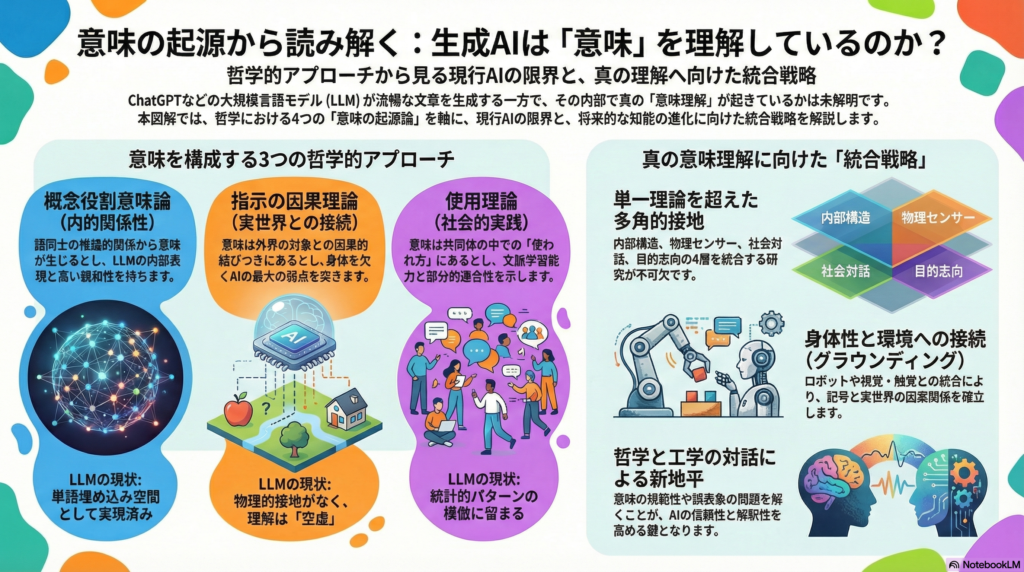

ChatGPTやClaude、Geminiといった大規模言語モデル(LLM)が日常に浸透する中、「AIは本当に言葉の意味を理解しているのか」という根本的な問いが研究者の間で論争を呼んでいます。統計的パターンから流暢な文章を生成するLLMの能力は目覚ましいものの、その内部で何が起きているのか、真の意味理解とは何なのかは未解明のままです。

この問題に答えるには、哲学が長年取り組んできた「意味の起源」をめぐる議論が有効な手がかりとなります。本記事では、テレオセマンティクス(生物学的機能による意味論)、概念役割意味論(内的関係性による意味論)、指示の因果理論(外界との因果連鎖による意味論)、使用理論(社会的実践による意味論)という4つの代表的理論を横断的に比較し、それぞれが生成AIの意味処理にどう応用できるかを検討します。

テレオセマンティクス:生物学的機能から意味を捉える

適応的成功が意味を定義する

Ruth Millikanに代表されるテレオセマンティクスは、心的表象の意味を進化的・適応的な機能から説明します。カエルが小さく動く黒い物体に舌を伸ばす神経反応は、たとえ紙切れに誤反応しても「餌(昆虫)」という内容を持つとされます。なぜなら、その神経システムの生物学的機能が餌捕獲にあるからです。

この理論の強みは誤表象の概念を自然に扱える点にあります。機能が示す規範があるため、「正しい対象」と「誤った対応」を区別でき、真偽評価が可能になります。

生成AIへの応用の難しさ

現行のLLMにこの理論を適用する際の課題は明確です。テキストのみで訓練されたモデルには、明確な生物学的機能も進化史も存在しません。ある内部表現に「意味」を付与するには、それが果たす適応的役割を特定する必要がありますが、汎用的なテキスト生成という目的ではこれが困難です。

ただし応用の可能性もあります。強化学習で特定のタスク成功率を最大化するようLLMを訓練すれば、各内部表現の機能的貢献度を評価でき、テレオセマンティクス的な意味付けが可能になるかもしれません。また、AIの誤出力を「本来の機能から逸脱した表象の発火」と捉える分析視点も提供されます。

概念役割意味論:内的関係性が意味を構成する

推論的役割こそが意味の本質

Wilfrid Sellarsらが展開した概念役割意味論(CRS)は、「兄」という概念の意味を「男性のきょうだいである」「親がいることを含意する」といった推論的関係の総体として捉えます。記号それ自体に内在的意味はなく、認知体系内で果たす役割が意味を与えるという立場です。

この理論は記号接地問題を内在的に処理します。外界との対応がなくても、知覚入力から行動出力までの体系内での役割があれば意味内容を語れるとするのです。

LLMの内部表現との親和性

Piantadosi & Hill(2022)は、LLMの意味表現は参照対象なしでも内部構造によって成立していると指摘しました。実際、単語埋め込み空間での「王:男性=女王:女性」といった類推関係は、概念間の推論的役割をモデルが内部表現している証左とも解釈できます。

ただし課題もあります。第一に外部参照の欠如です。Benderらの「オクトパス例」が示すように、テキストのみで学習したシステムは現実の対象を指示できない可能性があります。第二に意味の全体論性です。LLMの知識は膨大なパラメータに分散しており、個別の内部状態を人間概念に対応付けるのは困難です。

指示の因果理論:実世界との結びつきが意味を決める

命名行為と因果連鎖の重要性

Saul KripkeとHilary Putnamによる因果理論は、「水」という語の意味をH₂Oという実在との因果的結びつきで説明します。最初の命名(バプテスマ)で対象と語が結ばれ、その後の伝達的連鎖で参照が保持されるという考え方です。

Putnamの有名な主張「意味は頭の中にはない」は、個人の認識内容より外部事実が意味を決定することを示します。双子の地球の思考実験では、地球人の「water」はH₂Oを、双子地球人の「water」はXYZを指し、内部的に同じ概念操作をしていても環境が違えば意味も異なります。

現行LLMへの辛口評価

因果理論の観点から見ると、LLMは実世界との直接的な因果接触がないため、真の意味理解には到達していないと評価されます。Benderらの「オクトパス試験」では、陸上の会話を盗み聞きしたタコが「ココナッツを持ってきて」と言われても実物を特定できないように、参照対象との因果関係のない学習では単語の意味を本当に理解したことにならないと批判されます。

この限界を克服するには、ロボットへの組み込みや視覚・触覚センサーとの統合など、環境との接続による接地強化が必要です。一方、因果理論は指示の安定性という利点も持ち、将来的にAIの内部表現に確定的な参照リンクを与えることで、モデルの解釈可能性と信頼性を高める方向性も示唆します。

使用理論:社会的実践の中に意味は宿る

言語ゲームとしての意味

Ludwig Wittgensteinの後期哲学に基づく使用理論は、「言葉の意味はその使われ方である」という原則を掲げます。言語は多様な言語ゲーム(挨拶、命令、報告など)の集合であり、文脈ごとの役割が意味を定めるという立場です。

意味の起源は個人の頭や抽象的対応ではなく、人々の**共同生活(生活形式)**の中にあります。子供は指差しや模倣を通じて適切な使い方を訓練され、それが接地点となります。記号接地問題は「どう意味が宿るか」ではなく「どう使い方を習得するか」に置き換えられるのです。

LLMとの部分的適合性

統計的文脈学習を行うLLMは、「意味=文脈における使用」というWittgensteinの洞察と親和的です。モデルは文脈に応じた語の使い分け(多義語の適切な解釈など)が可能であり、人間の言語ゲームのパターンを部分的に写像しているとも言えます。

しかし使用理論が強調する実践的文脈(発話の意図や行為との結び付き)はモデルには内在していません。LLMは「規則に従っている」のではなく「規則に従うように見える振る舞い」をしているに過ぎない可能性があります。真の統合には、AIが人間と共同の活動や環境を共有しつつ言語を使用することが望ましいでしょう。

4つの理論の統合的視点:生成AIの意味理解に向けて

各理論の補完関係

検討の結果、どの理論も一長一短であり、生成AIの「意味」問題を単独で解決できる万能薬はないことが明らかになりました。むしろ、各理論の洞察を統合的に活かすことが重要です。

- テレオセマンティクスは誤りの概念を扱え、真偽評価に貢献しますが、身体性を欠くLLMへの直接適用は困難

- 概念役割意味論は内部表現の意味分析に有力ですが、外界参照の欠如という限界がある

- 因果理論は実世界接地の重要性を示しますが、概念的ニュアンスや認知的側面の説明が不十分

- 使用理論は文脈的適切さの評価指針となりますが、具体的メカニズムを提供しない

統合戦略の可能性

最新のAI研究は、複数の視点を掛け合わせた方向に進んでいます。例えば以下のような総合戦略が考えられます:

- LLMの内部表現の概念役割を分析しつつ(CRS的アプローチ)

- センサーや知識ベースを結び付けて外界参照を与え(因果理論的接地)

- 人間との対話を通じて適切な言語ゲームに参加させ(使用理論的訓練)

- 目標達成や報酬最大化に役立つようにする(テレオセマンティクス的機能付与)

実際、マルチモーダル化、シンボリック知識統合、人間フィードバック学習などは、この統合的視点と整合的です。

まとめ:哲学的洞察が拓くAI研究の新地平

生成AIにおける意味理解の問題は極めて複雑であり、単一の理論では捉えきれません。しかし哲学が積み上げてきた意味の起源論――目的論的機能、概念的役割、因果的参照、社会的使用――は、それぞれ異なる層に焦点を当てながらも補完関係にあります。

現在のLLMは言語使用の一側面を捉えていますが、真に「意味を持っている」と言えるAIを実現するには、これら哲学的洞察を総動員した研究が求められます。記号接地問題、参照の空虚性、規範的評価の可能性――これらの課題に取り組むことで、AIはより人間に近い意味理解へと近づいていくでしょう。

哲学と工学の対話は、AI研究の新たな地平を拓く鍵となるはずです。

コメント