はじめに:脳を「進化するシステム」として捉える

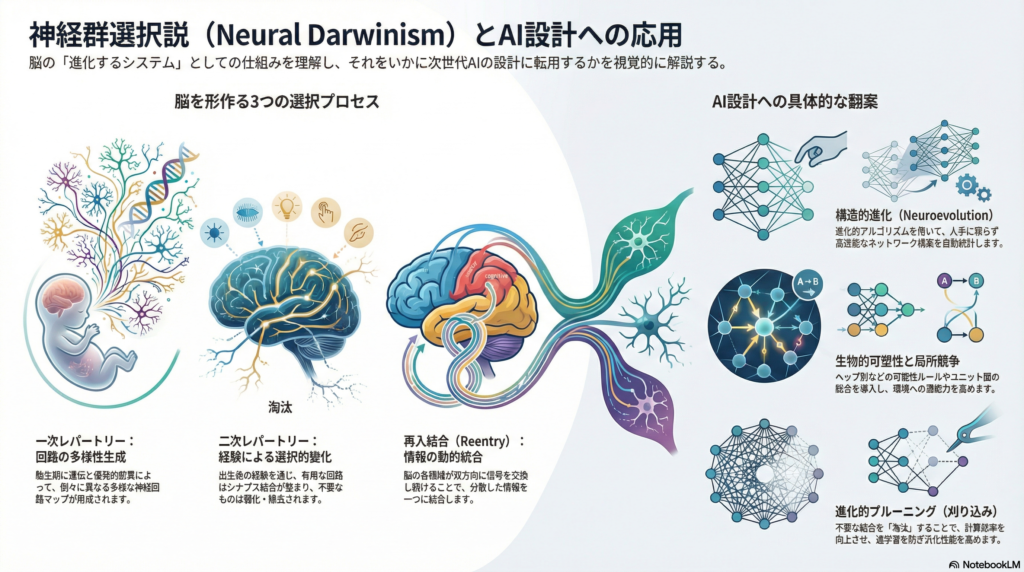

人工知能の設計において、生物の脳がいかにして環境に適応し、学習し、複雑な認知機能を獲得するのかという問いは、常に重要な示唆を与えてきました。神経群選択説(Neural Darwinism)は、ノーベル賞受賞者ジェラルド・エーデルマンが提唱した理論で、脳機能をダーウィン的な選択過程として説明します。この理論は、神経回路の「多様性の生成」と「選択的強化」という二つの原理を中核に据え、脳が個体発生から生涯学習に至るまで、どのように適応的に変化するかを明らかにしています。

本記事では、神経群選択説の理論的背景から、脳における具体的な選択メカニズム、そして現代のAI設計への応用可能性まで、包括的に解説します。

神経群選択説の理論的枠組み

選択主義的脳理論の本質

神経群選択説は、脳を「教示主義的(instructionist)」ではなく「選択主義的(selectionist)」なシステムとして捉えます。教示主義では外部からの情報が直接脳に刻まれると考えますが、選択主義では脳内に予め多様な神経回路の候補が存在し、経験によってそのうちの適切なものが選択・強化されると考えます。

この理論の核心は、脳が個体発生と生涯学習の各段階で多数の変異的な神経回路群(神経群)を生成し、環境からの入力や内在的な価値フィードバックによって有用な回路群が選択的に強化されるという点にあります。この過程は、生物進化における自然淘汰に類似した「体細胞内選択(somatic selection)」と呼ばれます。

三つの主要構成要素

神経群選択説は、以下の三つの主要な構成要素から成り立っています。

一次レパートリーは、胎生期における神経回路形成の段階です。この時期、遺伝情報と発生機構によって多様な神経群結合が形成されます。重要なのは、この過程が完全に遺伝的に決定されているのではなく、偶発的・環境的な変異を含むという点です。この変異により、個々人で異なる神経回路マップが生成され、選択の基盤となる多様性が確保されます。

二次レパートリーは、出生後の経験による神経回路の選択段階です。シナプス結合が経験に応じて強化・弱化され、有用な回路が選択的に残されます。この過程では、ヘッブ則的な可塑性メカニズムが働き、共発火したニューロン群の結合が強化される一方、使われない結合は弱化・除去されます。

**再入結合(reentry)**は、相互に結合した複数の脳領域間で信号が双方向かつ連続的に交換される現象です。これにより、分散した各領域のニューロン集団が同期し、感覚情報や運動指令が統合されます。再入は、知覚の統合、短期記憶、意識などの高次機能に重要な役割を果たすと考えられています。

選択圧としての価値システム

神経群選択説において、どの回路が選択されるかを決定する重要な要因が「価値システム」です。視床や辺縁系などの古い脳の構造が提供する報酬・情動情報が、神経群選択の方向付けとなります。食物や社会的報酬などは特定の回路を優先的に強化し、「価値によるカテゴライズ」を通じて環境適応的なカテゴリー形成を促します。

生得的な偏向(本能)や後天的な経験が、どの回路が「有用か」を評価する基準となり、選択圧を与えます。この価値フィードバックメカニズムは、強化学習における報酬信号に概念的に対応しており、AI設計への応用可能性を示唆しています。

脳における選択メカニズムの詳細

発達的多様性と刈込プロセス

脳の発達過程において、胎児期には多数の神経細胞が過剰に産生されます。この過剰産生は一見非効率に見えますが、選択の基盤となる多様性を確保するために不可欠です。発達過程中、不要な神経細胞はアポトーシス(細胞死)によって刈り込まれます。

この刈込過程は、遺伝情報だけでは完全に決定されません。偶発的・環境的な変異により、個々人で異なる神経回路マップが生成されます。エーデルマンは「多様性こそダーウィン的システムの本質」と述べており、この初期の多様性生成が後の選択的学習を可能にする基盤となります。

シナプス可塑性による選択的強化

学習過程では、ヘッブ則に基づくシナプス可塑性が中心的な役割を果たします。「共に発火するニューロンは共に結合する(Cells that fire together, wire together)」という原理に従い、特定の刺激に対して有効に反応した神経群のシナプス結合が選択的に増強されます。

一方、役立たなかった結合は弱化・除去され、より効率的な回路が残ります。エーデルマンは、「経験が神経群間結合を選択的に変えることで、主体的な経験内容に対応した複雑な回路パターンが形成される」と指摘しており、経験による選択が脳回路を動的に再構築する過程を強調しています。

再入結合による情報統合

再入結合は、神経群選択説において特に重要な概念です。相互結合した複数の脳領域間で信号が双方向に循環することで、分散した各領域のニューロン集団が同期し、情報が統合されます。

再入は脳の構造的・機能的な支配的モチーフであり、知覚の統合や短期記憶、意識などに重要な役割を果たします。神経群選択説では、再入ループを通じて選択された局所回路の情報が相互に補強・調整され、グローバルな意味づけがなされるとされています。

階層的構造と脱縮合性

脳は多層階層的に組織されており、低次領域から高次領域へと情報処理が進みます。各階層で生成される多様な特徴表現は、その後の選択的学習により精緻化されます。エーデルマンは、多層化した神経マップ(視覚皮質など)を再入が結び付けることで高度認知が可能になると指摘しています。

また、脳は「脱縮合性(degeneracy)」という特性を持ちます。これは、多数の異なる構造が同じ機能を果たせる冗長性を指します。進化圧が長い経路で作用する中で、複数の異なる神経回路が類似の出力をもたらすことで、システムの頑健性と適応性が高まります。神経群選択説では、この脱縮合性こそ選択系の必然的な帰結とみなされています。

AI設計への翻案可能性

構造的進化(Neuroevolution)

神経群選択説の原理は、人工ニューラルネットワークの設計に直接応用できる可能性があります。進化的アルゴリズムでネットワーク構造や重みを最適化するアプローチは、既に活発に研究されています。

例えば、Google Brainでは、大量の畳み込みネットワークを生成・評価し、世代ごとに最も性能の良いモデルを選抜・変異・交叉させることで画像認識モデルを自動設計した事例があります。この「適者生存」による探索は、人手設計に頼らず高性能なネットワーク構造を見いだす手段となります。

生物学的可塑性則の導入

生物学的なシナプス可塑性則(ヘッブ則、STDP、神経調節など)を学習アルゴリズムに取り入れる試みも進んでいます。進化アルゴリズムで得られた可塑性パラメータは、変動環境下での迅速な適応学習に有効であることが示されています。

Dropoutのような手法も、脳内でのニューロン死滅・新生に相当するとみなす研究があります。訓練時にランダムに結合やユニットを削除することでネットワークを汎用化させる仕組みは、進化の視点からは一種の「淘汰」に相当します。

局所競争モデルと選択的抑制

自己組織化マップや競合ニューラルネットなど、ニューロン同士の競合・抑制を用いるモデルは、生物の「選択的抑制」と共通するデザイン原理を持ちます。これらのモデルでは、一部のニューロンだけが強く応答し、他は抑制されるため、脳内の選択過程に類似した情報の取捨選択が行われます。

この局所競争メカニズムは、限られた計算資源の中で重要な情報を選択的に処理するという、生物学的にも工学的にも合理的な戦略を実装しています。

階層・モジュラー設計と再入的結合

現代の深層学習モデルも多層・モジュール構造を持ち、上位層が下位層の出力を統合する点で脳構造と類似しています。再入結合の概念は、フィードフォワードと再帰的な結合により多モダル情報を統合するトランスフォーマーやグラフニューラルネットワークに応用できる可能性があります。

特に、異なる処理モジュール間で情報を双方向に交換し、相互に補強・調整するアーキテクチャは、脳の再入メカニズムを模倣したものと捉えることができます。

進化的プルーニングと正則化

神経シナプスの刈込のように、学習後に不要な結合やユニットを削除するモデルプルーニング手法は、既に広く使われています。進化的アルゴリズムではトーナメント選択などで悪い個体を排除しますが、個体内でも不要部分を逐次除去するアルゴリズムが考えられます。

これにより、ネットワークは必要最小限の構造へと「選択的に」収斂します。この過程は、計算効率の向上だけでなく、過学習の防止や汎化性能の向上にも寄与する可能性があります。

今後の研究展望と課題

進化的リワイヤリングの実装

近年提案された「Evolutionary-Rewired-DNNs」構想では、ニューラルネットに対してニューロンの新生・移動・死滅を確率的に繰り返すことで、個体内進化(神経群選択)を実装するアイデアが示されています。

具体的には、学習途中でランダムに新規ユニットを生み、別層に移す、価値の低いユニットを削除するといった操作で、ネットワーク構造を再進化させる手法です。これにより、バックプロパゲーション学習と並行して脳の発達過程に近い構造変化が実現できる可能性があります。

群選択と個体内進化の統合

これまで主に別個に扱われてきた「世代間進化(遺伝的アルゴリズム)」と「個体内選択(神経群選択)」を組み合わせたハイブリッドな学習戦略が研究される見込みです。ネットワーク集団を進化させる際に、各個体内でも不適合部分のプルーニングや新生を導入し、両スケールでの適応を同時に促す枠組みが考えられます。

このアプローチは、生物進化における遺伝的変異と体細胞内選択の相互作用を模倣したものであり、より効率的で頑健な学習システムの構築につながる可能性があります。

多目的最適化と制約の理解

Neuroevolution研究では、資源制約、接続コスト、協調・競合環境などの制約が形づくる進化的選択を体系的に調べています。AIでも、モデルサイズ・計算量・消費エネルギーなどのリソース制約下で如何に性能を維持するかが焦点となります。

今後は、これらの制約を選択圧として設定し、多目的最適化を行う研究が深まるでしょう。生物進化が多様な環境制約の下で最適化を行ってきたように、AI設計においても複数の目的関数を同時に最適化する枠組みが重要になります。

高次認知機能の獲得

言語や抽象思考など高度な知能の獲得には、より大規模かつ複雑な進化シミュレーションが必要かもしれません。進化・学習を繰り返す仮想環境で、社会的行動やコミュニケーション課題を解かせる試みが将来の大きな課題です。

進化圧や価値体系を人間社会に似せた仮想世界で得られた知見は、AIエージェントの汎用知能設計に活かせる可能性があります。特に、社会的相互作用を通じた学習や、複雑な価値体系に基づく意思決定の獲得は、重要な研究テーマとなるでしょう。

脳科学との相互作用

AIへの応用と並行して、進化的学習理論は脳科学実験の設計にも影響を与えます。例えば、「神経回路が選択的に進化するなら、どのような実験でその証拠を見いだせるか」という問いが新たな検証につながります。

逆に、生理学的データが豊富になるにつれ、神経群選択説の妥当性や限界を検証する研究も求められます。エーデルマン自身が指摘するように、神経群選択を厳密なダーウィン的アルゴリズムとみなすには課題があります。AI実装を通じて「選択圧」を具体化し、実験可能なモデルを構築する努力が続くでしょう。

まとめ:選択主義的AI設計の可能性

神経群選択説は、脳を静的な情報処理装置ではなく、動的に進化・適応する選択主義的システムとして捉える革新的な理論です。この理論の核心である「多様性の生成」「選択的強化」「再入的統合」という原理は、現代のAI設計に多くの示唆を与えます。

構造的進化、生物学的可塑性則の導入、局所競争モデル、階層的・モジュラー設計、進化的プルーニングなど、具体的な応用可能性は広範囲にわたります。特に、進化的リワイヤリングや群選択と個体内進化の統合といった新しいアプローチは、より適応的で頑健なAIシステムの構築につながる可能性があります。

今後、脳科学とAI研究の相互作用がさらに深まることで、選択主義的な学習原理に基づく新しい世代のAIシステムが登場するかもしれません。神経群選択説が示す「進化と学習の協奏」という視点は、人工知能が真に適応的で汎用的な知能を獲得するための重要な道標となるでしょう。

コメント