はじめに:LLMの課題と概念グラフによる解決策

大規模言語モデル(LLM)は、自然な文章生成や知識に基づく応答において目覚ましい進化を遂げています。しかし、明示的な論理推論や一貫した知識の扱いには依然として弱みがあります。推論過程がブラックボックス化しており、論理的整合性を欠いた回答を生成する場合も少なくありません。

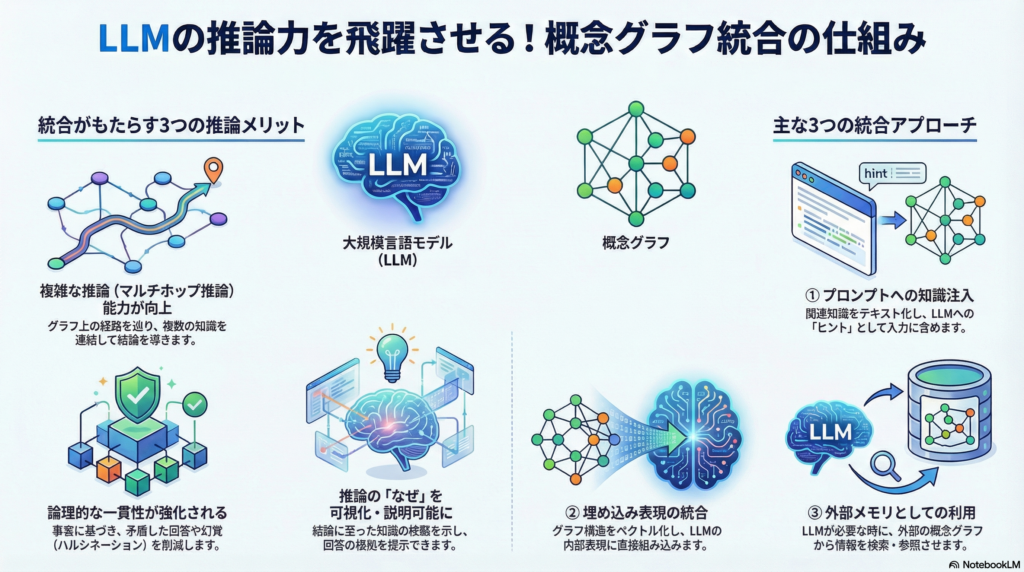

この課題を解決する有力なアプローチが、概念グラフ(知識グラフ)とLLMの統合です。ニューラル(統計的)手法とシンボリック(記号的)手法を組み合わせることで、ディープラーニングのパターン認識能力と論理ベースの知識処理能力を両立できます。この記事では、概念グラフの役割、LLMとの統合方法、期待される効果、そして最新のフレームワークについて詳しく解説します。

概念グラフとは何か:構造化された知識表現の力

概念グラフ(concept graph)とは、知識をノード(概念や実体)とエッジ(それらの間の意味関係)のグラフ構造で表現したものです。ノードは人物、物体、抽象概念などのエンティティを表し、エッジはノード間の関係を意味的に示します。たとえば「AはBの一種である」「XはYの原因である」といった関係性を明示的に表現できます。

概念グラフは知識グラフとも呼ばれ、典型的には三項関係(主語-関係-目的語のトリプル)で表現されます。この構造化されたデータ形式により、エッジを辿ることで推論が可能になります。たとえば「AはBの一部」「BはCの一種」というエッジから「AはCの一部である」と推論できるように、ノード間の経路が知識の連鎖を明示します。

概念グラフの重要な特徴は、オントロジー(概念の階層)や語彙的知識を統合できる点にあります。これにより意味的な整合性を持った知識ベースとして機能し、LLMに不足しがちな明示的で構造化された知識を提供します。

概念グラフとLLMを統合する3つの方法

研究者たちは、概念グラフの知識をLLMに統合するために様々なアプローチを提案しています。主な方法は以下の3つです。

プロンプトへの知識注入

最も直接的な方法は、知識グラフ上の事実やパスをテキストに変換し、LLMへの入力プロンプトに組み込むことです。質問応答タスクでは、関連するノードとエッジを「ヒント」としてプロンプトに与えることで、LLMに概念間の関係を認識させます。

この手法は追加の学習を要さず手軽に実装できますが、グラフ構造を文章化する過程で本来の構造的な意味関係が平文化されてしまうという課題があります。それでも外部知識をLLMに与える簡便な手法として、多くの場面で活用されています。

エンコーディング・埋め込みの統合

より高度な手法として、概念グラフの表現をLLMの入力層や中間層に直接組み込む方法があります。知識グラフのノードや関係をベクトル埋め込み(graph embedding)に変換し、それをLLMの入力トークン列に特殊トークンとして挿入する技術が開発されています。

このアプローチではLLMのアーキテクチャ自体に大きな変更を加えずに、ベクトル化されたグラフ構造を内部表現に取り込めます。また、Transformer内部にグラフニューラルネットワーク(GNN)層を組み込み、テキストエンコーダとグラフエンコーダを統合的に動作させる手法も提案されています。

外部記憶としての利用

概念グラフをLLMの外部知識ベース(メモリ)として扱い、動的に参照・検索する統合も有力です。これはRetrieval-Augmented Generationの発想に近く、LLMが回答を生成する際にその都度知識グラフにクエリを投げて関連ノードのサブグラフを取得し、それをもとに推論を行います。

LLM自体は知識をパラメータ内に保持せず、必要なときに概念グラフから事実を検索するため、最新かつ一貫した情報に基づく応答が可能になります。マルチエージェントシステムとして、LLMを制御役とし、別のエージェントが知識グラフ探索や論理検証を担当する枠組みも考案されています。

統合による3つの推論上の利点

概念グラフとLLMを統合することで、純粋なLLMでは得られない様々な利点が期待できます。

マルチホップ推論能力の向上

LLMは複数の知識を連結して新たな結論を導く推論(多段階の中継推論)を不得意としています。概念グラフを組み合わせれば、グラフ上のパスを辿ることで直接にマルチホップ推論を構成でき、LLMの回答プロセスに明示的な推論チェーンを組み込めます。

言語文脈(質問文など)を知識グラフ上の構造化知識でグラウンド(紐付け)することで、モデルは状況文脈と世界知識の双方を踏まえた回答が可能になります。これは言語情報とグラフ知識の相互作用によって生まれるシナジー効果であり、LLMの内部に潜在するあいまいな関係性を、概念グラフが提供する明示的な関係性で補強することで実現されます。

論理的一貫性の強化

概念グラフに格納された知識は人手で精査された事実や論理ルールであることが多く、その上で推論することでLLMの出力に事前知識に反する矛盾が生じにくくなります。統合システムでは、LLMが推論した内容を都度グラフ知識と照合し矛盾をチェックしたり、グラフ上の制約を守るようLLMの出力を誘導できます。

その結果、事実に忠実で首尾一貫した回答が得られ、LLM単独で問題となる幻覚(ハルシネーション)や矛盾した説明を減らす効果が期待できます。マルチステップの推論では、中間結果ごとに知識グラフでチェックを入れることで、一貫した論理展開を保証できます。

可説明性の向上

LLMは通常内部の注意重みなどが人間に解釈しづらいのに対し、概念グラフはノードとエッジの連結という形で推論過程を直接表現できます。統合システムでは「どの知識ノードを経由して結論に至ったか」という推論経路をグラフ上で可視化でき、ユーザに対して「なぜその答えが導かれたか」を説明する手がかりを提供します。

シンボリックな知識基盤をもつAIは、内部でどの規則や事実を用いたかを示すことが可能であり、これはブラックボックスになりがちな純粋ニューラル手法にはない強みです。シンボリックAI部分(知識グラフやルールベース)は推論を行うだけでなく、決定の理由を説明する根拠を生成することができます。

代表的なフレームワークとモデル

近年、概念グラフとLLMの統合に関する様々なフレームワークやモデルが提案されています。

GreaseLM:言語モデルと知識グラフの深い融合

GreaseLM(Graph REASoning Enhanced LM)は、スタンフォード大学とAI2の研究チームによって開発された質問応答モデルです。事前学習済みTransformer言語モデルとグラフニューラルネットワーク(GNN)を組み合わせ、複数の層にわたって両者の表現を交差させる独自のアーキテクチャを採用しています。

このモダリティ間の情報伝播により、言語文脈の表現を知識グラフ上の構造化知識でグラウンドし、逆に文中の微妙なニュアンス(否定表現や条件など)がグラフ側のノード表現にも反映されます。常識推論や医学QAにおいて、従来より小さいモデル規模で最先端を上回る性能を示しました。

NS-CL:ニューラルとシンボリックの統合

ニューラル・シンボリック・コンセプトラーナー(NS-CL)は、MITのMaoらが提案した画像と言語の領域でニューラル表現とシンボリック推論を統合した先駆的手法です。与えられた画像シーンから物体を検出してオブジェクト間の関係グラフ(概念グラフ)を構築し、質問文をそのグラフ上で実行可能なシンボリックプログラム(論理クエリ)に変換して推論します。

明示的なプログラム実行を介することで、視覚的な概念学習と言語の理解を同時に行い、高い汎化能力と説明可能な推論を実現しました。

SKILL:構造的知識注入フレームワーク

SKILL(Structural Knowledge Injection for LLM)は、知識グラフから論理規則を抽出してLLMに注入する最新のフレームワークです。KG上のパスから帰納的にルール(「X→YかつY→ZならX→Z」等)を発見し、LLMをそのルールで微調整して推論精度を高めます。

従来のKG推論モデルでは共起パターンに頼るため意味的に不整合な推論経路が生じがちでしたが、SKILLではLLMのセマンティック理解能力を用いて無効なパターンを排除し、有効な論理則のみを取り込むことで知識グラフの構造を深く理解した推論を行います。

まとめ:概念グラフとLLMの統合が拓く未来

概念グラフと大規模言語モデルを統合する手法は、AIの推論能力を飛躍的に高める可能性を秘めています。概念グラフの持つ構造的な知識表現と、LLMの持つ柔軟な言語理解・生成能力を組み合わせることで、両者の弱点を補い合うことができます。

具体的には、統合により複雑な推論課題における正確性・一貫性の向上、および推論過程の透明性が実現できます。現在提案されているニューラル・シンボリック推論のフレームワークは、その有望性を示すもので、今後も論理と深層学習の架け橋として多くの発展が期待されます。

論理的一貫性の担保や説明可能なAIへの社会的要請が高まる中、概念グラフとLLMの統合研究はAIシステムをより信頼できるものにする重要なアプローチと言えるでしょう。次のステップとして、具体的な実装方法や応用分野での成功事例について、さらなる掘り下げが求められます。

コメント