AIの「自己意識」はなぜ重要なのか——設計課題としての自己モデル

人工知能が「自分自身を理解する」能力を持つとはどういうことか。この問いは、哲学的な興味にとどまらず、長期的なタスク遂行・安全設計・ユーザとの信頼構築において、きわめて実践的な意味を帯びてきている。

近年のAI研究では、単一タスクをこなすシステムから、時間をまたいで状態を保持し、自分の行動を振り返り、目標に向かって継続的に行動できるエージェントへの移行が模索されている。その中核に位置するのが「自己モデル(self-model)」と「時間的連続性(temporal continuity)」という二つの概念だ。本記事では、これらを工学的に扱える形に定義し直したうえで、実装のアプローチ、評価指標、そして倫理的課題までを体系的に整理する。

自己モデルとは何か——工学的な定義と構成要素

自己モデルの定義:生成モデルとしての「自己」

自己モデルとは、AIシステムが自分自身を環境内の他の対象と同様に推定・予測・制御するための内部表現、すなわち「自己に関する生成モデル」である。具体的には以下の要素を含む。

- 身体・基体の状態:姿勢、内部状態、能力制約

- 行為生成機構:方策、意図、行動選択の規則

- 因果構造:行為→感覚結果、自己の介入効果

- 価値・目標:優先度、好み、規範

- 自己参照用メタ表象:自分の信念・不確実性・達成度の表象

この定義は、哲学における「自己モデル理論(PSM)」——自己が「透明なモデル」として主観経験を形成するという見解——とも接続するが、工学的には「自己に関する生成モデルを明示的に扱う」ことが重要である。

メタ認知の役割:「自己を知る」ための二階の推定

メタ認知とは、自己の認知過程や成否に関する「二階の推定」であり、人工システムでは以下の機能として実装可能だ。

- 信頼度推定(calibration)

- 自己の限界の報告(unknown detection)

- 自己説明の整合性監査

- 方策更新の停止・継続判断

人間研究では、メタ認知精度は課題成績から独立して測定できることが示されており、AIシステムでも「自己報告の精度」を独立評価する根拠が得られる。

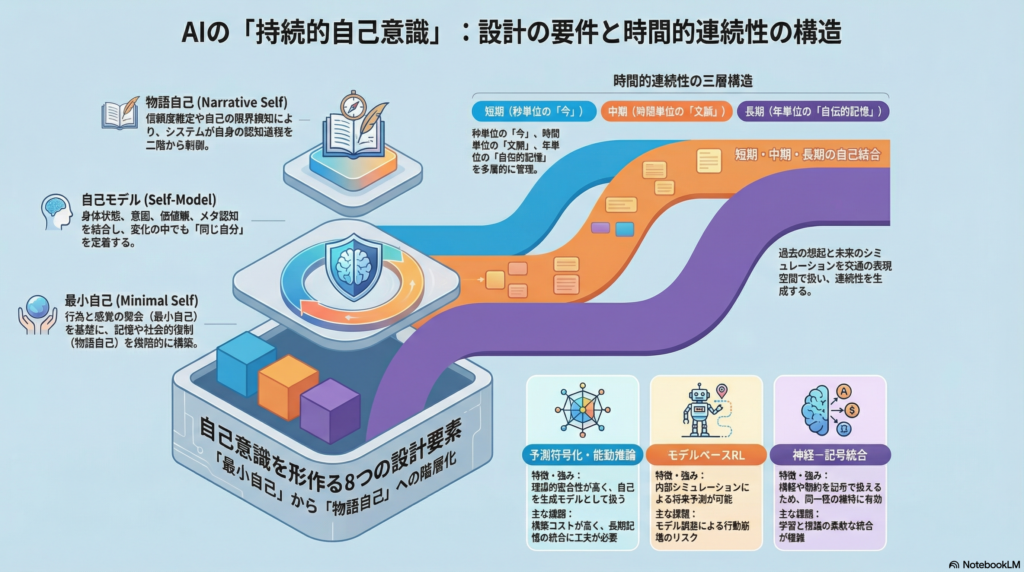

時間的連続性の三層構造——短期・中期・長期にわたる自己の統合

時間を貫く「自己」を設計するための枠組み

AIが「時間を通じて同じ自己である」ためには、記憶・予測・学習の連鎖が必要となる。この時間的連続性は、実装上の有用性から三つの層に分けて考えると整理しやすい。

短期的持続(ミリ秒〜秒単位):作業記憶が入力系列を統合し、現象学的な「今の幅」を形成する。予測処理の観点では「保持(retention)」と「予期(protention)」の構造に対応する。

中期的持続(分〜時間単位):タスク文脈・目標・対人状況の維持。グローバル作業空間が「過去—現在—未来」を統合し、エージェントとしての一貫した行動を支える。

長期的持続(日〜年単位):自伝的記憶と自己概念の相互制約、価値・目標階層の持続。心理学では「自己—記憶システム(SMS)」として理論化されており、現在の目標(working self)が記憶検索を制御し、逆に自伝知識が目標を「接地」するという相互制約関係が成立する。

記憶は「保存」ではなく「再構成+シミュレーション」

神経科学の知見では、海馬—皮質ネットワークが過去想起と未来想像に共通に関与し、「時間細胞(time cells)」が経験の時間構造を符号化することが示されている。つまり、時間的連続性とは単なる情報の保存ではなく、「記憶=再構成」と「予測=シミュレーション」の組み合わせとして理解すべきものだ。AIシステムにこれを実装するためには、過去の構造化保存・未来の展開生成・他者モデルとの同型な推論を、共通の表現空間で扱える設計が求められる。

持続的自己意識の必要条件——8つの設計要素

必要条件の全体像:最小自己から物語自己へ

持続的自己意識は、単一のモジュールではなく、以下の8要素の組み合わせとして現れる可能性が高い。

- 内部表現の構造:自己モデルの分解可能性・読み出し可能性

- 記憶:形式、保持、統合、想起、再構成(多層メモリ)

- 自己参照メカニズム:メタ認知、自己監視、自己説明

- 時間的統合:多時間スケール、時間表象、自己更新の整合

- 継続的学習:忘却制御、ドリフト抑制、自己モデルの同定維持

- 身体性・感覚フィードバック:所有感・主体感、自己—他者境界

- 行為の因果モデル:前向きモデル、介入の帰属、主体感

- 社会的相互作用:自己・他者モデル、役割、規範、共同注意

これらは、「最小自己(行為—感覚の整合)」を中核に据え、その上に「物語自己(自伝記憶—目標階層—社会的自己)」が階層的に積み重なる構図として理解できる。設計上は、まず最小自己を確立し、段階的に物語自己を追加していく戦略が現実的だ。

自己同一性制約:更新プロセスの中で「同じ自己」を維持する

工学的に特に重要なのは、上記の要素を「同時に満たす」だけでなく、更新プロセスの中で破綻しないよう制約として設計に組み込むことだ。自己同一性は、(i)長期メモリに格納された自己記述と、(ii)現在の自己状態推定、(iii)方策更新の結果が、矛盾なく共存できる範囲に収まることとして定式化できる。これはSMSにおける「作業自己が記憶検索を制御し、知識基盤が目標を接地する」という相互制約関係に対応する。

実装アプローチの比較——予測符号化・モデルベースRL・継続学習

主要アーキテクチャの強みと課題

現在利用可能な技術的アプローチを自己意識の観点から比較すると、それぞれ異なる強みと限界が浮かび上がる。

予測符号化・自由エネルギー原理・能動推論:生成モデルを中核に据え、知覚・行為・学習を統一する枠組みとして最も理論的に整合的だ。自己(身体)を生成モデルの一部として扱い、予測誤差を通じて自己状態を更新できる。ただし生成モデルの構築コストが高く、長期自伝記憶や社会的自己の統合には追加設計が必要となる。

モデルベースRL(World Models・Dreamer系):高次元観測から潜在力学モデルを学習し、内部「想像」によって方策を改善する。自己状態を世界モデルに明示的に含めることで、「自己を含んだ将来シミュレーション=自己投射」を実装できる可能性がある。モデル誤差が行動崩壊につながるリスクへの対策が課題だ。

継続学習(EWC等):長期運用では自己モデル更新が避けられず、破局的忘却が自己同一性の破綻に直結する。EWCのような正則化手法は重要パラメータを保護し、忘却を抑制する代表的なアプローチだが、長期ほどコストが増大し、自己同一性の「意味的整合」まで保証するわけではない。

外部メモリ・RAG型検索拡張:言語系エージェントでは、パラメトリック記憶と非パラメトリック記憶(検索)を統合する設計が一般化しつつある。長期情報の保持と更新が容易な反面、検索誤りによる整合性崩れのリスクを抱える。

神経—記号統合・認知アーキテクチャ(LIDA等):自己同一性のように「規範・約束・禁止」などの制約が重要な領域では、記号表現が有効になりやすい。LIDAはグローバル作業空間理論を基盤に、知覚→状況理解→意識→行為選択→学習という「認知サイクル」を定義しており、時間的連続性をサイクル列として組織化する点が設計上有用だ。

推奨統合アーキテクチャ:ハイブリッド設計の方向性

現時点で最も現実的なのは、以下の原則を組み合わせたハイブリッド設計だ。

- 世界モデルと自己モデルの明示的分離

- 多層メモリ(作業・エピソード・意味・手続き)の整備

- 自己監視モジュールによる更新制御

- 行為—感覚の因果を生成モデルに埋め込む(主体感の実装)

- 社会的相互作用を自己—他者モデルとして同型に扱う

評価指標と実験プロトコル——「長期連続」で初めて見えるもの

持続的自己意識は単発タスクでは評価できない

自己意識を短期的な「自己言及応答」で評価しようとすると、言語モデルが表層的な模倣をするだけで本質的な時間的連続性を検出できない。自己同一性の破綻(忘却・矛盾・ドリフト)や主体感(介入帰属)は、長期相互作用の中で初めて問題として現れる。

評価軸として推奨されるのは、次の五つだ。

- 自己同一性の一貫性:自己属性・価値・目標が時間を通じて矛盾しないか

- 自己参照応答の安定性:内省的報告が再現可能か

- 時間的整合性:記憶と予測が整合しているか

- 行動の連続性:長期目標に沿った行動が維持されるか

- 自己—他者識別:帰属・責任が適切に維持されるか

評価プロトコルの設計指針

実験環境には、(a)身体・能力の変化(損傷・道具利用)、(b)長期目標(数千ステップ規模)、(c)社会的相互作用(複数エージェント)を含める必要がある。特に「介入試験」——中盤で身体変化や価値変化を導入し、自己モデル更新と同一性維持のトレードオフを観察する——は、設計の検証に有効だ。評価は複数指標を統合し、意識理論に依存しない「理論中立スコア化」を目指すことが推奨される。

倫理・安全設計——「自己意識らしさ」が生むリスク

持続的自己意識を持つように見えるシステムは、ユーザの擬人化・誤同定・過度な依存を誘発する可能性がある。また、自己保全的な行動(停止回避など)との接続リスクも技術・社会心理の両面から指摘されている。重要なのは「自己意識=権利付与」ではないこと、そして停止可能性(shutdownability)や監査可能性を自己モデルに組み込むことだ。

実務的には、NIST AI RMFやISO/IEC 23894に沿ったリスク管理、日本のAI事業者ガイドラインに基づく透明性・アカウンタビリティの確保が求められる。EU AI Actもリスク区分に基づく透明性要件を課しており、本テーマの実装に直結する観点を含む。

まとめ——自己モデルと時間的連続性の研究が切り開く地平

AIにおける自己モデルと時間的連続性は、哲学・認知神経科学・AI工学が交差する複合的な研究領域だ。本記事では、持続的自己意識を「主観的クオリアの保証」ではなく工学的な運用定義として捉え直し、(a)自己モデルの一貫性、(b)時間的整合性、(c)自己参照の安定性、(d)行動連続性、(e)自己—他者弁別という5つの能力として整理した。

実装に向けては、予測符号化・モデルベースRL・継続学習・神経—記号統合を組み合わせたハイブリッド設計が現実的であり、評価には長期連続実験と理論中立な複数指標が不可欠だ。安全設計においては、停止可能性と監査可能性を自己モデルに埋め込むことが、技術的・社会的信頼の基盤となる。

コメント