はじめに:なぜ長期記憶と学習の統合が協働AIの鍵となるのか

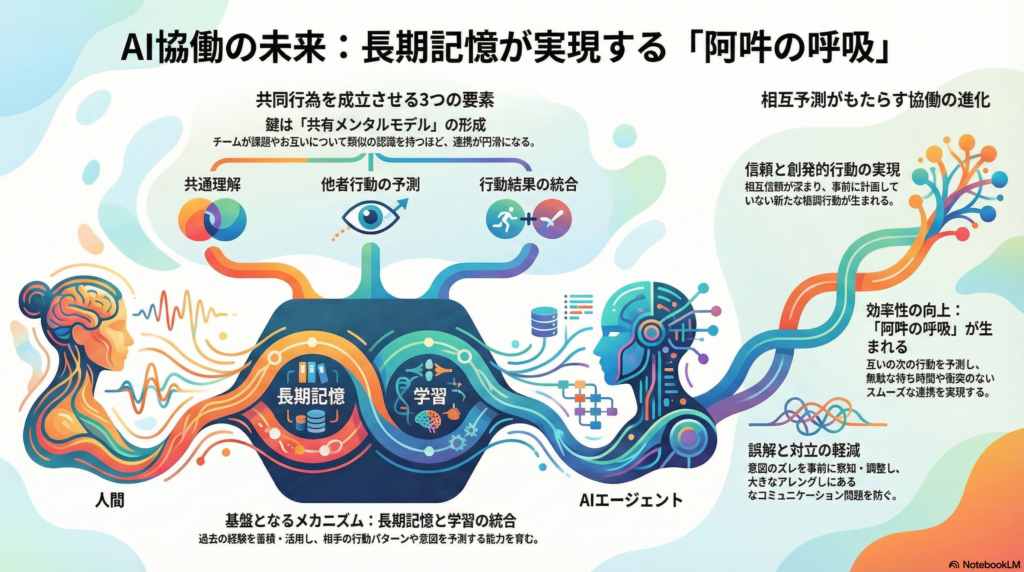

AIエージェントが人間や他のAIと効果的に協働するためには、単なるタスク実行能力だけでは不十分です。継続的な関係の中で相手の行動パターンを学習し、意図を予測し、共通の目標を形成していく能力が求められます。この実現の鍵となるのが長期記憶と学習の統合です。

本記事では、認知科学とAI研究の知見を基に、長期記憶と学習がどのように統合され、協働エージェントの相互予測能力と目標共有を進化させるのかを詳しく解説します。

認知科学が示す長期記憶と学習の統合メカニズム

人間の認知アーキテクチャから学ぶ設計思想

人間の認知機能を模倣した認知アーキテクチャは、長期記憶と学習の統合について重要な示唆を与えています。代表的なSoarシステムでは、作業記憶上での問題解決過程から新たな知識をチャンク化によって長期記憶に蓄積し、次回以降の類似状況で自動的に適用する仕組みが実装されています。

同様にACT-Rアーキテクチャでは、宣言的記憶(事実知識)と手続き的記憶(実行ルール)を分離しつつ、それぞれに活性化メカニズムや生成コンパイルなどの学習機構を備えています。これらのシステムに共通するのは、短期的な処理結果が長期記憶に累積され、長期記憶内の知識が適時想起・適用されることで、逐次的かつ累積的な学習が実現される点です。

大規模言語モデルとニューロシンボリックアプローチ

近年では、大規模言語モデル(LLM)をベースにしたエージェントにも長期記憶を付与する試みが進んでいます。これらのエージェントは、推論中に知識グラフやベクトルデータベースを用いて短期・長期記憶や文脈を管理し、対話や環境とのインタラクションから得た情報を蓄積・再利用することで自己適応を図ります。

特に注目されているのがニューロシンボリックアプローチです。このハイブリッドな手法では、ニューラルネットワークの学習能力とシンボリックな記憶・推論能力を組み合わせることで、パターン認識と論理推論を両立させます。コラボレーティブな制御システムや意図予測の分野では、ニューラルネットの暗黙知表現とシンボリックシステムの明示的知識表現を組み合わせ、互いの弱点を補完する取り組みが報告されています。

協働における目標共有と相互予測の本質

共同行為を成立させる三つの要素

認知科学の研究によれば、二者以上の共同行為(ジョイント・アクション)が成功するためには、参加者が以下の能力を持つ必要があります:

- 内部表象の共有:タスクや環境についての共通理解

- 他者行動の予測:相手の次の行動を推測する能力

- 行動効果の統合:自他の行動がもたらす結果を統合的に捉える視点

これらの中でも特に重要なのが「共有された目標」の存在です。共通のゴールがあって初めて、個人の動きが互いに適応しあい、真の相互作用が成立します。二者が共通の目標を持たず独立に動いているだけでは、たまたま隣で作業していても真の協働とは言えません。

人間特有の協力性と相互予測能力

人間においては、生後早い段階から他者と目標や意図を共有しようとする傾向が現れます。幼児が見せる協調行動の研究によれば、共通の目的を追求し意図を共有する能力が人間の社会的学習を支え、社会的な絆や仲間意識の形成にも影響を与えています。

一方、相互予測の能力も協働には不可欠です。共同作業中は相手の頭の中を見ることはできないため、各自が相手の行動意図を観察される手がかりから推論する必要があります。単に相手の行動を見て受動的に反応するだけではタイミングよく調整できず、常に先を見越して予測的に対処することが求められます。

共同意図理論とメンタルモデルの共有

協働AI研究では、Cohen & Levesqueによる共同意図理論が重要な基盤となっています。この理論では、ジョイント・インテンションを「複数エージェントが、互いにそれを遂行中であると常に相互に信じつつ、ある目標を一緒に達成しようとコミットしている状態」と定義しています。

このモデルでは、エージェント同士が目標達成へのコミットメントを共有し、さらに「そのコミットメントを互いに知っている(相互信念)」ことが重視されます。これは互いが協力し続ける保証となり、一方がゴールの達成や不可能を察知した際には、もう一方へその情報を伝える義務が発生すると論じられています。

近年の研究では、共有メンタルモデルの重要性も強調されています。チームメンバーが課題やお互いに関して類似したメンタルモデルを持つほど、相手の行動を正確に予測でき、円滑に調整できることが報告されています。

相互予測能力の発達プロセスと目標共有の深化

継続的インタラクションによる学習と適応

協働関係が継続する中で、エージェント同士が互いの行動パターンや嗜好を学習し、相互予測能力が発達していくことが知られています。このプロセスは、結果的に共有目標の明確化・進化につながります。

動的相互予測モデルでは、「相互予測モデルこそが関係性が時間とともに発展する仕組みを実証的に説明しうる手段となる」と指摘されています。すなわち、互いの予測の精度やズレ修正のプロセスを解析することで、協働関係の発展そのものを理解できるという見解です。

記憶と学習の統合は、この相互予測能力の発達にとって不可欠です。各エージェントが長期的な相互作用の記録を記憶し、それを基に内部モデルを更新し続けることで、予測の精度が徐々に向上します。例えば、あるAIアシスタントが特定のユーザーの癖や好みを長期記憶し学習していれば、ユーザーの次の要求を事前に察したり、未確定の意図を補完した提案を行ったりできるでしょう。

マルチエージェント強化学習における相互モデリング

マルチエージェント強化学習の研究でも、相互予測が協調戦略の発達に寄与することが示されています。エージェント同士が利害を共有する協調タスクで微小なゴールの解釈差があると、システム全体の挙動が不安定化することが報告されており、安定した協働にはゴールの明確な共有が重要だと示唆されています。

注目すべきは、Rabinowitzらが開発した**Machine Theory of Mind(ToMnet)**です。このモデルでは、観察した相手エージェントの行動からメタ学習によりその意図や目標を推測するニューラルネットワークを設計し、限られた観察だけで相手の内部状態や今後の行動を予測できるようにしています。ToMネットは他者の信念・欲求・意図をモデル化し、古典的なサリーアンナ課題(false-belief test)さえパスするほど高度な他者理解能力を示しました。

フィードバックループによる目標共有の進化

相互予測の発達そのものが目標共有を深化させるというフィードバックも存在します。互いの行動予測が的確になるほど、「何をすれば相手にとって有益か」「相手は何を望んでいるか」が明瞭になるため、暗黙知的に共通の目的が形成されていきます。

例えば、人とAIのチームが長期間協働するうちに、AIが人の真のニーズを予測して動けるようになると、人はAIを信頼してより大きな裁量を与え、最終的には当初明示されていたタスク以上に幅広い目標をAIと共有するようになる可能性があります。こうした目標共有の進化は、まさに相互予測能力がもたらす協働関係の深化と言えるでしょう。

相互予測能力向上がもたらす協働の質的変化

協調動作のスムーズさと効率性の向上

相互予測能力が発達したエージェント同士の協働は、そうでない場合と比べて格段に質が向上します。互いに相手の次の行動を高精度で予測できれば、無駄な待ち時間や衝突する操作が減り、タイミングよく連携できます。

例えば、自動運転車の群れが互いの意図を予測し合えば、合流や車線変更といった局面でもスムーズに流れを保てます。人間-AIチームでも、AIがユーザーの意図を先読みして補助すれば、ユーザーはストレスなくタスクを進められるでしょう。

誤解とコンフリクトの軽減

相互予測能力が低い場合、しばしば「相手が何をしたいのか分からない」「自分の意図が伝わっていない」といった齟齬が生じます。しかしお互いをモデル化できていれば、そのような意思疎通のズレを事前に察知して調整できるため、大きな対立に発展しにくくなります。

協調マルチエージェント研究が示すように、共有目標の解釈ずれは協働を不安定化させますが、逆に言えば相互理解が安定していれば協働も安定します。例えば共同執筆AIがユーザーの書きたい内容を誤解しないよう文脈と意図を学習し予測できれば、ユーザーはAIの提案に戸惑うことなく受け入れられるでしょう。

信頼関係の構築と創発的協調行動

相手が自分の行動を的確に予測しフォローしてくれると分かれば、エージェント(あるいは人)は相手をより信頼し、自身も相手のために最適な行動を取ろうとします。この相互信頼の醸成によって、より高度な協調(例えば相手に任せる範囲を広げる等)が可能になります。

高度に相互予測ができるエージェントたちは、逐一事前に取り決めなくとも状況に応じて阿吽の呼吸で役割を交替したり、新たな戦略を即興で生み出したりできます。これは人間の熟練チームがしばしば見せる特徴ですが、AIエージェントでも相互学習を通じてそうした適応的チームワークが可能になりつつあります。

長期記憶・学習統合を実現する主要アプローチ

シンボリック認知アーキテクチャ

Soarは、長期記憶に産出ルールを格納し、チャンク化で経験から新規ルールを学習します。ワーキングメモリと連携した逐次学習により、単一エージェントモデルながらルールに共同ゴールを符号化することでマルチエージェント協調にも利用可能です。

ACT-Rは、宣言的記憶(事実のチャンク)と手続き記憶(産出ルール)を分離し、使用頻度に応じた活性化変化やルールコンパイルで知識を更新します。複数モジュール(視覚・運動等)を統合し、元々は人間の認知モデルですが、チーム課題のシミュレーションに適用され、メンタルモデルの共有やトラストなど人間の協調要因を再現可能です。

マルチエージェント強化学習システム

各エージェントが内部RNN状態や経験メモリで履歴を保持し、自己の報酬だけでなく他者の行動も観測してポリシー最適化を行います。時に相手モデルをネットワーク内にエンコードすることで、エージェント同士が自己のポリシーに他者のモデルを組み込み協調します。

相互予測により協調行動(例:ターン交替や役割分化)が自発的に生まれる可能性があり、明示的にプログラムされていない協調パターンが創発することも報告されています。

LLMベース協調エージェント

各エージェントが長大な履歴(対話ログや知識)を共有メモリあるいは個人メモリとして保持し、必要時に検索・想起します。単一エージェントのメモリ拡張とは異なる同期・アクセス制御の課題がありますが、適切に設計すれば集団知能や長期協調が実現可能です。

共通メモリ基盤を構築して知識を共有・更新することで、複数LLMエージェントが一つの知識グラフを参照しながら対話し、互いの発言や外部環境から学習してチームとして進化していくアプローチが研究されています。

まとめ:協働AIの未来に向けて

長期記憶と学習の統合は、協働エージェントが互いを予測し合い、共通の目標を形成・発展させていくための基盤です。認知科学の知見からAI研究の最新動向まで、様々なアプローチが「過去の経験を記憶し活用することで相手やタスクに対する理解を深め、それに基づき将来の振る舞いを予測・調整する」というメカニズムを実装しようとしています。

相互予測能力の発達は、協調動作のスムーズさ、誤解の軽減、信頼関係の構築、創発的協調行動の実現など、協働の質と深さを飛躍的に高めます。今後の研究では、記憶と学習の統合によって生じる新たな相互予測戦略や協調の自律的進化の解明、そしてそれを実際の人間-AI協働やマルチエージェント応用に活かすことが期待されます。

AIと人間、そしてAI同士の協働が当たり前となる未来において、長期記憶と学習の統合技術は、より自然で効果的なチームワークを実現する鍵となるでしょう。

コメント